章节导语

AI系统可能会歧视某些群体、泄露隐私、产生有害内容——这些问题不解决,AI就无法真正服务于人类。

2023年,某公司用AI筛选简历,结果发现AI系统性地歧视女性——因为训练数据中历史上男性简历更多。2024年,一个对话机器人被诱导说出仇恨言论,引发公众恐慌。这些不是极端案例——AI安全与伦理问题每天都在发生。

本文系统讲解AI安全与伦理的核心议题:偏见与公平、透明性与可解释性、隐私保护、有害内容检测、RLHF对齐等。每个议题都有具体的检测方法和缓解策略。

一、前置说明

1.1 学习路径

| 阶段 | 内容 |

|---|---|

| 前置 | Agent系统、模型评估 |

| 本篇 | AI安全与伦理实践 |

1.2 读者需要的基础

- 机器学习基础:理解模型训练、数据集概念

- AI应用开发:有实际部署AI系统的经验

- Python基础:能处理数据和调用API

1.3 学习目标

学完本文,你将能够:

- 识别AI系统中的偏见来源

- 实施公平性评估和缓解措施

- 理解可解释性AI的方法

- 设计隐私保护的AI系统

- 构建有害内容检测机制

二、偏见与公平性

2.1 偏见的来源

AI偏见不是”AI讨厌某些人”,而是AI系统性地对不同群体产生不同的处理结果,通常对弱势群体不利。

数据偏见:训练数据本身就有偏见。比如历史招聘数据中男性占多数,AI学会”男性更适合工作”的偏见。

标注偏见:标注者的偏见被带入数据。标注者可能是特定年龄段、地区、文化的群体,他们的主观判断会被刻进数据。

特征偏见:使用不当的特征导致偏见。比如用”邮政编码”作为信用评估特征,邮编和经济状况相关,可能间接导致对某些群体的歧视。

反馈循环:AI的偏见预测导致更多偏见数据,偏见数据又训练出更有偏见的AI,形成恶性循环。

2.2 公平性度量

公平性可以从多个维度度量:

统计均等(Statistical Parity):不同群体的正向结果率应该相同。比如男性和女性的贷款批准率应该相同。

均等机会(Equalized Odds):在不同群体中,真阳性率和假阳性率应该相同。比如同等资质的男性和女性获得贷款的概率应该相同。

校准(Calibration):模型对不同群体的预测概率应该是准确的。比如模型预测”80%会违约”的群体,实际违约率也应该是80%。

个人公平(Individual Fairness):相似的个体应该有相似的预测结果。不考虑群体,只考虑个体特征。

2.3 偏见检测工具

import pandas as pd

import numpy as np

from typing import Dict, List

class FairnessAnalyzer:

"""公平性分析器

检测和度量AI系统中的偏见

"""

def __init__(self, sensitive_attribute: str):

"""

Args:

sensitive_attribute: 敏感属性列名,如'gender'、'race'、'age'

"""

self.sensitive_attr = sensitive_attribute

def statistical_parity_difference(self, df: pd.DataFrame,

prediction_col: str,

positive_label: int = 1) -> Dict[str, float]:

"""计算统计均等差异

正向结果率在不同群体间的差异

"""

groups = df[self.sensitive_attr].unique()

rates = {}

for group in groups:

group_data = df[df[self.sensitive_attr] == group]

rate = (group_data[prediction_col] == positive_label).mean()

rates[group] = rate

# 计算最大差异

max_diff = max(rates.values()) - min(rates.values())

return {

'rates': rates,

'max_difference': max_diff,

'is_fair': max_diff < 0.1 # 差异小于10%认为相对公平

}

def equalized_odds_difference(self, df: pd.DataFrame,

prediction_col: str,

label_col: str) -> Dict[str, float]:

"""计算均等机会差异

真阳性率和假阳性率在不同群体间的差异

"""

groups = df[self.sensitive_attr].unique()

metrics = {}

for group in groups:

group_data = df[df[self.sensitive_attr] == group]

# 真阳性率 (TPR)

true_pos = ((group_data[prediction_col] == 1) & (group_data[label_col] == 1)).sum()

actual_pos = (group_data[label_col] == 1).sum()

tpr = true_pos / actual_pos if actual_pos > 0 else 0

# 假阳性率 (FPR)

false_pos = ((group_data[prediction_col] == 1) & (group_data[label_col] == 0)).sum()

actual_neg = (group_data[label_col] == 0).sum()

fpr = false_pos / actual_neg if actual_neg > 0 else 0

metrics[group] = {'tpr': tpr, 'fpr': fpr}

# 计算组间差异

tprs = [m['tpr'] for m in metrics.values()]

fprs = [m['fpr'] for m in metrics.values()]

return {

'metrics': metrics,

'tpr_difference': max(tprs) - min(tprs),

'fpr_difference': max(fprs) - min(fprs)

}

def disparate_impact_ratio(self, df: pd.DataFrame,

prediction_col: str,

positive_label: int = 1) -> float:

"""计算不同影响比率

美国EEOC使用的4/5规则

"""

groups = df[self.sensitive_attr].unique()

rates = []

for group in groups:

group_data = df[df[self.sensitive_attr] == group]

rate = (group_data[prediction_col] == positive_label).mean()

rates.append(rate)

# 最小比率 / 最大比率

ratio = min(rates) / max(rates) if max(rates) > 0 else 0

return {

'ratio': ratio,

'passes_4_5_rule': ratio >= 0.8

}

# 使用

if __name__ == "__main__":

# 模拟数据

np.random.seed(42)

n = 1000

data = {

'gender': np.random.choice(['male', 'female'], n),

'age': np.random.randint(18, 65, n),

'income': np.random.randint(20000, 150000, n),

'credit_score': np.random.randint(300, 850, n),

'loan_approved': np.random.choice([0, 1], n, p=[0.7, 0.3])

}

df = pd.DataFrame(data)

analyzer = FairnessAnalyzer('gender')

# 检测统计均等

result = analyzer.statistical_parity_difference(df, 'loan_approved')

print(f"统计均等检测: {result}")

# 检测均等机会

result2 = analyzer.equalized_odds_difference(df, 'loan_approved', 'loan_approved')

print(f"均等机会检测: {result2}")

三、可解释性AI

3.1 为什么需要可解释性

AI模型的决策过程往往是黑箱——输入数据,输出结果,但不知道为什么会这样。这在很多场景是不可接受的:

医疗诊断:AI建议做手术,但为什么?医生需要理由才能判断是否采纳。

金融贷款:AI拒绝了贷款申请,但为什么?申请人有权知道原因。

司法判决:AI建议量刑,但依据是什么?必须能解释清楚。

可解释性不仅是合规要求,更是建立信任、发现错误、改进模型的必要条件。

3.2 解释方法分类

可解释性方法可以分为两类:

内在可解释(Intrinsic):模型本身就是可解释的。比如决策树、线性回归、规则提取模型。

事后可解释(Post-hoc):模型训练完后再解释。不改变模型结构,通过分析输入输出关系提供解释。

3.3 特征重要性

import numpy as np

from sklearn.ensemble import RandomForestClassifier

from sklearn.inspection import permutation_importance

class ExplainableAI:

"""可解释性AI工具"""

@staticmethod

def feature_importance_rf(model: RandomForestClassifier,

feature_names: List[str]) -> Dict[str, float]:

"""基于随机森林的特征重要性

使用基尼重要性计算每个特征对决策的贡献

"""

importances = model.feature_importances_

result = dict(zip(feature_names, importances))

# 排序

result = dict(sorted(result.items(), key=lambda x: x[1], reverse=True))

return result

@staticmethod

def permutation_importance(model, X, y, feature_names: List[str],

n_repeats: int = 10) -> Dict[str, float]:

"""置换重要性

打乱每个特征的值,看对模型性能的影响

更可靠,但不计算每个样本的解释

"""

result = permutation_importance(model, X, y, n_repeats=n_repeats, random_state=42)

importance_dict = {}

for i, name in enumerate(feature_names):

importance_dict[name] = {

'mean': result.importances_mean[i],

'std': result.importances_std[i]

}

return dict(sorted(importance_dict.items(),

key=lambda x: x[1]['mean'], reverse=True))

@staticmethod

def shap_values(model, X, feature_names: List[str]):

"""计算SHAP值

SHAP (SHapley Additive exPlanations)

基于博弈论,衡量每个特征对预测的贡献

"""

try:

import shap

# 使用TreeExplainer(对树模型更快)

explainer = shap.TreeExplainer(model)

shap_values = explainer.shap_values(X)

return {

'shap_values': shap_values,

'feature_names': feature_names,

'expected_value': explainer.expected_value

}

except ImportError:

print("请安装shap: pip install shap")

return None

# 使用

if __name__ == "__main__":

from sklearn.datasets import make_classification

X, y = make_classification(n_samples=1000, n_features=5, random_state=42)

feature_names = ['age', 'income', 'credit_score', 'employment_years', 'debt_ratio']

model = RandomForestClassifier(n_estimators=100, random_state=42)

model.fit(X, y)

explainer = ExplainableAI()

# 特征重要性

importance = explainer.feature_importance_rf(model, feature_names)

print("特征重要性:")

for name, imp in importance.items():

print(f" {name}: {imp:.4f}")

# SHAP值

result = explainer.shap_values(model, X[:10], feature_names)

if result:

print(f"\nSHAP expected value: {result['expected_value']}")四、隐私保护

4.1 隐私风险

AI系统面临多种隐私风险:

数据泄露:训练数据中的敏感信息可能被模型记住,在推理时泄露。

成员推断攻击:攻击者判断某个样本是否在训练数据中。这在医疗数据等敏感场景尤其危险。

模型逆向攻击:通过查询API,反推模型的训练数据或参数。

数据重建攻击:从模型参数或中间表示重建原始数据。

4.2 隐私保护技术

差分隐私(Differential Privacy):在数据或计算中添加噪声,确保无法从结果推断任何个体信息。数学上严格可证明。

联邦学习(Federated Learning):数据不出本地,只把模型参数聚合更新。适合隐私敏感的多方协作场景。

数据脱敏(Data Anonymization):删除或混淆可直接识别个人身份的信息。但传统脱敏往往不够,被重新识别的风险较高。

隐私计算:包括同态加密、安全多方计算等技术,在加密状态下进行计算。

4.3 差分隐私实现

import numpy as np

from typing import Callable

class DifferentialPrivacy:

"""差分隐私工具

提供多种差分隐私机制

"""

@staticmethod

def laplace_mechanism(value: float, sensitivity: float, epsilon: float) -> float:

"""拉普拉斯机制

用于数值型查询

添加拉普拉斯噪声实现差分隐私

Args:

value: 真实查询结果

sensitivity: 全局敏感度(最大改变量)

epsilon: 隐私预算(越小越隐私)

Returns:

加噪后的值

"""

scale = sensitivity / epsilon

noise = np.random.laplace(0, scale)

return value + noise

@staticmethod

def exponential_mechanism(scores: np.ndarray, epsilon: float,

sensitivity: float = 1.0) -> int:

"""指数机制

用于离散选择问题

得分越高的选项被选择的概率越大

"""

# 计算概率(未归一化)

exp_scores = np.exp(epsilon * scores / (2 * sensitivity))

probs = exp_scores / exp_scores.sum()

# 按概率采样

return np.random.choice(len(scores), p=probs)

@staticmethod

def gaussian_mechanism(value: float, sensitivity: float,

epsilon: float, delta: float = 1e-5) -> float:

"""高斯机制

另一种噪声机制,需要更强的条件

适合需要更严格隐私保证的场景

"""

# 计算标准差

sigma = np.sqrt(2 * np.log(1.25 / delta)) * sensitivity / epsilon

noise = np.random.normal(0, sigma)

return value + noise

class PrivacyBudget:

"""隐私预算管理"""

def __init__(self, total_epsilon: float):

self.total_epsilon = total_epsilon

self.spent = 0.0

def consume(self, epsilon: float) -> bool:

"""消耗隐私预算

Returns:

是否还有足够预算

"""

if self.spent + epsilon > self.total_epsilon:

return False

self.spent += epsilon

return True

def remaining(self) -> float:

return self.total_epsilon - self.spent

# 使用

if __name__ == "__main__":

dp = DifferentialPrivacy()

# 数值查询加噪

true_count = 1000

noisy_count = dp.laplace_mechanism(true_count, sensitivity=1, epsilon=1.0)

print(f"真实计数: {true_count}, 加噪后: {noisy_count:.2f}")

# 隐私预算管理

budget = PrivacyBudget(total_epsilon=10.0)

queries = [1.0, 1.0, 2.0, 1.0]

for q in queries:

if budget.consume(q):

print(f"查询消耗 epsilon={q}, 剩余预算: {budget.remaining():.2f}")

else:

print(f"预算不足,无法执行 epsilon={q} 的查询")五、有害内容检测

5.1 有害内容类型

AI系统可能产生多种有害内容:

仇恨言论:针对特定群体的歧视、贬低、暴力威胁。

色情内容:露骨的性内容。

暴力内容:描述暴力行为、伤害他人的内容。

虚假信息:看似合理但实际上是错误或误导性的内容。

钓鱼和欺诈:冒充他人或机构进行诈骗。

5.2 检测方法

关键词过滤:最简单的规则匹配。快速但容易被绕过,误报率较高。

机器学习分类:训练二分类模型判断内容是否有害。准确率更高,但需要标注数据。

多模型ensemble:多个模型投票决定。更鲁棒,但计算成本高。

多语言支持:不同语言的有害内容模式不同,需要针对性的模型。

5.3 有害内容检测器

from enum import Enum

from typing import List, Dict

class ContentCategory(Enum):

"""内容类别"""

SAFE = "safe"

HATE_SPEECH = "hate_speech"

SEXUAL = "sexual"

VIOLENCE = "violence"

MISINFORMATION = "misinformation"

FRAUD = "fraud"

SELF_HARM = "self_harm"

class HarmfulContentDetector:

"""有害内容检测器

多类别分类 + 规则匹配

"""

def __init__(self):

# 关键词规则(简化版)

self.hate_keywords = [

'hate', 'kill', 'destroy', 'attack',

# 实际应用中需要更完整的词表

]

self.violence_keywords = [

'weapon', 'bomb', 'attack', 'kill',

'shoot', 'murder', 'assassinate',

]

self.self_harm_keywords = [

'suicide', 'kill myself', 'end my life',

'self harm', 'cut myself',

]

def detect_keyword(self, text: str) -> List[str]:

"""基于关键词的规则检测"""

text_lower = text.lower()

detected = []

if any(kw in text_lower for kw in self.hate_keywords):

detected.append(ContentCategory.HATE_SPEECH.value)

if any(kw in text_lower for kw in self.violence_keywords):

detected.append(ContentCategory.VIOLENCE.value)

if any(kw in text_lower for kw in self.self_harm_keywords):

detected.append(ContentCategory.SELF_HARM.value)

return detected

def detect_ml(self, text: str, model=None) -> Dict[str, float]:

"""基于机器学习的检测

实际应用中调用训练好的分类模型

"""

# 这里是伪代码

# 实际使用时需要加载预训练模型

if model is None:

# 返回默认分数

return {

'hate_speech': 0.1,

'sexual': 0.05,

'violence': 0.15,

'misinformation': 0.2,

'fraud': 0.1,

'self_harm': 0.05

}

# 真实实现

return model.predict_proba([text])[0]

def detect(self, text: str, model=None,

rule_threshold: float = 0.5,

ml_threshold: float = 0.7) -> Dict:

"""综合检测

结合规则和ML方法

"""

# 规则检测

rule_results = self.detect_keyword(text)

# ML检测

ml_scores = self.detect_ml(text, model)

ml_results = [cat for cat, score in ml_scores.items()

if score > ml_threshold]

# 合并结果

all_harmful = list(set(rule_results + ml_results))

return {

'is_safe': len(all_harmful) == 0,

'harmful_categories': all_harmful,

'ml_scores': ml_scores,

'action': 'block' if all_harmful else 'allow'

}

# 使用

if __name__ == "__main__":

detector = HarmfulContentDetector()

test_texts = [

"What a beautiful day!",

"We should eliminate all the...",

"I want to kill myself",

]

for text in test_texts:

result = detector.detect(text)

print(f"文本: {text[:50]}...")

print(f" 安全: {result['is_safe']}")

print(f" 有害类别: {result['harmful_categories']}")

print(f" 操作: {result['action']}")

print()六、RLHF与对齐

6.1 什么是对齐

AI对齐(Alignment)是指让AI系统的行为符合人类意图和价值观。GPT-3训练时只学习了语言规律,可能产生有害、不 Helpful的输出。RLHF通过人类反馈让模型学会”什么是对的”。

Helpful:对用户有帮助,能完成任务、提供有价值的信息。

Honest:真实可信,不知道的会说不知道,不编造信息。

Harmless:无害的,不会产生攻击性、歧视性、危险性的内容。

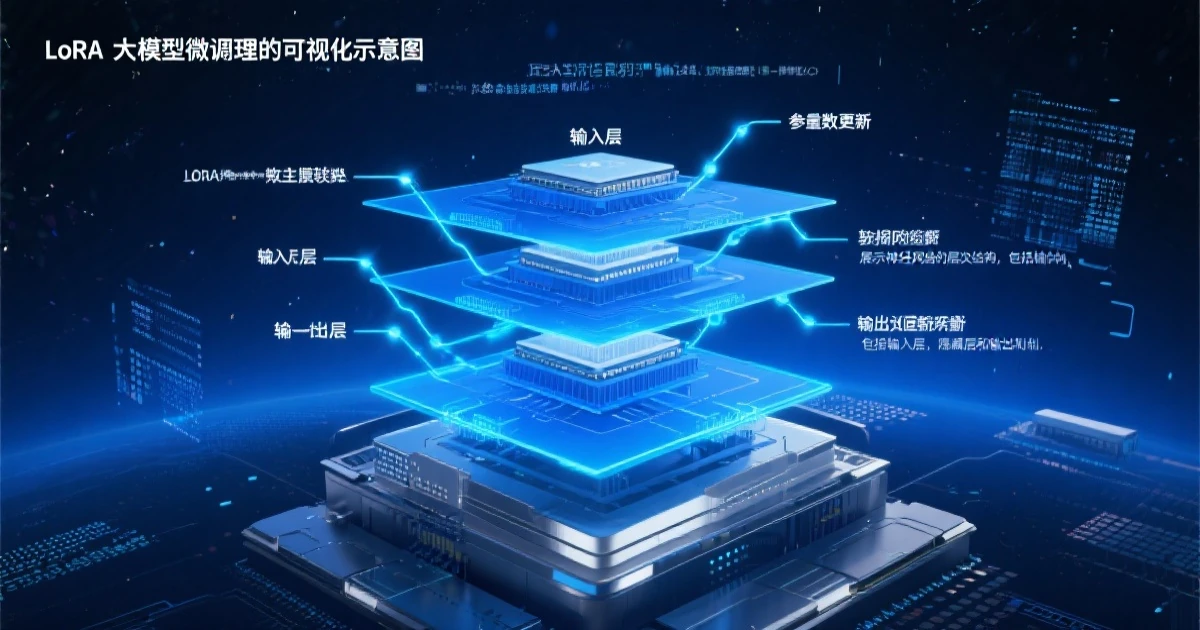

6.2 RLHF流程

第一步:预训练语言模型。完成基本的语言建模。

第二步:训练奖励模型。收集人类对不同输出的偏好,训练一个奖励模型预测人类偏好。

第三步:强化学习优化。用奖励模型作为信号,用PPO算法优化语言模型,让它产生更高奖励的输出。

第四步:迭代改进。人类反馈持续收集,模型持续优化。

七、实践检查清单

□ 偏见检测与公平性

□ 数据集偏见审计已完成

□ 敏感属性使用已记录

□ 公平性指标已测量

□ 缓解措施已实施

□ 可解释性

□ 特征重要性已分析

□ 关键决策可解释

□ 解释机制已部署

□ 隐私保护

□ 敏感数据已脱敏

□ 数据访问已审计

□ 隐私预算已管理

□ 差分隐私已应用(如适用)

□ 有害内容检测

□ 内容分类器已部署

□ 关键词过滤已配置

□ 人工审核机制已建立

□ 误报漏报已监控

□ 对齐与安全

□ RLHF已应用(如适用)

□ 红队测试已完成

□ 安全边界已定义

□ 应急响应已计划八、总结

AI安全不是事后补救,而是从设计开始。安全考量越早引入,成本越低,效果越好。

公平性是多维度的。没有完美的公平性定义,要根据应用场景选择合适的度量指标。

可解释性是信任的基础。不能解释的AI很难让人信任,也很难改进和问责。

隐私保护需要技术和制度结合。技术手段再完善,管理制度跟不上也会出问题。

对齐是持续过程。不是一次训练就完成,而是需要持续收集反馈、迭代改进。

延伸阅读

- AI Ethics Guidelines:欧盟AI伦理指南

- OpenAI Safety:OpenAI的安全研究

- SHAP Documentation:可解释性工具文档

课后练习

基础题:对公开数据集进行公平性审计,检测是否存在对特定群体的偏见。

进阶题:实现一个有害内容检测系统,结合规则和ML方法。

挑战题:实现差分隐私的SQL查询系统,对数值查询添加噪声保护隐私。

我要评论