【进阶实战】Day26:AI大模型微调实战——LoRA/QLoRA原理与实战

导语

为什么你的AI总是不够”懂”你的业务?通用大模型就像一个博览群书的全才,上知天文下知地理,但在具体行业场景里却总是差那么一点感觉。医疗、金融、法律、代码生成——每个领域都有自己的专业术语和表达方式,通用模型学不来的东西太多了。

这时候,你就需要大模型微调(Fine-tuning)技术。

微调是什么?简单说,就是在一个已经训练好的大模型基础上,用你自己的专业数据再训练一下,让它变成你这个行业的”专家”。而LoRA和QLoRA,就是目前最主流、最实用的微调技术。

2026年的今天,LoRA已经成为AI从业者必须掌握的核心技能。无论你是想打造专属的客服机器人,还是想让模型理解你的产品文档,又或者想训练一个懂你业务逻辑的AI助手——LoRA都是你的首选方案。

这篇文章,我会用最通俗易懂的方式,帮你彻底搞懂LoRA和QLoRA的原理,并且手把手教你如何在实际项目中使用它们。

🔹一、为什么需要微调:大模型的”通才”与”专精”困境

1.1 通用大模型的能力边界

以GPT-5.2、Claude 4、Gemini 3为代表的通用大模型,确实强大。它们在常识问答、文学创作、代码编写等通用任务上表现出色。但当你把它们应用到具体业务场景时,问题就出现了。

案例一:医疗场景

通用模型知道”糖尿病是一种代谢疾病”,但它不知道你们医院用的诊断标准和流程是什么。它不知道你们科室常用的缩写术语,不知道哪些检查结果是最关键的指标。用它来做辅助诊断?差得远。

案例二:法律场景

通用模型懂法律条文,但它不懂你们地区的司法实践惯例,不懂你们律所的处理案件风格,不懂哪些证据在你们法院最被看重。用它来写法律文书?只能写出通用的、缺乏针对性的内容。

案例三:电商场景

通用模型会写产品文案,但它不懂你家的品牌调性,不懂你目标客户群体的喜好,不知道你家最想主打的卖点是什么。用它来写推广文案?永远都是泛泛而谈。

这就是通用大模型的”通才困境”——什么都会,什么都不精。

1.2 三种解决方案对比

针对这个问题,业界主要有三种解决方案:

| 方案 | 原理 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| 提示词工程 | 通过精心设计的提示词引导模型输出 | 无需训练,随时调整 | 效果不稳定,消耗大量token | 简单场景,快速验证 |

| RAG检索增强 | 结合知识库检索+模型推理 | 可接入最新知识,可解释性强 | 响应速度慢,依赖检索质量 | 需要最新知识的场景 |

| 模型微调 | 用领域数据重新训练模型 | 效果好,速度快,定制化程度高 | 需要训练数据,训练有成本 | 深度定制,专业领域 |

这三种方案并不是互斥的。很多成熟的AI应用,都会同时采用多种技术。比如先用RAG检索最新文档,再用微调过的模型进行专业理解,最后用提示词优化输出格式。

但在很多场景下,微调仍然是不可替代的选择。因为它能让模型真正”学会”你行业的思维方式,而不仅仅是知道一些知识。

1.3 全量微调的困境

说到微调,很多人首先想到的是全量微调——把模型的所有参数都用领域数据重新训练一遍。

全量微调的效果确实好,但问题也很明显:

显存爆炸:以一个70B参数规模的模型为例,使用FP16精度进行全量微调,需要的GPU显存约为:

- 原始模型权重:70B × 2 bytes = 140GB

- 梯度存储:70B × 2 bytes = 140GB

- 优化器状态:70B × 8 bytes = 560GB(Adam优化器需要存储一阶和二阶动量)

总计需要约840GB显存,这意味着你需要至少11张A100 80GB显卡才能勉强运行。

训练成本高昂:全量微调一次,消耗的电费和GPU租赁费用可能是几十万甚至上百万元。普通中小企业根本承担不起。

灾难性遗忘风险:全量微调可能导致模型遗忘之前学到的知识。一个被训练成”医学专家”的模型,可能会忘记如何写代码。

正是这些困境,催生了参数高效微调(PEFT,Parameter-Efficient Fine-Tuning)技术的快速发展。而LoRA,就是PEFT中最成功的代表。

🔹二、LoRA核心原理:低秩适配的魔法

2.1 大模型权重矩阵的低秩特性

理解LoRA的关键,是理解一个数学事实:预训练大模型在适配新任务时,权重矩阵的变化量具有低秩特性。

什么意思呢?假设模型的某个权重矩阵 W ∈ R^(d×k),在微调过程中需要更新到 W’。传统全量微调会直接更新 W 的所有参数,计算 ΔW = W’ – W。

研究者们发现,这个 ΔW 矩阵,虽然本身可能是满秩的(d×k维),但它的有效信息可以用一个低秩矩阵近似表示。

数学表达:ΔW ≈ A × B,其中 A ∈ R^(d×r),B ∈ R^(r×k),r远小于min(d,k)。

举个例子,如果 d=1024,k=1024,那么 W 是1024×1024的矩阵,参数量是100万。但如果 r=8,那么 A 是1024×8(8000多参数),B 是8×1024(也是8000多参数),总计不到2万参数——减少了98%的参数量!

这就是LoRA的数学基础:用两个小矩阵的乘积,替代直接学习一个大赛矩阵。

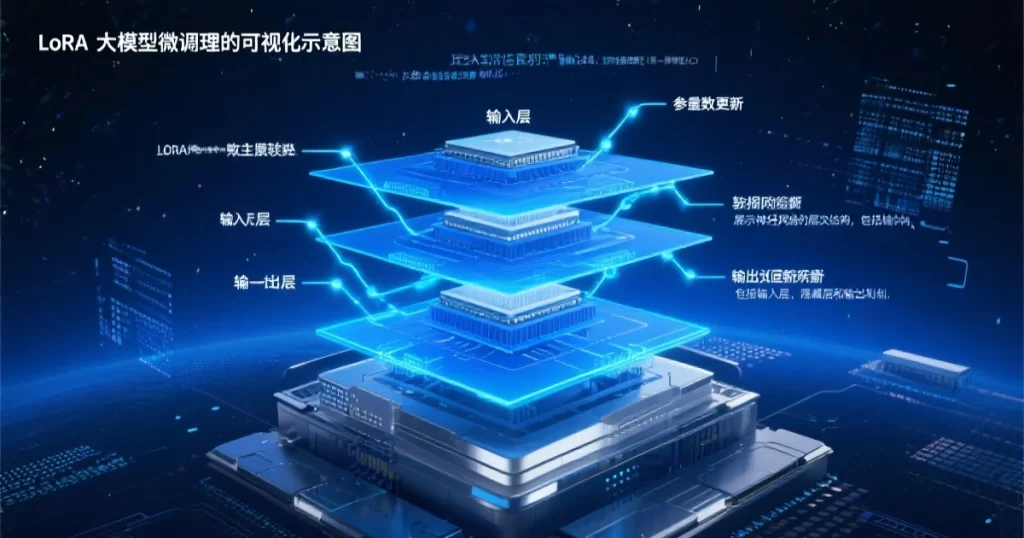

2.2 LoRA的工作机制

LoRA的核心思想是:冻结预训练模型的原始权重,只在旁边新增一小批可训练的低秩矩阵。

具体操作:

1. 冻结原模型权重:原始权重矩阵 W0 保持不变,梯度为0,不参与训练

2. 新增低秩支路:在每个需要微调的注意力层旁边,新增两个矩阵 A 和 B

- 前向传播时:h = W0 × x + (B × A) × x

- 训练时只更新 A 和 B 的参数

3. 随机初始化:

- A矩阵用随机正态分布初始化

- B矩阵初始化为全零

- 这样训练开始时,BA=0,模型输出等价于原始模型,安全稳定

4. 渐进式学习:随着训练进行,A和B逐渐学习到针对新任务的适配信息

2.3 LoRA的优势

显存效率提升惊人:

以LLaMA-7B模型为例,对比全量微调和LoRA的显存占用:

| 项目 | 全量微调 | LoRA (r=8) |

|---|---|---|

| 模型权重 | 14GB | 14GB(冻结) |

| 梯度 | 14GB | 0.3GB |

| 优化器 | 56GB | <0.1GB |

| 总计 | 84GB | ~15GB |

只需要一张RTX 3090就能训练LLaMA-7B了!

训练稳定:由于原始权重被冻结,LoRA训练不会丢失预训练知识,不会出现灾难性遗忘。

推理零延迟:推理时,可以把BA矩阵加到原始权重上(W = W0 + BA),融合成一个新的权重矩阵,和原始模型一模一样的推理速度。

可切换性强:同一个基座模型,可以训练多个不同任务的LoRA权重。推理时只需要切换不同的LoRA模块,就能让模型完成不同任务。一张GPU,多种能力。

2.4 典型应用场景

场景一:垂直领域定制

用医疗文献数据微调一个”医疗专家”LoRA,用法律判例数据微调一个”法律顾问”LoRA。部署时,根据用户问题类型自动切换。

场景二:角色定制

用特定角色的对话数据微调LoRA,让AI模仿特定人的说话风格。比如训练一个”马云腔调”的AI,或者”福尔摩斯风格”的对话AI。

场景三:特定技能学习

用数学题数据微调LoRA,让模型专门擅长数学推理。用代码数据微调LoRA,让模型专门擅长编程。

🔹三、QLoRA:极限省显存的秘密

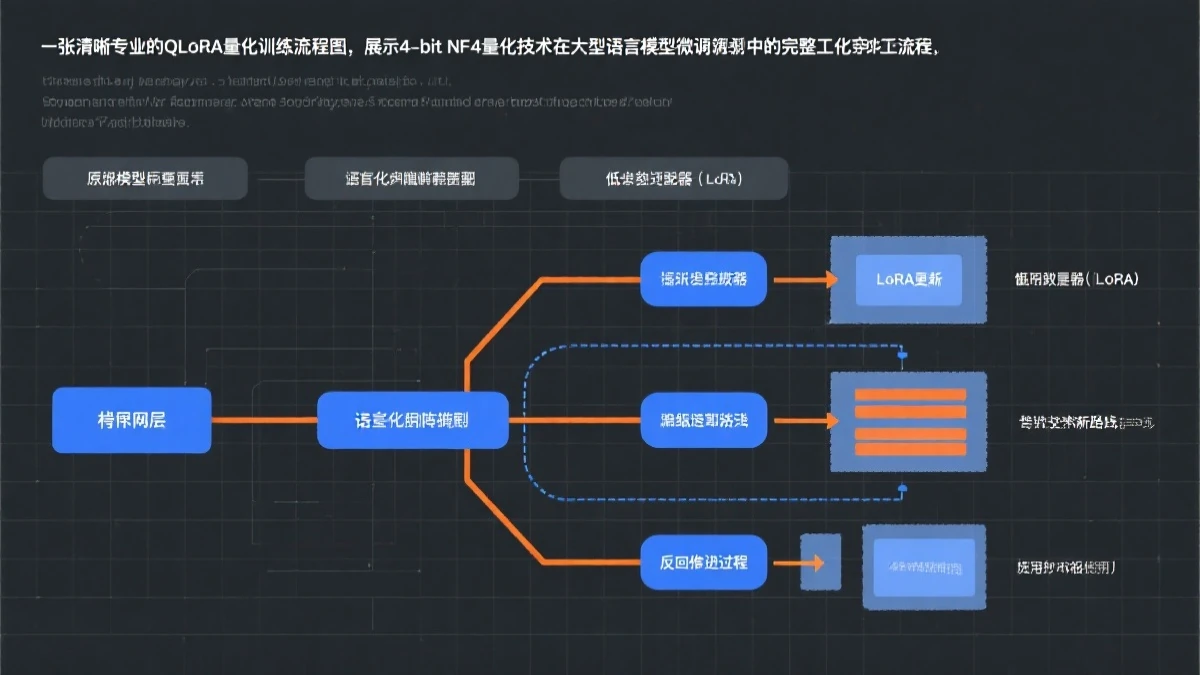

3.1 QLoRA的核心创新

QLoRA是LoRA的进化版本,由华盛顿大学和Hugging Face的研究者在2023年提出。它的核心创新是把量化技术和LoRA结合,进一步降低显存需求。

三个关键技术创新:

1. NF4(4-bit NormalFloat)量化

传统的量化方式(如INT8、INT4)会导致精度损失,影响模型效果。QLoRA提出了专为神经网络权重设计的NF4量化格式。

NF4的核心思想是:权重分布不是均匀的,呈现出正态分布特征。大多数权重接近零,只有少数权重绝对值较大。NF4根据这个分布特性,设计了非均匀的量化间隔,小权重用高精度表示,大权重用低精度表示。

2. 双重量化(Double Quantization)

LoRA的训练过程中,需要对权重进行去量化(反量化)操作。双量化是指对量化常数本身再次量化,进一步节省显存。

3. 分页优化器(Paged Optimizer)

在训练过程中,梯度移动平均的波动可能导致显存峰值过高。分页优化器把优化器状态临时卸载到CPU内存,等波动降低时再加载回来,像操作系统的虚拟内存一样管理显存。

3.2 QLoRA vs LoRA效果对比

在OpenPlatypus数据集上的测试结果:

| 模型 | 方法 | 准确率 | 显存需求 | 训练时间 |

|---|---|---|---|---|

| LLaMA-7B | 全量微调 | 68.2% | 84GB | 8小时 |

| LLaMA-7B | LoRA (r=16) | 63.5% | 15GB | 2小时 |

| LLaMA-7B | QLoRA (r=64) | 67.1% | 10GB | 3小时 |

QLoRA在只有10GB显存需求的情况下,效果几乎追平全量微调!

3.3 QLoRA实战配置推荐

不同规模模型的QLoRA配置:

| 模型规模 | 量化精度 | LoRA r | 适用显卡 |

|---|---|---|---|

| 7B | 4-bit | 64 | RTX 3090 / 4060Ti |

| 13B | 4-bit | 64 | RTX 4090 / A100 40GB |

| 33B | 4-bit | 64 | A100 80GB(需要双卡) |

| 65B | 4-bit | 64 | A100 80GB × 4 |

3.4 什么时候用QLoRA

优先使用QLoRA的场景:

- 单卡训练33B以上规模模型

- 显存小于40GB的GPU

- 追求最佳性价比

- 追求接近全量微调的效果

仍选择普通LoRA的场景:

- 模型规模在13B以下

- 有充足的显存资源

- 对训练精度要求极高

- 需要更快的训练速度

🔹四、训练数据准备:从零开始构建高质量数据集

4.1 数据收集:质量比数量更重要

很多人有一个误区:训练数据越多越好。实际上,在微调任务中,1000条高质量数据的,效果往往超过10000条低质量数据。

什么是高质量的微调数据?

标准一:格式规范

每条数据要包含清晰的输入和期望输出:

{

"instruction": "请根据以下产品描述,写一段电商推广文案",

"input": "产品名称:智能保温杯\n容量:500ml\n材质:316不锈钢\n功能:24小时保温保冷,LED温度显示\n价格:168元",

"output": "【新品上市】✨ 告别盲目喝水的时代!\n\n这款智能保温杯,24小时恒温守护,LED实时显温让每一口都是最佳温度。316不锈钢材质,168元升级生活品质,点击链接立刻拥有!"

}标准二:领域相关性

数据要来自目标领域真实的业务场景。如果是医疗场景,就用真实的病历、诊断报告;如果是法律场景,就用真实的判决书、合同条款。

标准三:多样性覆盖

数据要覆盖业务中的各种典型场景和边缘案例。不能全是”标准情况”,也要有”特殊情况”的处理方案。

4.2 数据清洗:去掉这五类脏数据

第一类:格式混乱

同一批数据里,格式五花八门——有的是JSON,有的是CSV,有的是纯文本。要么全部统一格式,要么全部清洗成纯文本。

第二类:噪声数据

输入或输出包含了无关信息,比如文本里混入了HTML标签、特殊字符乱码、截断的句子。

第三类:重复数据

完全相同或高度相似的样本反复出现。这会导致模型过拟合这些样本,影响泛化能力。

第四类:标注错误

输入和输出不匹配,或者输出的答案本身就是错的。这类数据会对模型造成误导,训练出来效果会很差。

第五类:分布偏移

训练数据和你实际要解决的问题分布差异太大。比如用英语数据训练,想要模型做中文任务。

4.3 数据增强:扩充你的数据集

当数据量不够时,可以用以下方法增强:

方法一:同义词替换

把输入中的某些词换成同义词,保持语义不变:

原文:”这个产品的价格是199元”

增强:”这个商品的售价为199元”

增强:”该产品定价199元”

方法二:回译法

把中文翻译成英文,再翻译回中文。语言表达会发生变化,但核心信息保持一致。

方法三:任务反转

对于对话数据,可以把问答对反转,训练模型的反向推理能力。比如把”问:什么是AI?答:AI是人工智能”变成”问:人工智能的英文是什么?答:AI”。

4.4 数据配比:平衡的艺术

如果你的训练数据来自多个来源,要注意各类数据的配比平衡。

常见问题:某类数据占比过高,导致模型对其他类别效果变差。

解决策略:

- 按任务重要性分配比例

- 预留10-20%数据作为验证集

- 训练过程中监控各类别的loss变化

🔹五、实战训练:从配置到上线

5.1 环境配置:GPU显存与依赖

最低配置要求(LLaMA-7B + QLoRA):

- GPU:NVIDIA RTX 3060 12GB 或更高

- 内存:16GB RAM

- 硬盘:30GB可用空间

- CUDA:11.7 或更高

推荐配置:

- GPU:NVIDIA RTX 4090 24GB 或 A100 40GB

- 内存:32GB RAM

- 硬盘:100GB SSD

核心依赖包:

pip install transformers datasets peft accelerate bitsandbytes

pip install torch torchvision torchaudio

pip install trl # 用于监督微调的训练框架5.2 完整训练代码框架

以下是一个QLoRA微调的完整示例:

from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig

from peft import LoraConfig, get_peft_model, prepare_model_for_kbit_training

from datasets import load_dataset

import torch

# 1. 加载模型(4-bit量化)

model_name = "meta-llama/Llama-2-7b-hf"

quantization_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_compute_dtype=torch.float16,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type="nf4"

)

model = AutoModelForCausalLM.from_pretrained(

model_name,

quantization_config=quantization_config,

device_map="auto"

)

# 2. 预处理模型

model = prepare_model_for_kbit_training(model)

# 3. 配置LoRA

lora_config = LoraConfig(

r=64,

lora_alpha=16,

target_modules=["q_proj", "v_proj"],

lora_dropout=0.05,

bias="none",

task_type="CAUSAL_LM"

)

model = get_peft_model(model, lora_config)

# 4. 加载数据

def format_prompt(example):

return f"### 问:{example['instruction']}\n\n### 答:{example['output']}"

dataset = load_dataset("json", data_files="train_data.jsonl")

dataset = dataset.map(lambda x: {"text": format_prompt(x)})

# 5. 开始训练

from trl import SFTTrainer

from transformers import TrainingArguments

training_args = TrainingArguments(

output_dir="./lora_model",

num_train_epochs=3,

per_device_train_batch_size=4,

gradient_accumulation_steps=4,

learning_rate=2e-4,

fp16=True,

logging_steps=10,

save_strategy="epoch"

)

trainer = SFTTrainer(

model=model,

train_dataset=dataset["train"],

args=training_args,

formatting_func=lambda x: x["text"]

)

trainer.train()

# 6. 保存LoRA权重

model.save_pretrained("./lora_model")5.3 关键参数调优指南

LoRA r(秩):

- r=8~16:参数量少,训练快,但表达能力有限

- r=32~64:平衡之选,推荐新手从r=64开始

- r=128~256:效果更好,但显存需求也更高

learning_rate(学习率):

- 1e-4 ~ 3e-4:标准学习率范围

- LoRA的learning_rate通常是全量微调的10倍左右

- 数据质量越高,可以用越大的学习率

batch_size:

- 越大越稳定,但显存需求越高

- 可以用gradient_accumulation_steps弥补

- 4是一个不错的起始值

5.4 模型部署:三种方案

方案一:LoRA热切换

保持基座模型不动,运行时动态加载不同的LoRA权重。适合需要多种能力的场景。

from peft import PeftModel

base_model = AutoModelForCausalLM.from_pretrained("meta-llama/Llama-2-7b-hf")

model = PeftModel.from_pretrained(base_model, "./lora_model")

model.merge_and_unload() # 合并权重方案二:纯LoRA推理

直接用LoRA权重推理,速度快但需要保留原始模型结构。

方案三:云端部署

使用vLLM、TensorRT-LLM等推理引擎,部署到云服务器,支持高并发。

🔹六、避坑指南:新手常见错误

6.1 灾难性遗忘

问题表现:微调后模型在某些通用任务上能力大幅下降,甚至基本的对话都不会了。

原因分析:LoRA虽然已经很大程度上缓解了这个问题,但如果学习率过高、训练时间过长,仍可能出现。

解决方案:

- 使用混合训练:训练数据中混入10-20%的通用对话数据

- 降低学习率,增加训练步数

- 使用PEFT的weight_decay参数限制新参数不要偏离太远

6.2 过拟合

问题表现:训练集loss持续下降,但验证集loss开始上升。模型在训练数据上效果好,在真实场景效果差。

原因分析:训练数据太少,或者训练轮次太多。

解决方案:

- 增加训练数据量

- 减少训练epoch

- 增大LoRA的dropout

- 使用早停(Early Stopping)

6.3 梯度爆炸

问题表现:训练loss突然变成NaN,或者模型输出全是乱码。

原因分析:学习率太高,或者数据中存在异常值。

解决方案:

- 大幅降低学习率(10倍以上)

- 检查数据清洗是否彻底

- 启用梯度裁剪(gradient_clipping)

6.4 数据泄露

问题表现:模型在测试集上效果极好,但实际使用时效果很差。

原因分析:训练集和测试集有重叠,或者数据划分时没有做到真正的随机。

解决方案:

- 训练前彻底打乱数据

- 确保训练集、验证集、测试集互不重叠

- 用真实场景数据做最终验证

总结

LoRA和QLoRA技术,让大模型微调不再是少数大公司的专利。普通开发者用一张消费级显卡,就能训练出专属的AI助手。

核心要点回顾:

1. LoRA的核心思想:用低秩矩阵替代全量参数更新,节省98%的训练参数量

2. QLoRA的创新:结合4-bit量化,进一步降低显存需求,10GB显存也能跑33B模型

3. 数据为王:1000条高质量数据的训练效果,往往超过10000条低质量数据

4. 避坑意识:注意灾难性遗忘、过拟合、梯度爆炸、数据泄露等问题

掌握这些技术,你就已经领先了90%的AI从业者。

互动话题:你在大模型微调过程中遇到过哪些坑?有什么独特的经验教训?欢迎在评论区分享,我们一起交流进步!

如果觉得这篇文章有帮助,别忘了点赞、收藏、关注,我会持续更新更多AI实战教程。