Stable Diffusion 3深度评测:100%理解提示词+8B参数,AI绘画新王者的诞生

2024年,Stable Diffusion 3横空出世,在AI绘画圈引发轰动。

它的核心技术换了一条路——不再用传统的U-Net架构,而是用了一种叫MMDiT的Transformer架构,类似于Sora。这种架构让AI第一次能”听懂”人类的意思,你描述什么,它就生成什么,几乎不出错。

更厉害的是,Stable Diffusion 3在三个核心能力上实现了突破:第一是图像质量,第二是多主体提示词,第三是文字渲染。尤其是文字渲染,Stable Diffusion 3能直接在图像中生成清晰的文字,这让之前的AI绘画工具望尘莫及。

Stable Diffusion 3的模型参数从800M扩展到8B,涵盖不同规模的部署需求。从手机到服务器,都能找到合适的版本。

这篇评测,我们不聊复杂的架构技术,只想回答一个问题:Stable Diffusion 3到底有多强,它将如何改变AI绘画的格局?

一、Stable Diffusion 3是什么

Stable Diffusion是Stability AI开发的AI图像生成模型系列,前两代产品(SD1.5、SD2.x)已经成为AI绘画领域的标杆。

Stable Diffusion 3是第三代产品,核心技术换了一条路——不再用传统的U-Net架构,而是用了一种叫MMDiT(Multi-Modal Diffusion Transformer)的新型架构。

MMDiT的核心创新是同时处理文本和图像两种模态的信息。在之前的版本中,文本信息和图像信息是分别处理的,容易出现”对不上”的问题——用户输入的提示词很精准,但生成的图像总是差点意思。MMDiT通过Transformer的自注意力机制,让文本和图像在生成过程中始终保持同步,大幅提升了提示词的还原度。

Stable Diffusion 3的另一个技术亮点是使用了Flow Matching(流量匹配)来训练Rectified Flow模型。这种方法通过最小化生成路径上的误差来改善模型性能,让图像生成更加高效准确。

从模型规模来看,Stable Diffusion 3提供了从800M到8B参数的多个版本。800M适合普通用户本地运行,8B适合专业创作者和商业部署。这种灵活的规模设计让不同需求的用户都能找到合适的版本。

二、核心功能详解

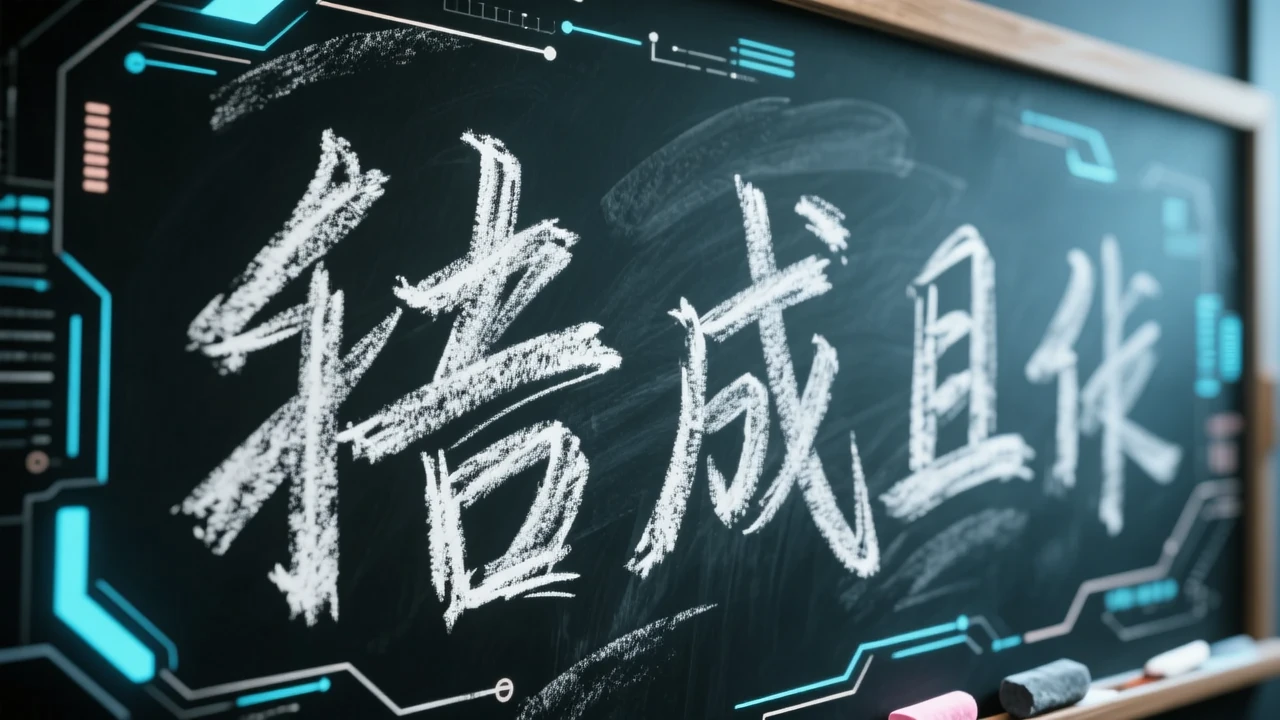

2.1 革命性的文字渲染能力

Stable Diffusion 3最令人惊艳的功能是文字渲染。

之前的AI绘画工具,生成图像中的文字一直是个难题。DALL-E 3在这个问题上也是”差点意思”。但Stable Diffusion 3做到了——它能在图像中直接生成清晰的文字,而且可以精确控制文字的内容、字体、颜色、位置。

你可以生成一张图片:黑板上写着粉笔字,字体随意但清晰可辨;或者一块公交站牌,霓虹效果的广告语在夜色中闪烁;甚至刺绣作品,布面上”绣”着一行行针脚分明的文字。这种文字渲染能力,在之前的AI绘画工具中是不可想象的。

网友评价说:这种prompt的一致性是我见过最好的。Stable Diffusion 3不仅能生成文字,还能保持文字与图像风格的一致性——霓虹灯效果就用霓虹字体,黑板就用粉笔字体,刺绣就用绣花线效果。

2.2 多主体提示词精准控制

Stable Diffusion 3的多主体提示词(Multi-Subject Prompts)能力也得到了质的飞跃。

之前的AI绘画工具在处理复杂提示词时,常常会出现”漏元素”的问题——用户输入了5个元素,AI可能只生成了3个,另外2个莫名其妙地消失了。

Stable Diffusion 3大幅改善了这个问题。你可以在一个提示词中随意添加多个元素——宇航员、穿着芭蕾舞裙的小猪、粉色雨伞、戴着礼帽的知更鸟——Stable Diffusion 3几乎能100%还原你描述的所有元素。

这种多主体控制能力对于创意工作者来说价值巨大。你可以创作更复杂的场景,把多个不相干的元素组合在一起,Stable Diffusion 3会帮你把它们有机地融合在一幅图像中。

2.3 物理世界理解能力

Stable Diffusion 3展现出了对物理世界的一定”理解”能力。

比如这个提示词:”一匹马优雅地站在一个五彩斑斓的球上,周围是一片生机勃勃的绿色草地。远处,一座雄伟的山峦巍峨地矗立。”

Stable Diffusion 3能正确处理马站在球上这个违反物理常识的场景,同时保持背景中山脉的合理性。更重要的是,它能理解空间关系——近景的球和草、中景的马、远景的山——这种前后关系在之前的AI绘画中是很难做到的。

在另一个测试中,Stable Diffusion 3能正确处理”红色球体在蓝色立方体上面,后面是绿色三角形,右边是狗,左边是猫”这种复杂的位置关系,DALL-E 3在同样的提示词下表现就差很多。

2.4 图像质量再进化

Stable Diffusion 3的图像质量整体提升了一个档次。

这种提升不来自于单一技术的突破,而是整个生成流程的优化。从数据处理到模型架构,从训练方法到采样算法,Stable Diffusion 3在每一个环节都做了改进,最终体现在输出图像的整体质量上。

具体表现为:细节更丰富、色彩更准确、光影更自然、构图更合理。无论是写实风格还是插画风格,Stable Diffusion 3都能提供高质量的输出。

三、使用方式与版本选择

3.1 官方在线版本

Stability AI提供了Stable Diffusion 3的官方在线版本,用户可以直接在网页上体验。

官方版本支持最新的SD3模型,提供简洁友好的操作界面,适合普通用户体验完整功能。

3.2 本地部署(秋叶整合包)

对于想要本地运行的用户,秋叶整合包是目前最流行的解决方案。

秋叶整合包(sd-webui-aki)基于AUTOMATIC1111 WebUI封装,特点是一键启动、内置模型管理、插件生态完整。适合零基础入门用户,不需要命令行操作。

配置要求:

| 项目 | 最低配置 | 推荐配置 |

|---|---|---|

| 系统 | Win10/Win11 64位 | Win11 |

| 显卡 | NVIDIA 4GB显存 | NVIDIA 8GB+ |

| 内存 | 8GB | 16GB+ |

| 磁盘空间 | 20GB | 50GB+ |

重点:必须是NVIDIA显卡,AMD或核显不支持。

3.3 专业工具(ComfyUI/InvokeAI)

对于专业创作者,ComfyUI和InvokeAI是更强大的选择。

ComfyUI提供模块化的节点工作流,适合需要精细控制的专业用户。InvokeAI提供行业领先的WebUI,专为Stable Diffusion优化。这两个工具都支持完整的SD3功能,适合高阶用户和商业创作。

四、应用场景

4.1 商业插画与设计

Stable Diffusion 3可以用于商业插画、品牌设计、营销素材等场景。

它的多主体提示词能力和文字渲染能力,让设计师可以用自然语言快速生成初稿,然后在此基础上精细调整。这种工作方式大幅提升了设计效率。

4.2 内容创作与自媒体

对于内容创作者和自媒体人,Stable Diffusion 3是强大的视觉素材生成工具。

你可以根据文章内容生成配图,根据视频主题生成封面,根据产品特点生成展示图。不需要设计基础,只需要描述你想要的画面,SD3就能帮你实现。

4.3 游戏与影视概念设计

游戏和影视行业可以用Stable Diffusion 3进行概念设计。

它的物理世界理解能力和多元素控制能力,让概念设计师可以快速生成场景、角色、道具的视觉参考。8B参数版本尤其适合需要高画质的商业项目。

4.4 教育与研究

教育机构可以用Stable Diffusion 3作为AI生成内容的教学案例。

它的MMDiT架构、Flow Matching训练方法都是当前AI研究的前沿方向,学生可以通过SD3直观理解这些技术的工作原理。

五、收费方案

5.1 官方订阅方案

| 方案 | 价格 | 主要权益 |

|---|---|---|

| 免费版 | 免费 | 基础功能,有使用限制 |

| Pro | $9.99/月 | 优先队列,更多额度 |

| Pro+ | $24.99/月 | 极速队列,大量额度 |

5.2 API接入

开发者可以通过API接入Stable Diffusion 3,计费方式按生成次数计算。具体价格根据使用量浮动。

5.3 本地部署成本

本地部署版本免费使用,但需要自备GPU硬件。一块RTX 3080以上的NVIDIA显卡是基本配置。

六、优缺点分析

6.1 优点

优点一,文字渲染能力领先。Stable Diffusion 3的文字渲染能力是目前最好的AI绘画工具之一,能在图像中生成清晰的文字。

优点二,多主体提示词精准。几乎100%还原用户描述的所有元素,不会有遗漏。

优点三,模型规模灵活。从800M到8B参数,不同规模适合不同场景。

优点四,开源可本地部署。相比DALL-E等闭源工具,SD3可以本地部署,保护隐私。

6.2 缺点

缺点一,硬件要求较高。8B参数版本需要高端GPU才能流畅运行。

缺点二,中文提示词支持有限。虽然支持中文输入,但英文提示词效果更好。

缺点三,内容安全限制。部分敏感内容无法生成,灵活性不如开源版本。

七、同类对比

7.1 Stable Diffusion 3 vs DALL-E 3

在文字渲染、多主体提示词、物理理解三个维度上,Stable Diffusion 3都优于DALL-E 3。

但DALL-E 3有更好的生态集成——它直接内置在ChatGPT中,使用更方便。对于非技术用户,DALL-E 3的门槛更低。

7.2 Stable Diffusion 3 vs Midjourney

Midjourney在艺术风格和美学质量上仍有优势,但SD3在提示词还原度和控制力上更强。

Midjourney适合追求美感的艺术创作,SD3适合需要精准控制的商业设计。

7.3 横向对比

| 工具 | 文字渲染 | 多主体控制 | 本地部署 | 生态成熟度 |

|---|---|---|---|---|

| Stable Diffusion 3 | 强 | 强 | 支持 | 一般 |

| DALL-E 3 | 弱 | 中 | 不支持 | 强 |

| Midjourney | 弱 | 中 | 不支持 | 强 |

八、法律与伦理问题

8.1 著作权争议

Stable Diffusion 3等AI绘画工具引发的著作权问题一直是行业焦点。

美国法院在Andersen v. Stability AI案中裁定:Stable Diffusion训练过程未构成对原告摄影作品的”实质性相似”使用,但模型输出若高度复现受保护作品独创性表达,仍可能触发侵权审查。

中国北京互联网法院在2023年”AI生成图片著作权纠纷案”中确认:用户对提示词结构、参数组合、多轮迭代修正等持续性智力投入,构成”创作性贡献”,赋予其著作权主体资格。

8.2 使用建议

建议用户:不直接复制在世艺术家风格生成图像;不对受版权保护作品进行高度复现;保留创作过程记录以备举证。

九、常见问题FAQ

Q1:Stable Diffusion 3需要什么配置才能运行?

A:8B参数版本推荐RTX 3090或同等性能GPU,800M版本RTX 3060即可运行。本地部署需要NVIDIA显卡。

Q2:Stable Diffusion 3收费吗?

A:官方在线版本有免费额度,高级功能需要订阅。本地部署版本免费使用。

Q3:Stable Diffusion 3能完全替代设计师吗?

A:不能。SD3可以提升设计效率,但创意思考、审美判断、客户服务等能力仍然需要人类设计师。

Q4:SD3生成的作品可以商用吗?

A:需要遵守Stability AI的使用条款和当地法律法规。建议保留创作记录,注意避免侵权风险。

Q5:Stable Diffusion 3和Midjourney哪个更好?

A:取决于使用场景。SD3提示词还原度更高,Midjourney艺术风格更美。选择哪个看具体需求。

Q6:中文提示词效果好吗?

A:SD3对英文提示词支持更好。建议用英文描述画面元素,或中英混合使用。

十、官网与下载链接

官方网站:https://stability.ai

Stable Diffusion 3介绍:https://stability.ai/news/stable-diffusion-3

使用方式:

| 平台 | 访问方式 | 链接 |

|---|---|---|

| 官方在线版 | 浏览器访问 | https://stability.ai |

| 秋叶整合包 | 本地安装 | GitHub搜索sd-webui-aki |

| ComfyUI | 专业工作流 | GitHub搜索ComfyUI |

订阅方案:

| 方案 | 价格 | 主要权益 |

|---|---|---|

| 免费版 | 免费 | 基础额度 |

| Pro | $9.99/月 | 优先队列 |

| Pro+ | $24.99/月 | 极速队列 |

本地部署配置:

| 项目 | 最低 | 推荐 |

|---|---|---|

| 显卡 | RTX 3060 4GB | RTX 3080 8GB+ |

| 内存 | 8GB | 16GB+ |

| 硬盘 | 20GB | 50GB+ |

十一、总结建议

Stable Diffusion 3代表了AI绘画的新高度。

它的MMDiT架构让文本和图像的融合达到了新水平,文字渲染能力和多主体控制能力都大幅提升。Flow Matching训练方法让模型更加高效,8B参数版本提供了专业级的图像质量。

对于AI绘画爱好者,Stable Diffusion 3是值得深入研究的工具。它的开源特性和灵活的部署方式,让任何人都可以体验最前沿的AI绘画技术。

对于商业用户,Stable Diffusion 3的生产力价值正在显现。多主体提示词和精准控制能力,让它可以胜任商业插画、品牌设计、内容创作等多种场景。

对于整个AI行业,Stable Diffusion 3证明了开源模型的竞争力。在DALL-E 3等闭源产品的压力下,Stability AI走出了自己的技术路线,这种竞争最终会让用户受益。

你用过Stable Diffusion 3吗?觉得它的文字渲染能力如何?AI绘画会取代人类画家吗?欢迎在评论区分享你的看法,一起探讨AI与创意产业的未来。