「AI绘画从0到1」Day9:ControlNet入门——从”抽卡”到”导演”的精准控制

前面8天,你已经学会了AI绘画的基本功:会写提示词、懂构图、能选模型调参数。但你一定遇到过这样的崩溃时刻——

提示词写了一大段,想要一个”抬手眺望的侧身站姿”,结果AI给你生成了正面大头照;想让角色”坐在地上抱着膝盖”,结果腿画反了、关节扭曲了。每次出图都像在”抽卡”,全凭运气。

今天,这个噩梦结束了。

ControlNet——这个被称为AI绘画”王炸”的插件,能让你从”抽奖选手”变成”片场导演”。你指定人物姿势,它就给你摆好;你画个线稿,它就给你上色;你给张参考图,它就精准复刻构图。

一句话:ControlNet让AI绘画从”听天由命”进化到”精准可控”。

这篇文章是「AI绘画从0到1」系列的第九篇。在前面的文章中,我们学习了Stable Diffusion的基础操作、提示词写法、构图技巧、参数调节和模型选择。今天的内容是整套系列中最关键的一个转折点——掌握ControlNet,你的AI绘画水平会直接上一个台阶。

今天这篇文章,零基础也能看懂。我们从原理讲起,手把手教你安装,然后用3个实战案例带你彻底掌握这个神级工具。

一、ControlNet到底是什么?

先打个比方。

传统的AI绘画就像你去餐厅吃饭,你跟服务员说”来道好吃的菜”。厨师心情好给你做个佛跳墙,心情不好可能给你端盘炒青菜。你没法控制结果,只能碰运气。

而ControlNet相当于你走进后厨,直接跟厨师说:”用三黄鸡、清蒸、放姜丝葱段、蒸12分钟”。每一步都有明确指令,结果自然精准可控。

再换一个更贴切的比喻:没有ControlNet的AI绘画就像给画家看一段文字描述让他画画,而有了ControlNet,你直接给了画家一张草图和参考照片。 文字描述可以有很多种理解方式,但草图和照片是具象的、无歧义的。

从技术角度看,ControlNet是2023年由斯坦福大学的研究者张吕敏(Lvmin Zhang)提出的一种神经网络架构,专门用于增强Stable Diffusion的控制能力。它作为Stable Diffusion的一个扩展插件存在,在原有的扩散模型旁边搭了一条”旁路”(也叫旁路分支),这条旁路接收你提供的控制信号(比如人物骨架、边缘线条、深度信息),然后把这些信号注入到AI的生成过程中,像一根无形的绳子牵引着画面走向你想要的方向。

关键点:ControlNet不替换你的大模型,它只是给大模型加了一个”导航系统”。

你用的大模型还是那个大模型,画风不变、质量不变,只是多了一层精准控制。就像你的车还是那辆车,只是加了GPS导航,再也不会走错路了。

ControlNet的工作原理(通俗版)

很多人看到”神经网络”、”旁路分支”这些术语就头疼。没关系,你不需要理解全部技术细节,只需要知道它是怎么工作的就够了。

整个过程可以分成三步:

第一步:预处理。 你上传一张参考图(比如一张人物照片),ControlNet的预处理器会先”看”这张图,从中提取出你想要的控制信息。如果你选的是OpenPose,它就会找出人体的骨架;如果你选的是Canny,它就会描出边缘线条。这一步得到的结果我们叫”控制图”。

第二步:特征注入。 ControlNet把控制图转换成一种特殊的数据格式(叫”特征向量”),然后在AI生成图片的每一步中,把这些特征”注入”到生成过程中。这就像在AI画画的时候,旁边有个人一直在说”这里画个手臂”、”这里画条腿”。

第三步:去噪生成。 AI在ControlNet的引导下,从噪声中一步步”雕刻”出符合控制图结构的画面。整个过程和普通文生图一样,只是多了一层来自ControlNet的约束。

理解了这个原理,你就明白为什么ControlNet能做到精准控制了——它不是在生成之后”修图”,而是在生成的每一步都在”指导”AI该怎么画。

ControlNet解决了什么问题?

在没有ControlNet之前,AI绘画有三大痛点:

第一,姿势不可控。 你写”一个跳舞的女孩”,AI可能理解成芭蕾、街舞、广场舞,甚至躺在地上”跳舞”。同一个提示词,每次生成的姿势都不同。

第二,构图不可控。 你说”左边一棵树,右边一间房子”,AI可能把树放在中间、房子放在天上。空间关系对AI来说是模糊的语义,不是精确的坐标。

第三,细节不可控。 你想要侧脸45度角,AI偏给你正脸。你想要双手举过头顶,AI偏给你一只手放下来。

ControlNet一出,这三个问题全部解决。它让AI从”自由发挥”变成了”按剧本演戏”。

ControlNet的版本历史

了解ControlNet的版本演进,有助于你选择合适的模型。

ControlNet 1.0(2023年2月):最初版本,由张吕敏发布。包含7个基础预处理器:Canny、Depth、HED、MLSD、Normal、OpenPose、Scribble。发布后迅速引爆AI绘画社区。

ControlNet 1.1(2023年4月):重大升级版。对所有原有模型进行了质量提升,同时新增了多个预处理器:Lineart、Shuffle、Inpaint、IP2P、Tile等。稳定性和出图质量都有显著提高。目前最主流的版本。

ControlNet for SDXL(2023年下半年):适配SDXL大模型的ControlNet版本。模型更大、效果更好,但对显存要求也更高(建议12GB以上)。

对于零基础用户,建议直接使用ControlNet 1.1版本,配合SD 1.5大模型使用。 这个组合对硬件要求最低、社区资源最多、教程最丰富。

二、六大预处理器:ControlNet的”眼睛”

ControlNet之所以强大,是因为它有多个不同的”预处理器”,每个预处理器就像一双不同功能的眼睛,从参考图中提取不同类型的控制信息。

零基础阶段,你只需要掌握最常用的6个就够了。

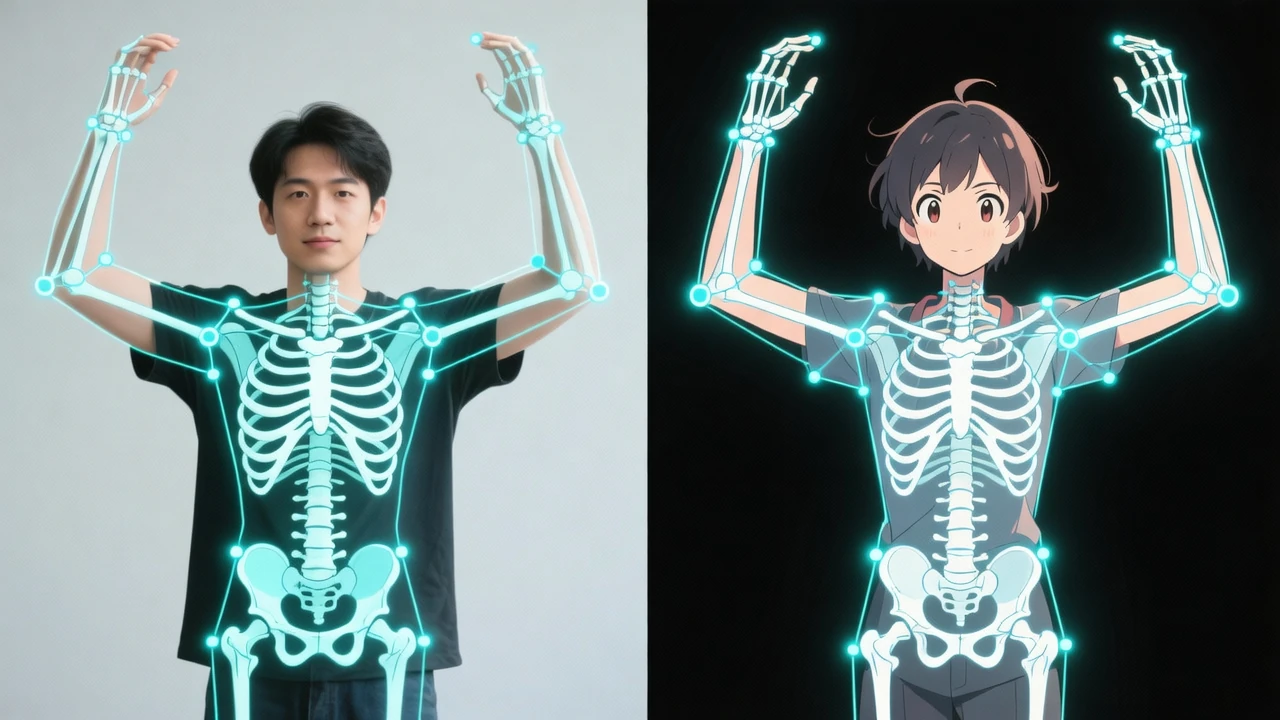

1. OpenPose——人体姿态控制(最常用!)

功能:从图片中提取人体骨架,包括头部、肩膀、手肘、手腕、膝盖等18个关键点,生成一张”火柴人”骨架图。

适用场景:控制人物姿势、动作、舞蹈造型、体育动作等。

通俗理解:OpenPose就像X光片,只看骨头不管皮。它不管人物长什么样、穿什么衣服,只关心”关节在哪里、四肢怎么摆”。

核心优势:你提供一张参考照片,AI就能提取出姿势骨架,然后按照这个骨架生成全新风格的人物。比如用真人照片提取姿势,生成二次元角色——姿势完全一致,风格天差地别。

预处理器选项:

- `openpose`:基础版,只检测身体关键点(头、颈、肩、肘、腕、髋、膝、踝)

- `openpose_full`:完整版,包含手部21个关键点和面部68个关键点(推荐!)

- `openpose_face`:仅检测面部关键点,适合头像特写

- `openpose_hand`:仅检测手部关键点,适合手势控制

使用建议:大多数情况用openpose_full就够了。只有当你需要非常精细的手部控制(比如弹钢琴的手势)时,才需要额外关注手部模型。

2. Canny——边缘线条检测

功能:从图片中提取边缘轮廓线,生成一张黑白线稿。Canny边缘检测算法是计算机视觉领域的经典算法,由John Canny在1986年提出。

适用场景:线稿上色、保持物体轮廓、建筑设计、产品外形控制。

通俗理解:Canny就像用铅笔把图片中的所有边缘描一遍。哪里有轮廓,哪里就有线条;哪里是平坦的色块,哪里就是空白。

核心优势:适合”保持外形、改变风格”的需求。比如你有一张建筑的照片,用Canny提取轮廓,然后让AI在这个轮廓内填入不同风格的材质和色彩——现代风、中式风、地中海风随意切换。

参数调节:Canny有两个重要阈值参数。低阈值(默认100)和高阈值(默认200)。阈值越低,检测到的边缘越多(包括噪点);阈值越高,只保留最明显的轮廓。大多数情况下,默认参数就够用了。

3. Depth——深度图控制

功能:从图片中提取空间深度信息,近处的物体亮、远处的物体暗,生成一张灰度深度图。

适用场景:控制场景的空间布局、前后景关系、室内设计构图。

通俗理解:Depth就像一张”距离地图”,白的地方离你近,黑的地方离你远。它告诉你”哪里是前景、哪里是背景、哪里是中景”,但不管具体是什么物体。

核心优势:适合需要保留空间感但改变内容的场景。比如保持一个房间的布局不变,但把家具从现代风换成中式风。

预处理器选项:

- `depth_midas`:使用Midas模型估计深度,最常用、效果最稳定

- `depth_leres`:使用LeReS模型估计深度,边缘更精确但速度稍慢

- `depth_zoe`:使用ZoeDepth模型,对室内场景效果特别好

使用建议:不确定用哪个就选depth_midas,这是最通用的选择。

4. Lineart——精细线稿

功能:提取比Canny更精细、更干净的线条稿。

适用场景:动漫线稿上色、插画创作、精细轮廓控制。

通俗理解:如果说Canny是”铅笔速写”,Lineart就是”钢笔精描”。它生成的线条更干净、更准确,特别适合动漫和插画风格。

核心优势:线稿质量更高,生成结果更稳定。如果你做的是动漫风格的创作,Lineart比Canny更合适。

预处理器选项:

- `lineart_realistic`:针对写实照片的线稿提取

- `lineart_anime`:针对动漫图片的线稿提取(做动漫风格选这个)

- `lineart_anime_denoise`:去噪版动漫线稿,线条更干净

5. Scribble——涂鸦控制

功能:接受简单的手绘涂鸦或草图作为控制输入。

适用场景:自由创作、概念设计、快速原型。

通俗理解:Scribble是最”宽容”的预处理器。你画几条粗线条、涂几个色块,它就能理解你的意图,不会像Canny那样要求精确的边缘。

核心优势:创作自由度最高。适合”我有个大概想法但不想画得太精确”的场景。随手画个草图,AI帮你变成精美的作品。

预处理器选项:

- `scribble_hed`:使用HED算法提取涂鸦线条,较柔和

- `scribble_pidinet`:使用PiDiNet算法,对边缘更敏感

- `scribble_xdog`:使用XDoG算法,可以控制线条粗细

使用建议:如果你想手动画草图控制,用scribble_pidinet效果最好。

6. Seg——语义分割

功能:将图片分割成不同的区域,每个区域代表一种物体类别(天空、建筑、道路、树木等),用不同颜色标注。

适用场景:场景设计、室内设计、城市规划、风景构图。

通俗理解:Seg就像一张”区域规划图”。蓝色区域是天空,绿色区域是草地,棕色区域是建筑。它告诉AI”这块区域放什么类型的东西”,但不指定具体细节。

核心优势:适合大场景的构图控制。比如室内设计师可以用Seg指定”这个位置是沙发区、那个位置是餐桌区”,然后让AI填入不同风格的家具。

预处理器选项:

- `seg_ufade2k`:使用UFADE2K数据集训练,适用于室内和室外场景

- `seg_ofade2k`:使用OFADE2K数据集,通用性更强

- `seg_ofcoco`:使用COCO数据集训练,物体类别识别更丰富

六大预处理器速查表

在实际使用中,怎么选预处理器?记住这个简单的选择逻辑:

- 要控制人物姿势 → OpenPose(绝对首选)

- 要保持物体轮廓 → Canny 或 Lineart

- 要控制空间布局 → Depth 或 Seg

- 要自由手绘创作 → Scribble

- 不确定用什么 → 先试OpenPose和Canny,这两个覆盖80%的场景

三、安装ControlNet插件

知道原理了,现在来动手安装。以下三种方式任选其一即可。

方式一:WebUI内直接安装(推荐)

这是最简单的方式,适合大多数人。

第一步:打开Stable Diffusion WebUI,点击顶部菜单栏的”Extensions”(扩展)。

第二步:点击”Available”(可用)标签页,等待列表加载完成。如果加载慢,可以取消勾选”Localization”过滤项。

第三步:按 Ctrl+F 搜索”controlnet”,找到”sd-webui-controlnet”插件。

第四步:点击右侧的”Install”(安装)按钮,等待安装完成。

第五步:安装完成后,点击页面上方黄色提示条”Apply and restart UI”,重启WebUI。

重启后,在文生图(txt2img)和图生图(img2img)界面底部,你应该能看到”ControlNet”标签页了。

方式二:通过URL安装

如果方式一搜索不到插件,可以用URL手动安装。

第一步:点击”Extensions” → “Install from URL”标签页。

第二步:在输入框中粘贴仓库地址:https://github.com/Mikubill/sd-webui-controlnet.git

第三步:点击”Install”按钮,等待日志显示安装成功。

第四步:切换到”Installed”标签页,勾选”sd-webui-controlnet”,点击”Apply and restart UI”。

方式三:命令行安装

如果你习惯用命令行,或者WebUI安装遇到问题,可以直接用git克隆。打开终端,进入SD WebUI的extensions目录,执行git clone命令克隆仓库。克隆完成后,重启WebUI即可。

安装预处理器模型

插件安装完成后,还需要下载预处理器模型。好消息是:大部分预处理器模型会在第一次使用时自动下载。坏消息是:国内网络下载可能很慢,甚至失败。

解决方案汇总:

方案一:使用Hugging Face镜像站。将下载链接中的 huggingface.co 替换为 hf-mirror.com,大多数模型都能正常下载。

方案二:手动下载。在电脑上能访问Hugging Face的环境中下载好模型文件,然后复制到SD WebUI的对应目录中。

方案三:使用整合包。如果你使用的是B站大佬的SD整合包(比如秋叶包),预处理器模型通常已经内置了,不需要额外下载。

安装ControlNet模型

插件和预处理器都装好后,还需要下载ControlNet的控制模型。这些模型文件比较大(每个约1.5GB-7GB),需要一定的时间和存储空间。

对于SD 1.5用户:搜索”lllyasviel/ControlNet-v1-1″,下载sd15版本的模型文件。常用模型包括:

- control_v11p_sd15_openpose.pth(约1.5GB)

- control_v11p_sd15_canny.pth(约1.5GB)

- control_v11f1p_sd15_depth.pth(约1.5GB)

- control_v11p_sd15_lineart.pth(约1.5GB)

对于SDXL用户:搜索”diffusers/controlnet-canny-sdxl-1.0″等,下载SDXL版本的ControlNet模型。

下载后,将模型文件放到:extensions/sd-webui-controlnet/models/ 目录下。

存储空间提醒:如果你打算把所有ControlNet模型都下载下来,大概需要30-50GB的硬盘空间。建议先只下载最常用的3-4个(OpenPose、Canny、Depth、Lineart),后续根据需要再补充。

四、实战案例1:用OpenPose控制人物姿势

理论讲完了,来真刀真枪干一场。

场景设定

目标:参考一张真人照片的站姿,用AI生成一个二次元风格的少女,保持完全相同的身体姿态。

换句话说:真人照片提供姿势,AI负责画出二次元角色。

操作步骤

第一步:准备参考图

找一张人物姿态清晰的照片。可以是自己拍的、网上找的,任何包含清晰人体姿态的图片都行。注意:照片中的人物姿态越清晰,OpenPose提取的骨架越准确。

最佳参考图的特征:

- 人物全身可见(至少能看到头到脚)

- 背景简洁,不要有太多干扰

- 姿态明确,不要有太多遮挡

- 分辨率不要太低(至少512像素以上)

第二步:设置基础参数

在文生图界面,先设置好基础参数:

- 采样器:DPM++ 2M Karras(稳定推荐)

- 采样步数:20-30步

- 图片尺寸:512×768(竖版人像)或768×512(横版)

- CFG Scale:7(默认值即可)

第三步:写提示词

正向提示词中要包含你想要的人物描述和风格。例如:”1girl, anime style, beautiful detailed eyes, long hair, white dress, standing, masterpiece, best quality”。

注意:提示词中描述的姿势要和参考图一致,比如参考图是站姿就写”standing”,是坐姿就写”sitting”。虽然OpenPose会控制姿势,但提示词的一致性能增强效果。

反向提示词:””low quality, worst quality, blurry, deformed, bad anatomy, extra limbs, missing limbs””。

第四步:配置ControlNet

向下滚动到ControlNet面板:

1. 勾选”Enable”(启用)

2. 上传你的参考图到ControlNet的图片框中

3. 预处理器选择:openpose_full(完整姿态检测)

4. 模型选择:control_openpose(或control_v11p_sd15_openpose)

5. Control Weight保持默认1.0

第五步:点击生成

一切就绪,点击”Generate”按钮。等待几秒到几十秒,你就会看到一个二次元少女,摆着和参考照片完全一样的姿势。

效果对比

用ControlNet和不用ControlNet的区别非常明显:

不用ControlNet:同一个提示词生成10张图,人物姿势可能完全不同——有的站着、有的坐着、有的正面、有的侧面。完全随机,不可预测。

用ControlNet:10张图中的人物姿势高度一致,都是你指定的那个姿态。可能服装、发型、表情有变化,但身体姿势完全锁定。

这就是”抽卡”和”导演”的区别。

Control Weight调节技巧

ControlNet面板中有一个”Control Weight”参数,它决定了控制信号的强度。默认值是1.0,但你可以根据需要调整:

- Weight 0.5-0.8:弱控制。姿势大致相似,但AI有更多自由发挥空间。适合”参考一下就行”的需求。这时候生成的图会更自然,但姿势可能有轻微偏差。

- Weight 1.0-1.2:标准控制。姿势高度一致,同时保留AI的创造力。大多数情况用这个范围,平衡了准确性和自然感。

- Weight 1.5以上:强控制。姿势几乎完全锁定,但可能导致画面过于僵硬、不自然,甚至出现畸形。

建议新手从1.0开始,效果不理想再微调。记住一个经验:宁可偏低也不要偏高,太强的控制往往适得其反。

五、实战案例2:用Canny实现线稿上色

场景设定

目标:你有一张手绘的动漫线稿,想让AI自动上色,而且保持线稿的轮廓不变。

这是一个非常实用的场景。很多画师朋友都有这样的需求——线稿画好了,但上色太费时间。有了ControlNet的Canny模型,上色效率可以提升10倍以上。

操作步骤

第一步:准备线稿

可以是自己画的、从网上找的,或者用AI生成后提取的线稿。线稿越清晰、线条越干净,效果越好。

线稿准备的小技巧:

- 如果是手绘线稿,建议用黑色笔画在白色纸上,扫描或拍照后做白平衡校正

- 线条不要太细太淡,否则Canny可能检测不到

- 如果线稿有杂点,可以用PS或在线工具先清理一下

第二步:设置提示词

正向提示词描述你想要的上色效果:”1girl, blue eyes, blonde hair, school uniform, colorful, anime style, masterpiece, best quality”。

提示词中要包含颜色信息(”blue eyes”、”blonde hair”),这样AI才能按照你的要求配色。如果提示词中没有颜色描述,AI会随机配色。

反向提示词:”low quality, worst quality, blurry, deformed”。

第三步:配置ControlNet

1. 勾选”Enable”

2. 上传线稿图

3. 预处理器选择:canny(如果是已经处理好的线稿,也可以选”none”,直接用原图作为控制图)

4. 模型选择:control_canny(或control_v11p_sd15_canny)

5. Control Weight:1.0

第四步:生成

点击生成,AI会严格按照线稿的轮廓进行上色。你可以多次生成,每次的颜色搭配不同,但轮廓始终一致。

快速生成配色方案

Canny上色最实用的技巧之一:用不同的随机种子批量生成配色方案。

保持所有参数不变,只改变随机种子(Seed),每生成一张图就是一个新的配色方案。你可以一次生成10-20张,挑选最满意的配色。

具体操作:

- Seed设为”-1″(随机种子)

- Batch count设为10或20

- 点击Generate,一次出10-20张不同配色

Canny的两个阈值参数详解

在Canny预处理器中,有两个重要参数:

Low Threshold(低阈值):默认100。梯度值低于此值的像素被判定为非边缘,直接丢弃。

High Threshold(高阈值):默认200。梯度值高于此值的像素被判定为强边缘,全部保留。

两个阈值之间的像素被判定为弱边缘,只有当它们与强边缘相连时才保留。

简单理解:阈值越低,检测到的边缘越多(包括细节和噪点);阈值越高,只保留最明显的边缘。

调节建议:

- 线稿很干净 → 保持默认(100/200),效果就很好

- 想保留更多细节(比如头发丝、衣服褶皱) → 降低两个阈值(50/100)

- 想只保留主要轮廓(简化控制) → 提高两个阈值(200/400)

- 照片类素材 → 可以试试(50/150),保留更多自然边缘

六、实战案例3:用Depth控制场景构图

场景设定

目标:你有一张室内设计参考图,想保持空间布局不变,但把装修风格从现代风变成中式风。

这个场景对于室内设计师来说简直是”神器”——以前要出一张不同风格的效果图,得找设计师重新建模渲染,现在只需要几秒钟。

操作步骤

第一步:准备参考图

找一张室内照片,或者你自己的房间照片。Depth会提取空间深度信息,近处的家具会更亮,远处的墙壁和窗户会更暗。

第二步:设置提示词

正向提示词:”a Chinese style living room, wooden furniture, traditional Chinese decoration, warm lighting, ink painting on wall, calligraphy scroll, bamboo plants, masterpiece, best quality”。

提示词中要包含你想要的风格元素,比如”Chinese style”、”wooden furniture”、”ink painting”等。描述得越具体,AI填充的细节越丰富。

反向提示词:”modern furniture, plastic, glass, low quality, worst quality”。

反向提示词中加入不想要的元素(”modern furniture”、”plastic”),确保风格转换彻底。

第三步:配置ControlNet

1. 勾选”Enable”

2. 上传室内参考图

3. 预处理器选择:depth_midas(最常用的深度估计模型)

4. 模型选择:control_depth(或control_v11f1p_sd15_depth)

5. Control Weight:1.0

第四步:生成

AI会按照参考图的空间布局,用中式风格重新”装修”这个房间。近景是沙发位置(变成了中式木沙发),中景是茶几区域(变成了红木茶几),远景是窗户和墙壁(挂上了水墨画)。

空间结构完全保留,风格彻底改变。

Depth vs Seg:该用哪个?

你可能会问:Depth和Seg都可以控制场景构图,该用哪个?

简单判断标准:

- 如果你要保留的是空间距离感和前后景关系 → 用Depth

- 如果你要保留的是不同区域的功能分区(这里是天空、这里是建筑) → 用Seg

- 室内设计 → Depth更合适,因为它能精确保留家具与墙壁的距离关系

- 城市鸟瞰图 → Seg更合适,因为它能区分建筑、道路、绿地等不同区域

提升Depth效果的小技巧

技巧一:参考图选择有层次感的场景。 如果参考图是一个平面的墙壁,Depth提取不出有用的深度信息。选择有前景、中景、远景的场景效果最好。

技巧二:可以微调深度图。 如果你有图像编辑经验,可以在预处理后手动编辑深度图(比如把某个区域调亮表示拉近),然后跳过预处理器,直接用编辑后的深度图。

技巧三:适当降低Weight。 Depth控制场景时,Weight设为0.7-0.8往往比1.0更自然,因为AI可以在保持空间布局的同时自由发挥细节。

七、进阶技巧:组合使用多个ControlNet

当你熟练掌握单个ControlNet后,可以尝试同时启用多个ControlNet,叠加不同的控制信号。

如何启用多个ControlNet

在WebUI的设置中,找到ControlNet相关的选项,将”Multi ControlNet: Max models amount”从1改为2、3或4。改完后重启WebUI,你就能看到多个ControlNet面板了。

每个面板可以独立设置不同的预处理器和模型,互不干扰。

常见组合方案

方案一:OpenPose + Depth(人物+场景)

同时控制人物姿势和场景深度。适合”人物在特定空间中摆出特定姿势”的需求。比如在一间特定的房间里,让模特摆出一个特定的舞蹈动作。

两个ControlNet的Weight分配建议:OpenPose 0.8 + Depth 0.6。

方案二:OpenPose + Canny(姿势+轮廓)

同时控制人物姿势和服装轮廓。适合需要精确控制人物整体形象的场景。比如换脸换装时保持服装的轮廓线条。

两个ControlNet的Weight分配建议:OpenPose 0.8 + Canny 0.7。

方案三:Canny + Depth(轮廓+空间)

同时控制物体轮廓和空间布局。适合室内设计、建筑设计等场景。既能保持家具的外形,又能保持空间的纵深感。

两个ControlNet的Weight分配建议:Canny 0.7 + Depth 0.6。

多ControlNet使用注意事项

1. 总Weight控制:同时启用多个ControlNet时,每个的Weight应该适当降低,总和建议不超过1.5。否则画面容易过曝或畸形。

2. 显存消耗:每多启用一个ControlNet,大约多消耗1-2GB显存。8GB显存的显卡建议最多同时用2个。

3. 预处理时间:每个ControlNet的预处理器都会增加处理时间。如果等待太久,可以考虑把预处理结果缓存起来重复使用。

八、常见问题与避坑指南

在使用ControlNet的过程中,新手经常会遇到一些问题。这里整理了最常见的坑和解决方案。

问题1:生成的图和参考图一模一样

原因:Control Weight太高,ControlNet的控制信号压过了提示词的影响。

解决:降低Control Weight到0.7-0.8;或者在提示词中加入更多不同于参考图的描述。例如参考图是照片,就在提示词中强调”anime style”、”oil painting”等风格。

问题2:OpenPose检测不到人体

原因:参考图中的人物太小、太模糊、被遮挡,或者不是标准的人体姿态(比如躺着、蜷缩着)。

解决:换一张人物清晰、姿态明确的参考图。全身照比半身照效果好,正面或侧面比背面好。如果人物太小,可以先裁剪图片放大人物再上传。

问题3:生成的图有明显的”控制痕迹”

表现:画面上有一些奇怪的线条或色块,看起来像是控制图直接印在了画面上。

原因:Control Weight过高,或者预处理器和模型不匹配(比如用了OpenPose的预处理器但选了Canny的模型)。

解决:降低Weight;检查预处理器和模型是否正确配对。预处理器和模型必须一一对应,不能混用。

问题4:显存不足(OOM / Out of Memory)

表现:生成时报错”CUDA out of memory”。

原因:同时启用了太多ControlNet,或者图片尺寸太大。

解决:

- 减少同时启用的ControlNet数量

- 降低图片分辨率(从768降到512)

- 在WebUI启动参数中添加–medvram或–lowvram

- 如果显存小于8GB,建议只用单个ControlNet,图片尺寸不超过512×512

问题5:ControlNet面板不显示

原因:插件安装不完整,或者WebUI版本太旧不兼容。

解决:

- 检查Extensions → Installed列表中是否已启用ControlNet插件

- 更新WebUI到最新版本

- 如果是从URL安装的,尝试卸载后用git clone方式重新安装

- 检查控制台是否有报错信息

问题6:预处理器模型下载失败

原因:国内网络无法正常访问Hugging Face。

解决:

- 使用Hugging Face镜像站(hf-mirror.com)

- 手动下载模型文件后放到对应目录

- 使用包含预处理器模型的SD整合包

问题7:生成效果和预期差距很大

可能原因及解决方案:

- 提示词和ControlNet的控制方向冲突 → 确保提示词的描述与控制图一致

- Control Weight过高或过低 → 尝试0.7-1.2范围内的不同值

- 采样步数太少 → 增加到25-30步

- 图片尺寸不匹配 → 参考图和生成图的宽高比尽量保持一致

九、ControlNet的实际应用场景

学完ControlNet后,你可以在这些场景中大展身手:

电商产品图:用Canny保持产品轮廓,让AI生成不同风格的背景和场景。一件衣服可以出现在沙滩、办公室、咖啡厅等各种场景中,省去了大量的实拍成本。

游戏角色设计:用OpenPose设定角色的标准站姿和战斗姿态,然后用不同的提示词快速生成各种角色外观方案。以前画一个角色的各种姿态要花几天,现在几分钟搞定。

室内设计方案:用Depth保持空间布局,让AI生成不同装修风格的效果图。一个户型可以快速出10种不同风格的设计方案,供客户选择。这对室内设计师来说是效率革命。

动漫插画创作:用Lineart保持线稿轮廓,让AI自动上色。画师只需画好线稿,上色效率提升10倍以上。而且可以批量生成多种配色方案,选择最优。

短视频分镜:用OpenPose控制每个镜头中人物的动作,批量生成分镜草图,大幅提高前期策划效率。

建筑可视化:用Seg控制建筑群的布局,快速生成不同天气、不同时间段、不同风格的建筑效果图。比传统的3D渲染快了几个数量级。

教育领域:用ControlNet生成历史场景、科学概念的可视化图像,帮助学生理解抽象概念。

个性化定制:将自己的照片用ControlNet转换成各种艺术风格(油画、水彩、素描),制作个性化的头像、壁纸和头像。

摄影创作辅助:摄影师可以用Depth控制景深效果,用OpenPose预设模特姿势,在拍摄前就预览最终效果,节省大量的试拍时间。

漫画批量生产:用OpenPose批量生成不同角色的同一组动作,配合Lineart上色,可以快速产出漫画分页。以前一个漫画家一天画一页,现在可以一天出十页草稿。

AI写真馆:这是最近很火的商业模式。用顾客的照片提取OpenPose骨架,然后生成各种风格的写真(古风、赛博朋克、迪士尼公主风等),单张收费几十到上百元。ControlNet让这个业务成为可能,因为它保证了生成的姿势和本人一致,不会出现认不出是谁的尴尬。

十、今日总结:从”会用”到”用好”

回顾今天的内容,ControlNet的核心要点可以概括为三句话:

第一,ControlNet是AI绘画的”导航系统”。 它不改变你的车(大模型),但能让你精准到达目的地(生成你想要的图)。有了它,AI绘画从”碰运气”变成了”有方向”。

第二,六大预处理器是六双不同的”眼睛”。 OpenPose看姿势、Canny看轮廓、Depth看距离、Lineart看线条、Scribble看涂鸦、Seg看区域。选对眼睛,事半功倍。

第三,从实战中学习,比看100篇教程都管用。 不要只看不练,今天就打开你的WebUI,把三个实战案例都做一遍。

记住一个原则:先用好一个ControlNet,再尝试组合多个。 很多新手一上来就想同时用三四个控制源,结果参数调不好、显存不够用、效果一团糟。先把OpenPose用熟了,再慢慢扩展。

ControlNet的出现,让AI绘画从”玩具”变成了”工具”。它让设计师、画师、建筑师、电商从业者都能真正把AI用到工作中,而不仅仅是玩玩而已。

如果你已经跟着这个系列学到了Day9,恭喜你——你已经不再是AI绘画的门外汉了。接下来的Day10,我们将深入学习图生图(img2img)——从参考图到完美作品的进阶技巧。

今日练习

基础练习:找一张你最喜欢的动漫角色图片,用OpenPose提取姿势,然后用不同的提示词生成3个不同风格的角色(写实风、Q版、像素风),看姿势是否一致。

进阶练习:找一张简单的线稿,用Canny进行上色。尝试调整提示词中的颜色描述,生成至少5种不同配色方案。

挑战练习:同时启用OpenPose和Depth两个ControlNet,找一张”人物在特定场景中”的参考图,生成一张风格完全不同但构图完全一致的作品。

做完这三个练习,你就从”AI绘画新手”正式晋级为”AI绘画导演”了。ControlNet是你在AI绘画道路上最重要的武器之一,值得花时间反复练习和探索。

系列进度

- Day1:AI绘图底层逻辑 ✅

- Day2:Stable Diffusion快速上手 ✅

- Day3:提示词基础语法 ✅

- Day4:五大万能构图公式 ✅

- Day5:参数设置入门 ✅

- Day6:模型选择指南 ✅

- Day7:AI绘画变现路径 ✅

- Day8:头像定制实战演练 ✅

- Day9:ControlNet入门 ← 今天

- Day10-Day15:敬请期待

下一篇文章,我们将深入学习图生图(img2img)——从参考图到完美作品的进阶技巧。如果你觉得今天的内容有帮助,记得分享给同样在学AI绘画的朋友。