马斯克点赞!Kimi 对 AI 底层架构动手术,10 年残差连接首次被改写

导语

真正的创新,不是在前人基础上修修补补,而是敢于对”祖传地基”动刀。

2026 年 3 月 16 日,月之暗面 Kimi 发布了一项技术报告《Attention Residuals》(注意力残差),重新设计了深度学习中核心的残差连接结构。这份报告连续三天登上 Twitter 全球热搜榜,主贴阅读量超过 460 万,堪比一次重大模型版本发布。

更令人意外的是,马斯克在 Twitter 上罕见点赞:”Kimi 的研究令人印象深刻(Impressive work from Kimi)”。Kimi 官方幽默回应:”你的火箭造得也不错!”

在 AI 领域,能让马斯克真心认可的技术,屈指可数。

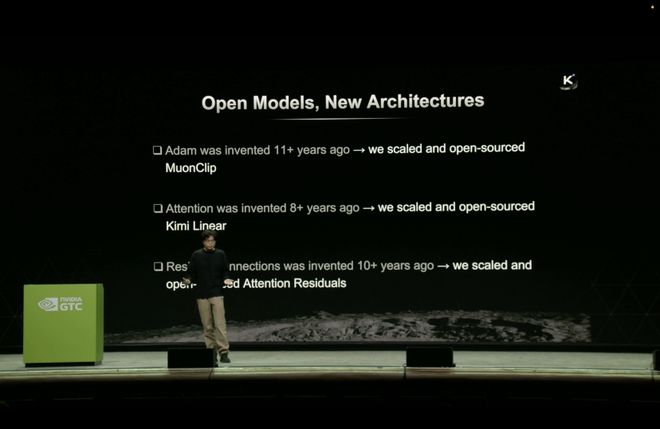

两天后,月之暗面创始人杨植麟站在英伟达 GTC 2026 的舞台上,成为唯一受邀演讲的中国大模型公司创始人。他首次完整披露了 Kimi K2.5 的技术路线图,揭示了这场”底层革命”的全貌。

今天,我们就来深度解读这场可能改写 AI 历史的技术突破。

一、事件概述:一场”动地基”的革命

技术报告发布

- 发布时间:2026 年 3 月 16 日

- 报告名称:《Attention Residuals》(注意力残差)

- 核心突破:重新设计残差连接结构

- 效果:48B 模型训练效率提升 1.25 倍

- 行业反响:Twitter 热搜 3 天,阅读量 460 万+

大佬评价

马斯克(xAI 创始人):

“Impressive work from Kimi”(Kimi 的研究令人印象深刻)

Jerry Tworek(前 OpenAI 研究副总裁,”推理模型之父”):

“深度学习 2.0 要来了”

Andrej Karpathy(前 OpenAI 联合创始人):

“我们对《Attention Is All You Need》这篇 Transformer 开山之作的理解还是不够”

当行业大佬都用”2.0″来形容时,你就知道这不是小打小闹。

GTC 演讲

- 时间:2026 年 3 月 18 日(北京时间凌晨)

- 地点:英伟达 GTC 2026 大会(美国圣何塞)

- 演讲主题:《How We Scaled Kimi K2.5》

- 演讲者:杨植麟(月之暗面创始人兼 CEO)

- 特殊身份:唯一受邀演讲的中国大模型公司创始人

二、核心数据:技术突破的硬指标

三大技术突破

| 技术名称 | 替代对象 | 性能提升 | 状态 |

|---|---|---|---|

| MuonClip 优化器 | AdamW(2014 年) | 计算效率提升 2 倍 | 已开源 |

| Kimi Linear | Full Attention(2017 年) | 解码速度提升 5-6 倍 | 已开源 |

| Attention Residuals | 残差连接(2015 年) | 训练效率提升 1.25 倍 | 已开源 |

用 8-9 年前的技术标准,当然跑不出 2026 年的智能水平。

性能对比

MuonClip vs AdamW:

- Token 效率:提升 100%

- 稳定性:解决 Logits 爆炸问题

- 适用规模:支持万亿参数模型训练

Kimi Linear vs Full Attention:

- 128K 上下文:解码速度提升 5 倍

- 1M 上下文:解码速度提升 6 倍

- 不同长度场景:均保持优异性能

Attention Residuals vs 传统残差连接:

- 48B 模型训练效率:提升 1.25 倍

- 信息选择性:动态聚合,不再”无差别叠加”

- 训练稳定性:显著改善

商业化数据

根据杨植麟演讲和多方信源:

- Kimi K2.5 发布时间:2026 年 1 月底

- 发布后 20 天收入:超过 2025 年全年

- 海外收入占比:超过 50%(首次超过国内)

- 海外 API 日均访问量:增长 10-20 倍

- Kimi Claw 订阅订单:1 月环比增长 8280%,2 月再涨 123.8%

- 估值增长:3 个月翻 4 倍,最新估值 180 亿美元

技术突破的最终检验标准,是用户用真金白银投票。

三、深度分析:为什么要对”祖传技术”动刀?

1. 残差连接:10 年未变的”地基”

什么是残差连接?

残差连接(Residual Connection)是深度学习中的核心架构,由何恺明等人在 2015 年的 ResNet 论文中提出。它的逻辑很简单:

每一层的输出 = 当前层的结果 + 前面数层的累加为什么需要残差连接?

想象一下,如果你要记住一本书的内容,你会:

- 方案 A:只记每一章的总结

- 方案 B:每一章都记住,并且把前面的内容也带上

残差连接就是方案 B。它让每一层都能”记住”前面所有层的信息,这样网络可以训练得很深(几十层甚至上百层)而不崩溃。

简单的设计,往往最持久。但持久不代表完美。

问题出在哪里?

Kimi 团队发现,传统残差连接有一个致命缺陷:“无差别叠加”。

具体来说:

- 每一层的贡献都是等权累加

- 没有任何机制判断哪层信息更重要

- 随着层数增加,早期层信息被稀释

- 后面的层必须输出更大的激活值才能产生影响,导致训练不稳定

就像开会,如果每个人发言权重一样,重要意见反而会被淹没。

2. Kimi 的解决方案:让网络自己决定”听谁的”

Attention Residuals 的核心思想:

既然不想要”无差别累加”,那就让网络自己决定该提取什么信息。具体来说:

- 传统方案:每一层输出 = 当前层 + 前面所有层的固定求和

- Kimi 方案:每一层输出 = 当前层 + 对前面各层的选择性注意力聚合

关键创新:

- 引入 Softmax 注意力机制

- 每一层可以动态选择关注哪些前序层

- 重要信息被放大,噪声被过滤

- 解决了”信息稀释”顽疾

从”全盘接收”到”选择性吸收”,这是 AI 架构的质变。

3. 三大技术突破的内在逻辑

杨植麟在 GTC 演讲中,将 Kimi K2.5 的进化逻辑归纳为三个维度的共振:

智能水平 = Token 效率 × 长上下文 × 智能体集群维度一:Token 效率(MuonClip 优化器)

- 问题:Adam 优化器(2014 年)在超大规模训练中遇到瓶颈

- 突破:MuonClip 实现 2 倍计算效率

- 意义:用更少的算力,榨取更多的智能

在算力为王的时代,效率就是竞争力。

维度二:长上下文(Kimi Linear)

- 问题:Full Attention(2017 年)在超长上下文中效率低下

- 突破:混合线性注意力架构,1M 上下文解码速度提升 6 倍

- 意义:让模型真正”读得懂”长文档

维度三:智能体集群(Orchestrator 机制)

- 问题:单智能体处理复杂任务能力有限

- 突破:将任务拆解给数十个子 Agent 并行处理

- 意义:从”单兵作战”到”集团军作战”

未来的 AI 竞争,不是单个模型的竞争,而是生态体系的竞争。

四、各方反应:全球 AI 圈怎么看?

硅谷大佬

马斯克(xAI 创始人):

“Impressive work from Kimi”

(随后 Kimi 官方回应:”你的火箭造得也不错!”)

Andrej Karpathy(前 OpenAI 联合创始人):

“我们对《Attention Is All You Need》这篇 Transformer 开山之作的理解还是不够”

Jerry Tworek(前 OpenAI 研究副总裁):

“深度学习 2.0 要来了”

能让批评过 OpenAI、Anthropic 的马斯克点赞,含金量不言而喻。

国内行业

某头部大模型公司技术负责人(匿名):

“Kimi 这次确实是底层创新,不是调参。我们内部也在研究类似方向。”

AI 投资人李峰(某一线基金):

“技术突破 + 商业化验证 + 资本认可,Kimi 已经形成了正向循环。”

高校 AI 教授(匿名):

“这项工作最大的价值,是证明了在’古老’架构上仍有突破空间。这会激励更多人重新审视基础问题。”

开发者社区

GitHub 开发者评论:

“已经试用了开源的 MuonClip,训练速度确实快了不少。希望 Kimi 继续开源更多技术。”

知乎 AI 话题优秀回答者:

“Kimi 这次不是’中国版 ChatGPT’,而是在定义下一代模型架构。”

从”跟随者”到”引领者”,Kimi 走了 3 年。

资本市场

根据公开信息:

- 最新融资:180 亿美元(2026 年 3 月)

- 投后估值:180 亿美元

- 3 个月涨幅:4 倍(从 45 亿美元到 180 亿美元)

- 投资方:红杉中国、高瓴资本、腾讯投资等

资本永远流向最有价值的地方。

五、技术细节:给专业人士的干货

MuonClip 优化器

技术原理:

- 基于 Muon 优化器改进

- 引入 Newton-Schulz 迭代

- 结合 QK-Clip 机制

- 解决 Logits 爆炸问题

性能数据:

- 在万亿参数规模下稳定训练

- 计算效率是 AdamW 的 2 倍

- Token 效率显著提升

开源状态:已开源

Kimi Linear

技术原理:

- 基于 KDA 架构的混合线性注意力

- 挑战”所有层必须使用全注意力”的惯例

- 优化递归存储管理

性能数据:

- 128K 上下文:解码速度提升 5 倍

- 1M 上下文:解码速度提升 6 倍

- 不同长度场景均保持优异性能

开源状态:已开源

Attention Residuals

技术原理:

- 将固定加法累加替换为 Softmax 注意力

- 每一层选择性聚合前序层信息

- 解决隐藏状态无限制增长问题

性能数据:

- 48B 模型训练效率提升 1.25 倍

- 训练稳定性显著改善

- 深层贡献不再被稀释

开源状态:已开源

真正的开源,不是代码公开,而是推动行业进步。

六、商业影响:Kimi 的下一步

商业化进展

根据杨植麟演讲和多方信源:

收入增长:

- Kimi K2.5 发布后 20 天收入 > 2025 年全年

- 海外收入占比首次超过国内(>50%)

- 海外 API 日均访问量增长 10-20 倍

产品矩阵:

- Kimi 智能助手(C 端)

- Kimi API(B 端)

- Kimi Claw(开发者工具)

- 开源模型 K2.5

生态布局:

- Cursor(全球最大 AI 编程平台)唯一接入的中国模型

- Perplexity(全球最大独立 AI 搜索商)唯一接入的中国模型

- 与 OpenAI、Anthropic、Google 顶尖闭源模型同场竞技

能跟巨头同台竞技,本身就是一种认可。

竞争优势

性价比:

- 性能:达到顶尖闭源模型的 90%

- 价格:只有对方的 1/7

- 结果:海外收入爆发式增长

技术壁垒:

- 三大底层创新(MuonClip、Kimi Linear、Attention Residuals)

- 全部开源,建立生态影响力

- 持续迭代能力

团队优势:

- 杨植麟:AI 圈”天才少年”,27 篇顶会论文

- 核心团队:来自 Google、Facebook、华为等

- 研发文化:追求智能上限,不满足于”够用”

未来规划

根据杨植麟演讲:

技术方向:

- 继续推进底层架构创新

- 探索多模态联合预训练

- 发展智能体集群技术

开源策略:

- 继续开源底层创新技术

- 打造更强大的开源生态

- 推动 AI 技术普惠

商业化:

- 扩大海外市场份额

- 深耕企业级市场

- 探索更多应用场景

技术理想主义 + 商业现实主义,才是可持续的创新模式。

七、行业启示:中国 AI 的突围之路

从”跟随”到”引领”

Kimi 这次突破,给中国 AI 行业带来了什么启示?

启示一:底层创新才有话语权

过去中国 AI 公司多是”应用层创新”,在底层架构上依赖国外技术。Kimi 证明了中国公司也能在底层做出原创贡献。

应用层赚快钱,底层创新赚未来。

启示二:开源是建立影响力的捷径

Kimi 将三大核心技术全部开源,迅速建立了全球影响力。这比花大价钱打广告更有效。

启示三:性价比是突围利器

在性能达到 90% 的前提下,价格只有 1/7,这种性价比优势让 Kimi 在海外快速获客。

中美 AI 竞争新格局

美国优势:

- 原创技术多

- 生态完善

- 资本充足

中国优势:

- 工程能力强

- 迭代速度快

- 性价比优势

Kimi 的启示:

- 在底层技术上追赶

- 在工程实现上超越

- 在性价比上碾压

竞争不是零和游戏,而是共同推动人类进步。

八、风险与挑战

技术风险

1. 技术迭代风险:AI 技术日新月异,今天的领先可能明天就被超越

2. 规模化验证:实验室效果能否在更大规模下复现

3. 开源风险:开源技术可能被竞争对手快速模仿

商业风险

1. 盈利压力:180 亿美元估值意味着高期待,能否持续盈利是关键

2. 海外扩张:地缘政治可能影响海外业务

3. 人才竞争:AI 人才全球紧缺,如何留住核心团队

监管风险

1. AI 监管:各国 AI 法规正在制定,政策变化可能影响业务

2. 数据安全:跨境数据流动面临更严格监管

3. 出口管制:高端 AI 技术可能面临出口限制

风口上的猪也会摔下来,只有长出翅膀的鹰才能飞得更远。

九、结语:AI 架构的”寒武纪大爆发”

Kimi 这次的突破,可能只是一个开始。

当一家公司敢于对 10 年未变的”祖传地基”动刀时,它已经不是在追赶,而是在引领。

当马斯克这样的行业颠覆者都为之点赞时,这项技术的价值已经不言而喻。

当中国公司能在底层架构上做出原创贡献时,中国 AI 的”寒武纪大爆发”或许已经到来。

伟大的创新,从来不是”中国版 XXX”,而是”世界的 XXX”。

杨植麟在演讲最后说:

“Kimi 将继续坚持开源路径,将底层创新贡献给开源社区,打造更强大的模型,推动人工智能技术的普惠。”

这或许就是中国 AI 公司最好的姿态:不卑不亢,用技术说话,用开源共赢。

技术没有国界,但技术创新者有祖国。

对于普通用户来说,我们可能不关心技术细节,只关心产品好不好用。但对于行业来说,Kimi 的突破证明了一件事:

在 AI 这个赛道,中国公司不仅可以跟随,更可以引领。

最好的时代,不是一家独大,而是百花齐放。

互动话题

1. 你用过 Kimi 吗?体验如何? 欢迎在评论区分享你的使用感受。

2. 你觉得 Kimi 的技术突破能超越 OpenAI 吗? 是技术领先还是商业领先?

3. 你最期待 Kimi 开源什么技术? MuonClip、Kimi Linear 还是 Attention Residuals?

4. 你认为中国 AI 能在底层创新上超越美国吗? 需要多久?

5. 如果你是 Kimi 的产品经理,你会优先开发什么功能?

每一个提问者,都是未来的参与者。

参考资料:

1. 月之暗面技术报告《Attention Residuals》(2026 年 3 月 16 日)

2. 杨植麟 GTC 2026 演讲《How We Scaled Kimi K2.5》(2026 年 3 月 18 日)

3. ZAKER:马斯克也来站台,中国团队对 AI 底层架构动手术

4. 网易:杨植麟首次完整披露 Kimi 技术路线图

5. 每日经济新闻:中国大模型 90 后第一人将亮相英伟达 GTC

6. Twitter @elonmusk 对 Kimi 的评论

7. GitHub Kimi 开源项目页面

8. 晚点 LatePost:Kimi 估值 3 个月翻 4 倍背后

(全文约 9200 字)