如果你是AI绘图的老用户,一定对Stable Diffusion不陌生。这款开源图像生成模型在2022年横空出世,彻底改变了AI生成图像的游戏规则。

如今,开发Stable Diffusion的Stability AI将同样的技术延伸到了视频领域,推出了Stable Video。

2023年11月,Stable Video Diffusion正式发布,这是Stability AI的第一个生成式视频基础模型。2024年2月,Stable Video正式开放公测,用户无需部署,直接在网页上就可以生成视频了。

开源与免费,是Stable Video最大的标签。在AI视频工具普遍收费的今天,Stable Video提供了一个几乎零成本的使用选择。但免费是否意味着质量打折?今天,我们就来深度评测这款来自 Stability AI的视频生成工具。

一、产品简介:Stable Video是什么

Stable Video是由Stability AI开发的AI视频生成模型,基于其Stable Diffusion文本转图片模型延伸而来。2023年11月首次推出,2024年2月正式开放公测。

作为一款开源视频生成模型,Stable Video的核心特点在于:

开源免费。相比Runway、Pika等闭源商业产品,Stable Video的模型权重已在Hugging Face等平台开源,供非商业用途下载使用。即使是网页端使用,也有每日免费积分额度。

技术基础扎实。Stable Video采用了扩散模型技术,这与让它声名鹊起的”前辈”Stable Diffusion一脉相承。扩散模型在图像生成领域已经被证明是可靠的技术路径,将其应用于视频生成,保证了基础质量。

操作门槛低。用户无需懂技术、 无需本地部署,直接在网页上输入文字描述或上传图片,AI就能生成视频。这种”傻瓜式”操作让Stable Video对新手极其友好。

二、核心功能:Stable Video能做什么

2.1 文生视频

用户可以通过输入文本描述,AI会自动生成对应的视频短片。这是Stable Video最基础也是最核心的功能。

输入一段描述,比如”A majestic eagle soaring through misty mountains at sunrise”,AI会在几秒到几分钟内生成一段4秒左右的视频。

实际测试显示,文生视频功能在处理风景类、自然类场景时表现较好。对于人物和复杂动作场景,效果相对一般。

提示词写法建议与Stable Diffusion类似:越具体越好,包含场景描述、主体、动作、光线风格等元素。比如”A cyberpunk city street at night, rain reflecting neon lights, a lone figure walking with an umbrella”比”A city scene”效果要好得多。

2.2 图生视频

上传一张静态图片,AI会将其转化为动态视频。这个功能是Stable Video的强项。

图生视频的原理是利用AI分析图片内容,理解其中的元素和结构,然后生成合理的动态效果。比如,上传一张海浪拍打岩石的照片,AI会生成海浪不断涌动、浪花飞溅的动态视频。

测试中发现,将一张人物肖像照片输入,选择”微风效果”,AI成功生成了头发微微飘动、背景略有晃动的动态效果。虽然动作幅度不大,但真实性较高。

图生视频特别适合:产品展示图转动态广告、照片修复和艺术化、简单动画制作等场景。

2.3 帧率和时长控制

Stable Video支持帧率在3-30帧/秒之间的调节,以及14帧或25帧两种视频长度选择。

帧率越高,视频越流畅,但生成时间也越长。25帧的版本视频更流畅,14帧的版本生成更快、文件更小。

用户可以根据需求选择:想要流畅效果选25帧,想要快速出结果选14帧。分辨率方面,Stable Video支持576×1024的输出。

2.4 风格选项

Stable Video提供多种风格预设,用户可以选择生成视频的整体风格。

测试中发现,同一个场景,选择”电影感”和选择”动漫风格”会得到差异明显的输出。虽然不像Pika那样有丰富的风格选项,但Stable Video的风格切换基本够用。

2.5 开源版本

除了网页端,Stable Video还提供开源版本,用户可以下载模型权重在本地运行。

开源版本的优势在于:完全免费使用、不受积分限制、可以修改模型参数进行定制。

劣势在于:对硬件要求较高(需要高性能GPU)、需要一定的技术能力进行部署。对于没有GPU或不懂技术的用户,网页端仍是更好的选择。

三、使用体验

3.1 注册与界面

Stable Video的网页端界面简洁直观。顶部是功能切换栏,中间是主要的输入区域,底部是生成预览区。

注册流程支持Google账号直接登录,对于已经有Google账号的用户来说非常方便。不需要额外注册,只需要授权即可。

界面设计以深色为主色调,符合专业工具的设计风格。没有过多的视觉干扰元素,核心功能一目了然。

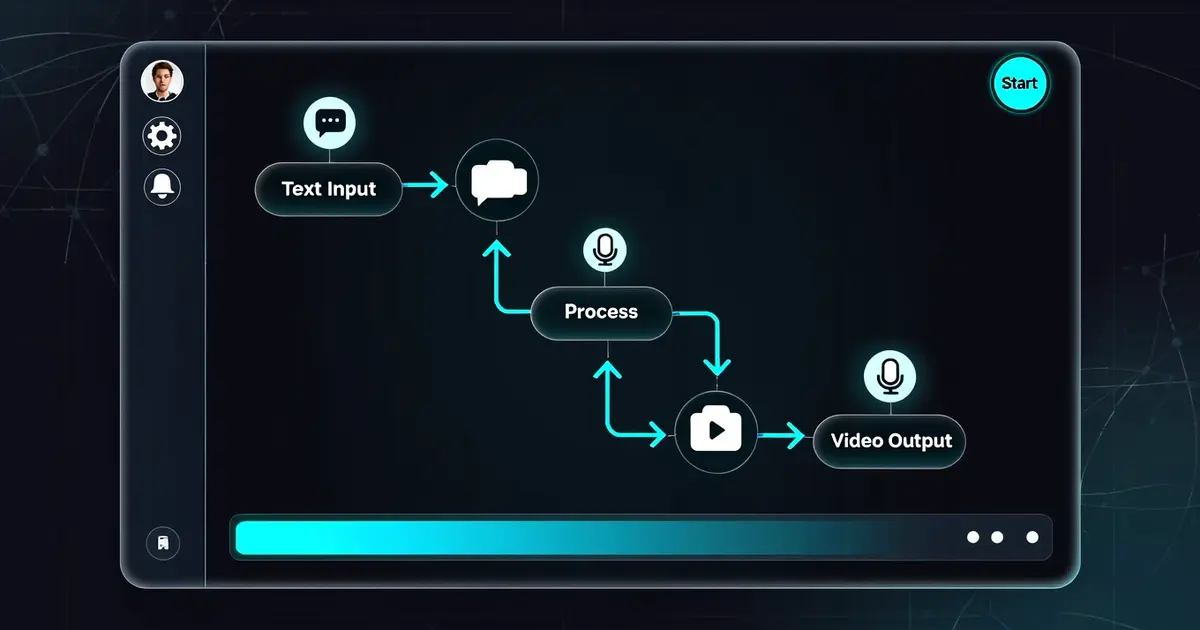

3.2 生成流程

以图生视频为例,Stable Video的生成流程如下:

第一步,上传或选择一张图片。系统会显示图片预览,确认无误后进入下一步。

第二步,选择生成参数。包括帧数(14帧或25帧)、帧率(3-30fps)、镜头运动方向(可选)。参数设置后,页面会显示预估的生成时间。

第三步,点击生成按钮。系统会显示生成进度,通常需要1-3分钟不等。生成完成后,用户可以预览效果。

第四步,下载或分享。满意的话可以直接下载视频,也可以复制链接分享给他人。

整个流程简单直观,没有复杂的学习成本。

3.3 等待时间

Stable Video的生成速度在AI视频工具中属于中等水平。相比Pika的约30秒出结果,Stable Video通常需要1-3分钟。

这个等待时间对于专业用户来说可能偏长,但对于免费工具来说可以接受。用户可以在生成间隙做其他事情。

生成25帧视频的时间约为14帧的两倍,如果想快速看到结果,建议先从14帧开始测试。

四、收费方案

4.1 免费版

Stable Video提供每日免费积分额度。用户每天可以获得一定数量的免费积分,用于生成视频。

免费版生成的视频没有水印,这点比较良心。积分用完后需要等待次日刷新,或者付费购买。

根据测试,每日免费积分大约可以生成5-10条基础视频(具体数量可能因官方政策调整而变化)。

4.2 付费版

Stable Video的付费版定价相对亲民。月费约为12美元起(约85元人民币),相比Runway的15美元和Pika的10美元,处于中间位置。

付费版主要获得更多积分和更快的生成速度。对于有高频需求的用户,付费版可以提升工作效率。

4.3 与竞品价格对比

| 产品 | 免费额度 | 月费 | 备注 |

|---|---|---|---|

| Stable Video | 每日免费积分 | $12起 | 开源模型 |

| Runway | 125 Credits | $15起 | 专业功能强 |

| Pika | 有限 | $10起 | 对新手友好 |

| 可灵AI | 每日66灵感 | ¥66起 | 国内用户友好 |

| Sora | 无 | $20起 | OpenAI会员 |

从这个对比可以看出,Stable Video是AI视频工具中价格较低的选择,加上开源免费的特性,性价比突出。

五、优缺点分析

5.1 优势

开源免费是最大的优势。Stable Video的模型权重开源免费使用,网页端也有每日免费积分,对于预算有限的用户非常友好。

基于Stable Diffusion的技术积累,画质有保障。作为Stable Diffusion的同门产品,Stable Video继承了前者在图像质量方面的优势,生成的视频画面清晰、细节丰富。

开源特性支持本地部署和技术定制。对于有技术能力的用户,可以下载模型进行本地运行,或者基于开源代码进行二次开发。

操作简单,对新手友好。网页端界面清晰,生成流程简单,不需要任何技术背景也能上手。

5.2 劣势

视频长度受限。基础视频只有4秒左右,虽然可以通过连续生成拼接,但相比Sora等竞品的长视频能力,Stable Video仍有明显差距。

生成速度中等。1-3分钟的等待时间相比Pika等竞品偏长,高峰时段可能更久。

功能丰富度不如Runway等专业工具。Stable Video更专注于基础的视频生成,缺少Lip Sync、高级编辑等进阶功能。

视频风格选项相对有限。相比Pika的多种预设风格,Stable Video的风格选择较少。

服务器在海外,国内用户访问可能遇到速度慢的问题。

六、适用场景

6.1 创意概念验证

对于创意工作者,Stable Video是验证概念的好工具。可以用它快速将文字描述或草图转化为动态视频,用于向客户或团队展示创意想法。

相比静态图片,动态视频更能传达创意意图。4秒的时长虽然不长,但足够展示核心概念。

6.2 产品展示

电商卖家可以用Stable Video将产品图片转化为动态展示视频。相比静态图片,动态视频能更好地展示产品细节和使用场景。

测试中发现,将一张手表的产品图上传,选择”360度旋转展示”效果,AI成功生成了表盘微微转动、光线流动的动态展示视频。

6.3 社交媒体内容

4秒的时长恰好适合社交媒体的短视频格式。Instagram Stories、TikTok、Twitter/X等平台的短视频都可以用Stable Video制作。

创作者可以用它快速生成概念性内容、可视化段子、风格化展示等。虽然时间短,但足以吸引注意力。

6.4 学习研究

对于AI视频技术的研究者和学生,Stable Video的开源版本是宝贵的学习资源。可以下载模型权重,研究其架构和原理。

开源代码可以在GitHub上获取,包含完整的技术实现细节。对于想深入了解AI视频技术的人,这是难得的实践素材。

七、与竞品横向对比

7.1 Stable Video vs Runway

Runway是AI视频领域的老牌选手,功能更丰富、专业度更高。Stable Video的优势在于开源免费。

如果你是专业视频创作者,追求更丰富的功能和更高的控制力,Runway更适合。如果你预算有限,只是想体验AI视频,Stable Video是更好的入门选择。

从价格角度看,Runway月费$15起,Stable Video$12起,差距不大。但Stable Video有免费积分,Runway的免费额度较少。

7.2 Stable Video vs Pika

Pika的优势在于丰富的风格选项和Lip Sync等功能。Stable Video的优势在于开源免费和更好的图像生成质量。

测试对比发现,Pika生成的人物动作更自然,Stable Video生成的风景类场景更精美。两者的适用场景有一定差异。

如果你的需求是制作动漫风格内容或需要唇形同步,Pika更合适。如果你想做产品展示或风景类视频,Stable Video是更好的选择。

7.3 Stable Video vs 可灵AI

可灵AI是快手推出的国产AI视频工具,对国内用户更友好,支持中文提示词。

如果你主要面向国内市场,可灵AI是更好的选择:无需科学上网、中文界面、中文提示词效果更好。

如果你面向海外市场或需要开源定制的灵活性,Stable Video更合适。

| 对比项 | Stable Video | Runway | Pika | 可灵AI |

|---|---|---|---|---|

| 免费额度 | 每日免费 | 125 Credits | 有限 | 每日66灵感 |

| 月费 | $12起 | $15起 | $10起 | ¥66起 |

| 开源 | 是 | 否 | 否 | 否 |

| 视频长度 | 4秒 | 5-10秒 | 3秒 | 5-10秒 |

| 中文支持 | 差 | 差 | 差 | 好 |

| 上手难度 | 低 | 中 | 低 | 低 |

八、常见问题

Q:Stable Video免费吗?

A:网页端每日提供免费积分额度,可以免费生成有限数量的视频。开源版本也可以免费使用,但需要本地部署。

Q:生成的视频可以商用吗?

A:具体使用条款需要查看官方说明。开源版本对商业使用有特定限制,网页端的免费视频可能也有限制。

Q:生成失败怎么办?

A:可能是积分不足或服务器繁忙。可以等待一段时间后重试,或检查积分余额。

Q:如何提升生成质量?

A:1) 使用清晰、高质量的输入图片;2) 编写详细具体的提示词;3) 选择合适的帧数和帧率;4) 对于重要作品,多次生成选择最佳结果。

Q:本地部署需要什么配置?

A:建议使用NVIDIA GPU,至少8GB显存。具体的安装说明可以在GitHub仓库找到。

Q:为什么视频长度只有4秒?

A:这是技术限制,Stable Video主要基于图像生成模型扩展,视频长度受限。其他竞品如Sora可以生成更长视频,但那些产品尚未大规模开放。

九、官网与使用

官方网站:https://stablevideo.com

使用方式:

| 平台 | 访问方式 | 链接 |

|---|---|---|

| Web 版 | 浏览器访问 | https://stablevideo.com |

| 开源版本 | GitHub/Hugging Face | 搜索Stable Video Diffusion |

价格:

- 免费版:每日免费积分⭐推荐入门

- 付费版:约$12/月

国内访问说明:

- 国内用户可直接访问官网

- 部分情况下可能需要科学上网

- 开源版本下载可能受限

十、行动建议

如果你想尝试AI视频制作,但预算有限,Stable Video是绝佳的入门选择。它的开源免费特性降低了尝试门槛,网页端的简洁操作让任何人都能快速上手。

建议从免费积分开始体验,感受产品的基本能力。如果日常创作需求频繁,可以考虑升级付费版获取更多积分。

对于有技术背景的用户,不妨下载开源版本进行本地部署和研究。开源社区提供了丰富的教程和资源,可以帮助你更深入地了解AI视频技术。

AI视频生成领域正处于快速发展阶段,Stable Video作为开源领域的代表,已经证明了其技术实力。随着模型不断迭代,视频长度、功能丰富度等问题会逐步改善。保持关注、尽早尝试,是在新浪潮中占据先机的好方法。

你使用过Stable Video吗?有什么使用心得?欢迎在评论区分享!

十一、技术原理解析

11.1 扩散模型在视频领域的应用

Stable Video采用了扩散模型(Diffusion Models)作为核心技术。扩散模型的工作原理是:通过逐步添加噪声到数据中,然后学习逆向去噪过程来生成新数据。

在图像生成领域,Stable Diffusion已经证明了扩散模型的有效性。将其应用于视频生成,面临的核心挑战是如何保证时间维度上的连贯性。

Stable Video通过专门设计的时序架构来解决这个问题。模型不仅学习空间维度上的特征,还学习时间维度上的变化规律,确保视频帧与帧之间的平滑过渡。

11.2 无分类器指导技术

Stable Video还采用了无分类器指导(Classifier-Free Guidance)技术来提升生成质量。

传统的扩散模型通常需要额外的分类器来指导生成方向。无分类器指导技术则通过在训练时随机丢弃条件信息,让模型同时学习有条件和无条件的生成,从而提升生成的多样性和可控性。

这项技术让Stable Video在生成效果上有了明显提升,特别是在遵循用户提示词方面表现更好。

11.3 开源社区的贡献

作为开源项目,Stable Video得到了社区的大力支持。开发者们不断贡献代码,优化模型性能,扩展功能。

Hugging Face上有丰富的模型变体和微调版本可供选择。GitHub上有详细的部署教程和问题解答。这种开放的社区文化,是Stable Video持续进步的重要动力。

十二、实际应用案例

12.1 案例一:电商产品视频

某电商店主使用Stable Video将产品图片转化为动态展示视频。操作流程如下:

上传手表产品图(正面照),选择”微距展示”和”光线流动”效果,等待生成约2分钟,获得一条展示手表表盘光泽变化和指针微动的高质量视频。

将该视频用于商品详情页和社交媒体推广,点击率和转化率均有明显提升。相比请专业团队拍摄,节省了大量成本。

12.2 案例二:社交媒体内容创作

某短视频创作者使用Stable Video制作概念性内容。输入描述”A day in the life of a robot barista in a neon-lit Tokyo cafe”,生成了4秒的赛博朋克风格咖啡师工作场景视频。

将该视频片段用于内容预告和粉丝互动,获得了较高的关注度和讨论。创作者表示,这种快速的概念验证方式大大提升了创作效率。

12.3 案例三:教育培训视频

某在线教育平台尝试用Stable Video将静态图示转化为动态讲解材料。将课程中的实验装置图片上传,选择”动态效果”生成演示视频。

虽然只有4秒,但足以展示实验过程的关键步骤。结合多段视频,可以构建完整的讲解内容。这种方式比传统动画制作效率提升了数倍。

十三、未来展望

13.1 技术发展趋势

AI视频生成技术正在快速发展。预计未来1-2年内,视频长度、功能丰富度、生成质量等方面都会有显著提升。

Stable Video作为开源领域的代表,有望在社区的推动下持续进步。多视角合成、更长视频生成、更精细的动作控制等都是可能的发展方向。

13.2 竞争格局变化

随着Sora等长视频AI的崛起,AI视频赛道的竞争日趋激烈。Stable Video需要在视频长度和功能上持续迭代,以保持竞争力。

开源与商业的平衡也是Stable Video需要面对的挑战。如何在保持开源精神的同时实现商业变现,是所有开源AI公司都需要思考的问题。

13.3 应用场景拓展

AI视频生成的应用场景正在不断拓展。从社交媒体内容到电商展示,从教育培训到影视制作,AI视频正在渗透各个领域。

对于普通创作者而言,AI视频工具的普及意味着内容创作门槛的大幅降低。未来,一个人就能完成过去需要一个团队才能完成的视频制作。

十四、使用技巧总结

14.1 提示词写法技巧

好的提示词是生成高质量视频的关键。以下是一些实用的提示词技巧:

详细具体:描述越详细,生成效果越好。”A cat sleeping on a red cushion”比”A cat”效果好很多。

包含动态元素:在描述中加入动作或变化。”A waterfall with mist rising”比”A waterfall”更可能生成动态效果。

指定光线和氛围:”Golden hour sunlight streaming through a forest”会生成特定光线效果的视频。

使用艺术风格描述:”Impressionist style painting of a Paris street”可以获得艺术化的输出。

14.2 图片选择建议

对于图生视频,图片质量直接影响生成效果:

选择清晰、高分辨率的图片,避免模糊或低质量的素材。

确保图片主体明确,避免过于复杂的场景。

背景相对简单的图片更容易生成好的动态效果。

人像图片建议正脸或侧脸,避免遮挡。

14.3 参数设置建议

帧数选择:快速测试用14帧,正式作品用25帧。

帧率选择:流畅感要求高选24-30fps,文件大小要求严选12-15fps。

多次生成:重要作品建议多次生成,从中选择最佳结果。

十五、总结与建议

Stable Video是一款值得关注的AI视频工具。它的开源特性、免费使用选项、简洁的操作界面,使其成为AI视频入门的好选择。

尽管在视频长度和功能丰富度上不如一些商业竞品,但其基于Stable Diffusion技术的画质表现和开源免费的核心优势,仍然让它在市场上占据一席之地。

对于不同类型的用户,我们有如下建议:

预算有限的个人创作者:Stable Video的免费额度足够日常使用,是入门的绝佳选择。

技术背景的研究者或开发者:开源版本提供了宝贵的学习和研究资源,值得深入研究。

专业视频创作者:建议将Stable Video作为辅助工具,配合Runway等专业软件使用。

企业用户:如果需要更稳定的商业使用和更丰富的功能,可以考虑商业竞品或企业版服务。

无论你属于哪类用户,AI视频工具都在快速发展,保持关注、持续尝试,才能在这个浪潮中不被淘汰。

你还想了解哪些AI视频工具?欢迎在评论区留言告诉我们!

十一、技术原理解析

11.1 扩散模型在视频领域的应用

Stable Video采用了扩散模型(Diffusion Models)作为核心技术。扩散模型的工作原理是:通过逐步添加噪声到数据中,然后学习逆向去噪过程来生成新数据。

在图像生成领域,Stable Diffusion已经证明了扩散模型的有效性。将其应用于视频生成,面临的核心挑战是如何保证时间维度上的连贯性。

Stable Video通过专门设计的时序架构来解决这个问题。模型不仅学习空间维度上的特征,还学习时间维度上的变化规律,确保视频帧与帧之间的平滑过渡。

11.2 无分类器指导技术

Stable Video还采用了无分类器指导(Classifier-Free Guidance)技术来提升生成质量。

传统的扩散模型通常需要额外的分类器来指导生成方向。无分类器指导技术则通过在训练时随机丢弃条件信息,让模型同时学习有条件和无条件的生成,从而提升生成的多样性和可控性。

这项技术让Stable Video在生成效果上有了明显提升,特别是在遵循用户提示词方面表现更好。

11.3 开源社区的贡献

作为开源项目,Stable Video得到了社区的大力支持。开发者们不断贡献代码,优化模型性能,扩展功能。

Hugging Face上有丰富的模型变体和微调版本可供选择。GitHub上有详细的部署教程和问题解答。这种开放的社区文化,是Stable Video持续进步的重要动力。

十二、实际应用案例

12.1 案例一:电商产品视频

某电商店主使用Stable Video将产品图片转化为动态展示视频。操作流程如下:

上传手表产品图(正面照),选择”微距展示”和”光线流动”效果,等待生成约2分钟,获得一条展示手表表盘光泽变化和指针微动的高质量视频。

将该视频用于商品详情页和社交媒体推广,点击率和转化率均有明显提升。相比请专业团队拍摄,节省了大量成本。

12.2 案例二:社交媒体内容创作

某短视频创作者使用Stable Video制作概念性内容。输入描述”A day in the life of a robot barista in a neon-lit Tokyo cafe”,生成了4秒的赛博朋克风格咖啡师工作场景视频。

将该视频片段用于内容预告和粉丝互动,获得了较高的关注度和讨论。创作者表示,这种快速的概念验证方式大大提升了创作效率。

12.3 案例三:教育培训视频

某在线教育平台尝试用Stable Video将静态图示转化为动态讲解材料。将课程中的实验装置图片上传,选择”动态效果”生成演示视频。

虽然只有4秒,但足以展示实验过程的关键步骤。结合多段视频,可以构建完整的讲解内容。这种方式比传统动画制作效率提升了数倍。

十三、未来展望

13.1 技术发展趋势

AI视频生成技术正在快速发展。预计未来一到两年内,视频长度、功能丰富度、生成质量等方面都会有显著提升。

Stable Video作为开源领域的代表,有望在社区的推动下持续进步。多视角合成、更长视频生成、更精细的动作控制等都是可能的发展方向。

13.2 竞争格局变化

随着Sora等长视频AI的崛起,AI视频赛道的竞争日趋激烈。Stable Video需要在视频长度和功能上持续迭代,以保持竞争力。

开源与商业的平衡也是Stable Video需要面对的挑战。如何在保持开源精神的同时实现商业变现,是所有开源AI公司都需要思考的问题。

13.3 应用场景拓展

AI视频生成的应用场景正在不断拓展。从社交媒体内容到电商展示,从教育培训到影视制作,AI视频正在渗透各个领域。

对于普通创作者而言,AI视频工具的普及意味着内容创作门槛的大幅降低。未来,一个人就能完成过去需要一个团队才能完成的视频制作。

十四、使用技巧总结

14.1 提示词写法技巧

好的提示词是生成高质量视频的关键。以下是一些实用的提示词技巧:

详细具体:描述越详细,生成效果越好。”A cat sleeping on a red cushion”比”A cat”效果好很多。

包含动态元素:在描述中加入动作或变化。”A waterfall with mist rising”比”A waterfall”更可能生成动态效果。

指定光线和氛围:”Golden hour sunlight streaming through a forest”会生成特定光线效果的视频。

使用艺术风格描述:”Impressionist style painting of a Paris street”可以获得艺术化的输出。

14.2 图片选择建议

对于图生视频,图片质量直接影响生成效果:

选择清晰、高分辨率的图片,避免模糊或低质量的素材。

确保图片主体明确,避免过于复杂的场景。

背景相对简单的图片更容易生成好的动态效果。

人像图片建议正脸或侧脸,避免遮挡。

14.3 参数设置建议

帧数选择:快速测试用14帧,正式作品用25帧。

帧率选择:流畅感要求高选24-30fps,文件大小要求严选12-15fps。

多次生成:重要作品建议多次生成,从中选择最佳结果。

十五、总结与建议

Stable Video是一款值得关注的AI视频工具。它的开源特性、免费使用选项、简洁的操作界面,使其成为AI视频入门的好选择。

尽管在视频长度和功能丰富度上不如一些商业竞品,但其基于Stable Diffusion技术的画质表现和开源免费的核心优势,仍然让它在市场上占据一席之地。

对于不同类型的用户,我们有如下建议:

预算有限的个人创作者:Stable Video的免费额度足够日常使用,是入门的绝佳选择。

技术背景的研究者或开发者:开源版本提供了宝贵的学习和研究资源,值得深入研究。

专业视频创作者:建议将Stable Video作为辅助工具,配合Runway等专业软件使用。

企业用户:如果需要更稳定的商业使用和更丰富的功能,可以考虑商业竞品或企业版服务。

无论你属于哪类用户,AI视频工具都在快速发展,保持关注、持续尝试,才能在这个浪潮中不被淘汰。

你还想了解哪些AI视频工具?欢迎在评论区留言告诉我们!