做AI应用开发的人都知道,大模型的推理成本是个无底洞。

Token价格每年在降,但企业的AI用量却指数级增长。结果呢?总账单不仅没降,反而在飙涨。这就是经济学里的”杰文斯悖论”——效率越高、消费越多。

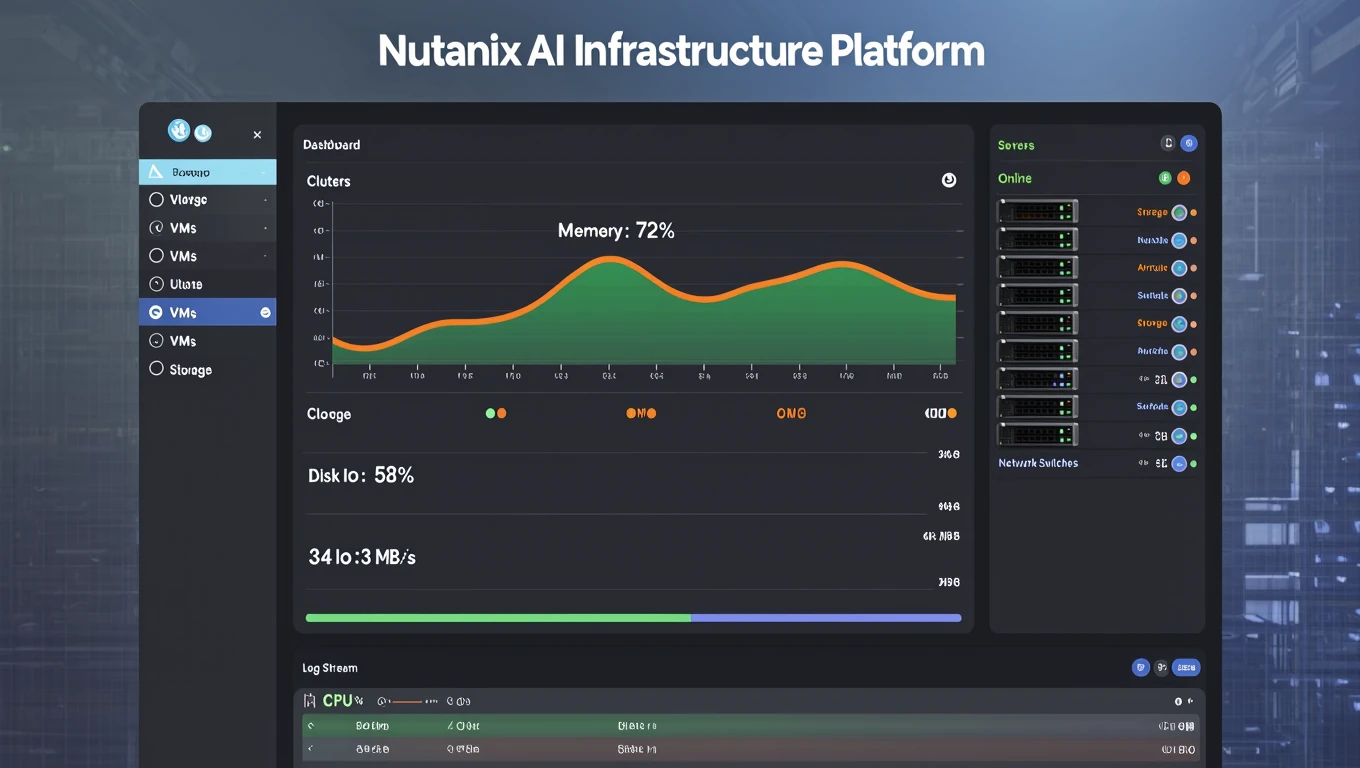

Nutanix看到了这个痛点,推出了一整套叫”Agentic AI”的企业级解决方案。它的核心定位很清晰:不做大模型、不做AI应用,而是做AI时代的基础设施——帮助企业更低成本、更高效率地跑AI推理 workloads。

今天就来扒一扒Nutanix Agentic AI到底在解决什么问题,以及它的技术实现值不值得企业掏钱。

一、为什么企业AI基础设施变得这么重要?

2024年之前,大多数企业的AI项目还停留在”概念验证”阶段。做个聊天机器人、跑跑数据分析demo、向领导演示一下AI有多厉害——这些场景对基础设施的要求不高,现有的IT架构勉强能撑住。

但2025年开始,AI进入大规模生产部署阶段。特征有三个:

第一个,AI Agent数量爆发。一个企业不再只跑一个大模型,而是同时跑几十上百个AI Agent。每个Agent可能调用不同的模型、处理不同的任务。这意味着同时存在的推理请求数量成倍增长。

第二个,推理成为主要成本。以前是训练贵、推理便宜。但在大规模部署AI Agent之后,推理的累计成本已经远超训练。一家大型银行的数据显示,他们每年在AI推理上的开销已经超过模型训练成本的50倍。

第三个,短时高并发成常态。传统企业IT规划是基于可预测的周期性负载。但AI Agent的工作模式完全不同——它可能突然被触发、产生大量请求、然后又沉寂。这种不可预测的短时高并发,让传统基础设施措手不及。

Nutanix认为,企业需要一个专门为AI时代设计的基础设施架构,而不是把AI强塞进传统IT架构里。

二、Agentic AI解决方案的核心架构

Nutanix Agentic AI不是一个单一产品,而是一套完整的软件栈,涵盖从底层硬件虚拟化到上层AI应用开发的全链路。

1. AI Gateway:统一入口做智能路由

企业在生产环境里通常不会只用一个AI模型。有的任务用Claude效果好、有的时候需要GPT、有的时候本地开源模型更划算。传统的做法是每个应用直接调用特定模型,优点是简单,缺点是乱——无法统一管理流量、没有统一的认证和计费、无法做模型切换的容灾。

Nutanix的AI Gateway就是来解决这个问题的。它提供了一个统一的推理入口,所有AI请求都经过这个网关。网关可以:

根据请求类型自动路由到最合适的模型。比如简单的FAQ路由到便宜的本地模型,复杂的分析任务路由到云端大模型。开发者写一次代码,就能自动获得最优的模型路由。

统一管理API Key和认证。企业不需要在每个应用里单独配置各种模型的凭证,所有凭证集中在Gateway里管理。

实时监控Token消耗和成本。可以看到每个部门、每个应用、每个模型的Token使用量和成本。

实现Model Context Protocol(MCP)。这是让AI Agent安全连接企业数据源的标准协议,Nutanix的Gateway原生支持MCP。

2. Enterprise AI:企业级模型部署

Nutanix Enterprise AI提供了私有化部署大模型的能力。企业可以选择部署开源模型(如Nemotron),或者连接云端模型(Anthropic、Google、OpenAI等)。

核心卖点是”一键部署”。传统上,把一个大模型跑起来需要专业DevOps团队折腾几周——配GPU、安装驱动、跑推理服务、配置网络。Nutanix把这些步骤全部封装好,企业点击几下就能获得一个生产级的模型推理服务。

支持的部署形态包括:

私有LLM部署:在企业自己数据中心跑开源模型,数据不出内网,适合对数据安全要求极高的金融、医疗、政府场景。

云端LLM连接:统一接入OpenAI、Anthropic、Google等云端模型,但通过Nutanix的Gateway统一管理流量和安全。

混合模式:敏感数据处理走私有模型,复杂推理走云端模型,Nutanix自动判断路由。

3. Kubernetes Platform:AI应用的容器编排

跑AI Agent需要容器编排平台。Nutanix Kubernetes Platform(NKP)提供了专门为AI workload优化的K8s发行版。

它自带一个AI服务目录,预置了主流的AI工具:Jupyter Notebook、向量化数据库、MLOps工具链。企业不需要从零搭环境,直接从目录里点选就能部署完整的AI开发平台。

关键特性是”即时扩展”。AI推理的负载波动大,有时候0并发,有时候突发百万请求。NKP可以根据负载自动扩缩容,在有请求时快速拉起足够实例,没有请求时收缩到最小配置节省成本。

4. 拓扑感知GPU调度

这是Nutanix的技术亮点之一。传统虚拟化环境下,GPU资源是静态分配的——一台虚拟机分到两个GPU,就一直占用这两个GPU,不管实际用不用。

Nutanix AHVhypervisor实现了拓扑感知的GPU调度。它能自动追踪GPU、CPU、内存、DPU之间的物理拓扑关系,在调度任务时选择最优的硬件位置。

举例来说,一个需要跨GPU通信的分布式训练任务,传统调度可能把两个GPU实例调度到相距很远的物理服务器上,导致通信延迟很高。而拓扑感知调度会优先把这两个实例放在通信路径最短的位置上。

结果是GPU利用率提升、延迟降低、整体性能更稳定。

三、Token成本优化:怎么做到的?

企业最关心的问题:用了Nutanix Agentic AI,Token成本能降多少?

官方没有给出一个统一的数字——这很正常,因为成本优化效果取决于很多因素:企业原有的架构效率、跑的模型类型、任务的复杂度分布。Nutanix能说的是”优化方向”,不是”具体数字”。

具体成本优化手段包括:

智能路由节省。让简单任务跑在便宜的小模型上,只有复杂任务才调用贵的大模型。这个路由逻辑做得好,可以省下30%-50%的云端模型调用费用。

GPU利用率提升。传统架构下GPU利用率通常只有30%-40%,大量时间在等待数据或者空闲。Nutanix的拓扑感知调度和存储优化可以让GPU利用率提升到60%以上。GPU是按占用时间计费的,利用率翻倍等于成本减半。

推理批量处理。对于非实时任务,可以走批量推理队列,享受更低的单价。传统架构下没有批量处理的机制,每个请求都单独处理。Nutanix的队列系统可以把多个同类请求打包处理。

缓存复用。如果两个请求的内容高度相似,Nutanix可以复用之前的推理结果,不需要重复计算。这对FAQ类场景特别有效。

四、和传统云计算方案对比

很多企业跑AI第一反应是上云——AWS、Azure、Google Cloud,都有AI推理服务。为什么要用Nutanix?

核心差异在于”控制权”。云端方案是厂商帮你管理一切,优点是省心,缺点是不透明、长期成本不可控。

成本对比。以一个中型银行真实案例(数据来自Nutanix公开案例)为参考:他们原来每年在云端AI推理上花费约800万美元,切到Nutanix私有部署后,加上硬件折旧和运维成本,总TCO降低了55%。

数据安全对比。云端方案要求数据离开企业网络,存在合规风险。金融、医疗、政府客户往往有严格的数据本地化要求,私有部署是唯一选择。

性能对比。云端推理有网络延迟,尤其对实时性要求高的场景(高频交易、实时风控)影响明显。私有部署在本地网络,延迟可以低至毫秒级。

当然不是说云端不好。对于中小企业、没有专业运维团队的企业、或者AI需求波动大的场景(某个季度突然需要大量推理然后又回落),云端弹性优势更明显。Nutanix的定位是”已经决定认真做AI的企业”,而不是”试试看AI能干什么”的企业。

五、安全和合规

企业级AI基础设施绕不开安全和合规。Nutanix在这块有几个值得注意的能力:

零信任网络。Nutanix Flow结合DPU(数据处理单元)实现了硬件级的零信任网络。每个虚拟机、每个容器、每个工作负载在网络上互相隔离,任何通信都需要显式授权。这防止了横向渗透——即使一个容器被攻破,攻击者也无法利用它访问其他系统。

气隙环境支持。对于最高安全等级要求的场景,Nutanix支持完全断开互联网的部署方式。所有软件更新、驱动升级都在内网完成,不需要连接外部服务器。这对国防、政府、关键基础设施行业至关重要。

合规认证。Nutanix企业云平台本身通过了主流的安全认证,包括SOC 2、ISO 27001等。AI模块运行在这个认证过的基础设施上,整体合规性有保证。

六、谁应该考虑Nutanix Agentic AI?

说了这么多,Nutanix Agentic AI不是万能药。它最适合的场景是:

第一,已经跑多个AI Agent的企业。如果企业里只有一两个AI应用在跑,自己维护一套完整基础设施成本太高,不如继续用云端。但如果有5个以上AI Agent同时运行,私有部署的规模效应就开始显现。

第二,对数据安全有强监管要求的行业。金融、医疗、政府、制造业的敏感数据不能上云,但又需要AI能力。Nutanix提供了这类企业的最优解。

第三,有专业IT运维团队的企业。Nutanix降低了运维复杂度,但不是说完全不需要人。企业需要有K8s经验的工程师来最大化发挥这套平台的能力。

第四,AI用量大且稳定的企业。如果AI请求量每天都很高,说明企业已经把AI融入业务流程,而不是”有空试试”。高且稳定的用量让私有部署的投资回报周期变得更短。

七、总结

AI竞争的下半场,基础设施变得越来越重要。当所有企业都在用同样的大模型、跑同样的AI Agent时,差异在哪里?在谁能更低成本、更高效、更安全地把AI跑起来。

Nutanix Agentic AI的思路很清晰:不做AI应用、不训练模型,而是做AI时代的水电煤。它的价值在于让企业把精力放在AI本身,而不是被基础设施的复杂性消耗。

当然,这套方案也有门槛——需要专业的运维团队、需要一定的IT基础设施规模、不适合AI需求还不确定的早期探索阶段。

如果你所在的企业已经在认真做AI生产部署,Nutanix Agentic AI值得认真评估。它不一定是最便宜的,但可能是这个阶段最完整的企业级选择。

官网: https://www.nutanix.com/solutions/ai

定位: 企业级AI基础设施/AI工厂操作系统

核心技术: AI Gateway、智能路由、拓扑感知GPU调度、Kubernetes容器编排

集成生态: NVIDIA GPU、DPU、Cisco/Dell/Supermicro硬件

目标客户: 中大型企业、多AI Agent部署场景、强监管行业

你觉得企业AI基础设施这块,谁会最终胜出?云端还是私有部署?欢迎在评论区聊聊。