DeepSeek-V4教程:3个真实场景带你玩转百万Token超长上下文

【AI智习室 4月25日】 4月24日,DeepSeek正式发布V4版本,最大的亮点只有一个:100万Token的超长上下文窗口。这个数字意味着什么?意味着你可以一次性把一整部《资本论》、一整套《中华人民共和国法律法规》、一份300页的财务报告全部丢给AI,让它帮你分析、总结、对比。

这不是科幻,这是今天就可以用上的能力。本文用3个真实场景,手把手教你用好DeepSeek-V4的超长上下文能力。

导语

在说具体用法之前,先回答一个很多人关心的问题:DeepSeek-V4和之前的V3比,到底强在哪里?

根据DeepSeek官方技术报告,V4有三大核心升级:

- 上下文长度:从V3的约12万Token跃升至100万Token,提升近8倍

- Agent能力:Agentic Coding评测中超越Sonnet 4.5,接近Opus 4.6非思考模式

- 技术架构:全新的注意力机制,在Token维度进行压缩,大幅降低计算和显存需求

简单来说,V4不仅仅是”更长”,而是”更聪明、更快、更省资源”。

目前V4分为两个版本:V4-Pro(高性能版)和V4-Flash(快速版)。两者都支持100万上下文,区别在于参数规模和适用场景。

场景一:30万字论文,AI帮我秒读

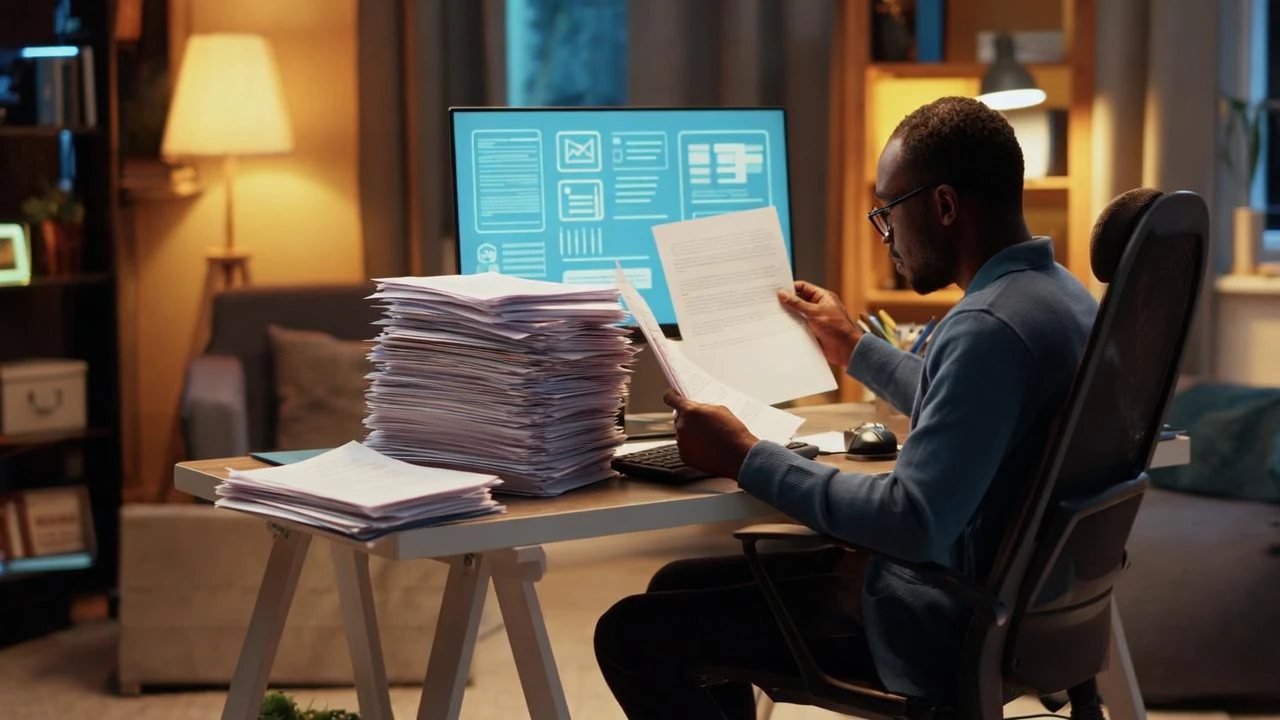

这是超长上下文最直观的价值——你可以把一整本书、一整套档案、一份超长研究报告一次性丢给AI。

传统方式的痛点

以前处理长文档的方式是什么?分段喂读。每次AI只能看一小部分,上一段讲了什么、下一段什么关系,AI不知道,你得自己来回切换、人工拼接。而且很多时候长文档的关键信息分散在各处,分段阅读根本无法发现跨章节的关联。

100万Token上下文改变了这一点。以中文计算,100万Token大约相当于150万-200万汉字,足够容纳一整部《资本论》、过去5年中国A股所有上市公司年报、一整套《中华人民共和国法律法规》、一份300页的技术方案文档。

实战操作步骤

第一步:准备文档。将PDF、Word或者网页内容复制为纯文本。DeepSeek支持直接粘贴,也可以上传文件。如果是PDF,建议先转换为文本格式。

第二步:输入Prompt。把完整文档粘贴进去,然后给AI一个清晰的任务指令。

示范Prompt:“请仔细阅读以下论文全文,然后回答:1. 本文的核心论点是什么?2. 作者用了哪些证据来支撑论点?3. 论文的局限性在哪里?4. 这篇论文对你的研究有什么启发?请结合文中具体内容回答,不要泛泛而谈。”

第三步:获取分析结果。DeepSeek-V4会在你的完整文档上下文基础上回答,确保答案的准确性和连贯性。

高阶用法:跨文档对比分析

超长上下文的真正威力在于跨文档分析。比如你想对比三份不同咨询机构对2025年AI行业的研究报告,不需要来回切换,直接把三份报告同时丢给DeepSeek-V4,让它帮你对比异同。

示范Prompt:“以下包含三份不同机构对2025年AI行业的研究报告,请你从以下维度进行对比:1. 各自的核心预测有哪些异同?2. 对AI落地节奏的判断有何差异?3. 投资机会的判断有何分歧?请用表格呈现对比结果。”

【金句】 超长上下文不是让你一次读更多文字,而是让AI能够真正”理解”完整上下文。分段喂读是盲人摸象,100万Token上下文让AI看见全貌。

场景二:代码项目级理解,AI变成你的”高级工程师”

对于程序员来说,DeepSeek-V4的Agentic Coding能力是本次更新最值得关注的部分。官方数据显示,V4-Pro在Agentic Coding评测中已达到当前开源模型最高水平,使用体验优于Sonnet 4.5,交付质量接近Opus 4.6非思考模式。

而且DeepSeek-V4专门针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流Agent产品进行了适配和优化。

代码项目级理解

传统AI编程助手的问题在于:它只能看到你当前打开的文件。如果你想让AI理解一个完整项目——几百个文件、复杂的依赖关系、跨模块调用——它做不到。

DeepSeek-V4的100万Token上下文,理论上可以一次性”消化”一个中小型项目的全部代码。

示范场景:接手别人的烂尾项目。假设你刚接手一个没有文档、代码混乱的旧项目,5万行代码散落在200个文件里。传统方式需要花两周时间通读代码。

示范Prompt:“以下是一个Python项目的核心代码文件(包含main.py、models.py、views.py、utils.py)。请分析:1. 项目的整体架构是怎样的?2. 数据从请求到存储的完整流程是什么?3. 哪些地方存在明显的安全隐患或性能问题?请结合具体代码回答。”

AI写代码的能力边界

V4-Pro擅长的任务:快速生成标准CRUD代码、代码片段优化和重构、Bug定位和小修小改、根据注释生成完整函数、解释陌生代码的逻辑。

V4-Pro吃力任务:从零设计一个大型分布式系统、涉及复杂并发和事务一致性的架构决策、需要深度业务理解的定制开发。

【金句】 DeepSeek-V4是程序员的”超级实习生”——能帮你处理大量重复性工作,但在真正的系统设计上,你仍需要做最后的判断。

场景三:个人知识库,让AI帮你”第二大脑”

第三个场景可能是对普通人最有价值的应用:构建个人知识库。你有没有过这样的经历——明明在某本书里、某篇笔记中看到过一个重要观点,但就是想不起来在哪了。传统搜索只能搜关键词,但知识的组织不是按关键词来的。

DeepSeek-V4的100万Token上下文,让你可以把大量分散的知识整合在一起,让AI帮你跨文档检索和发现。

搭建个人知识库

第一步:整理你的知识资产。把你过去几年积累的读书笔记、学习卡片、项目复盘,会议纪要,行业研究报告全部整理成纯文本格式。这个过程虽然耗时,但只需要做一次。

第二步:批量喂给DeepSeek-V4。按主题分批输入。比如把所有产品经理相关的笔记打包,问AI:”我过去三年记了很多产品相关的笔记,请帮我梳理出一个产品方法论的知识体系,并指出我目前还缺哪些重要知识模块。”

第三步:持续对话探索。知识库的价值在于可以不断探索。问AI:”在这个知识体系里,哪些观点是相互矛盾的?哪些和当下市场趋势最相关?”这种跨文档的知识发现,是传统搜索无法做到的。

企业级应用场景

法务场景:把公司法务部门的全部判例、法律意见书、合同模板全部输入,AI可以在100万Token上下文内进行跨文档分析,快速判断某份合同是否存在法律风险。

财务场景:把过去5年所有审计报告、年报、内部控制文档导入,AI可以快速发现财务数据之间的异常关联。

研发场景:把一个技术团队积累的所有技术文档、API文档、故障复盘记录导入,新成员可以快速了解团队的技术积累和架构演进历史。

DeepSeek-V4 API调用教程

如果你是开发者,想通过API集成DeepSeek-V4的能力,以下是完整的接入指南。

方式一:百度千帆(国内最推荐)

百度千帆已上线DeepSeek-V4,提供V4-Pro和V4-Flash两个版本。国内访问速度快,无需科学上网。

Python调用示例:

API_KEY = “your_qianfan_api_key”

MODEL = “deepseek-v4-pro” # 或 deepseek-v4-flash

response = requests.post(

“https://qianfan.baidubce.com/v2/app/conversation/infer”,

headers={

“Authorization”: f”Bearer {API_KEY}”,

“Content-Type”: “application/json”

},

json={

“app_id”: “your_app_id”,

“query”: “你的问题…”,

“stream”: False

}

)

print(response.json())

方式二:硅基流动(性价比高)

硅基流动平台也接入了DeepSeek-V4,定价相对较低,适合个人开发者和中小企业。

Python调用示例:

API_KEY = “your_siliconflow_key”

response = requests.post(

“https://api.siliconflow.cn/v1/chat/completions”,

headers={

“Authorization”: f”Bearer {API_KEY}”,

“Content-Type”: “application/json”

},

json={

“model”: “deepseek-ai/DeepSeek-V4-Pro”,

“messages”: [

{“role”: “user”, “content”: “你的问题…”}

],

“max_tokens”: 4096,

“stream”: False

}

)

print(response.json())

方式三:OpenRouter(海外通用)

如果需要海外节点访问,可以选择OpenRouter平台。

Python调用示例:

client = OpenAI(

api_key=”your_openrouter_key”,

base_url=”https://openrouter.ai/api/v1″

)

response = client.chat.completions.create(

model=”deepseek-ai/deepseek-v4-pro”,

messages=[

{“role”: “user”, “content”: “你的问题…”}

]

)

print(response.choices[0].message.content)

V4-Pro还是V4-Flash?选择指南

两个版本怎么选,关键看你的使用场景。

| 对比维度 | V4-Pro | V4-Flash |

|---|---|---|

| 上下文长度 | 1M Token | 1M Token |

| 世界知识 | 最强,接近Gemini-Pro-3.1 | 略逊于Pro版 |

| 推理能力 | 顶级,数学/代码/推理第一梯队 | 接近Pro,高难度任务略弱 |

| Agent能力 | 最强,简单/复杂任务均出色 | 简单任务接近Pro,复杂任务有差距 |

| API价格 | 较高 | 较低 |

| 响应速度 | 中等 | 快 |

| 适用场景 | 高精度任务、复杂分析、代码生成 | 快速问答、日常使用、简单任务 |

选择建议:

- 高精度分析任务(论文解读、法律合同审查、复杂代码):选V4-Pro

- 日常快速问答(客服、简单查询、内容总结):选V4-Flash

- 不确定先用哪个:从V4-Flash开始,效果不够再升级Pro

进阶技巧:开启思考模式

DeepSeek-V4支持非思考模式和思考模式两种输出方式。思考模式会先展示推理过程,再给出答案,适合复杂问题,但响应时间更长。

在调用API时,通过设置reasoning_effort参数来控制思考强度:low轻度思考,适合简单问题;high深度思考,适合复杂分析;max最大思考强度,适合Agentic Coding等高难度任务。

【金句】 让AI”先想后答”,是复杂问题处理的核心原则。思考模式用额外的等待时间,换来的是质的飞跃。

常见问题解答(FAQ)

Q1:100万Token实际能放多少文字?

A:大约150万-200万汉字,或3000页PDF文本,或50-100篇长篇文章。

Q2:旧API还能用吗?

A:可以。旧的deepseek-chat和deepseek-reasoner接口目前仍可使用,但官方已宣布三个月后(2026年7月24日)停止支持,建议尽快迁移到新接口。

Q3:V4和Claude、GPT比,差距在哪?

A:在Agentic Coding和复杂推理方面,V4-Pro已非常接近顶级闭源模型,但在世界知识储备上仍稍逊于Gemini-Pro-3.1。对于大多数中文使用场景,DeepSeek-V4是完全够用的。

Q4:V4开源了吗?

A:是的,V4已同步开源,可通过HuggingFace和ModelScope下载模型权重。但100万Token上下文需要大显存支持,个人部署门槛较高。

Q5:API调用有额度限制吗?

A:各平台限制不同。百度千帆和硅基流动都有免费额度,正式使用建议购买套餐。

Q6:为什么我的输出质量不稳定?

A:可能是Prompt不够具体。超长上下文对Prompt的要求更高,建议明确指定任务类型、输出格式、约束条件。

总结

DeepSeek-V4的意义,不仅仅是”更长的上下文”,而是让AI真正能够”理解”完整语境。

三个最值得上手的场景:

- 长文档处理:论文、报告、合同一次性全丢给AI

- Agentic Coding:项目级代码理解和生成

- 知识库构建:让AI成为你的第二大脑

API调用方面,百度千帆是国内最推荐的接入方式,硅基流动适合追求性价比的用户。

最后提醒一点:超长上下文能力是工具,能不能用好取决于你提问的能力。掌握结构化Prompt,配合理性使用思考模式,DeepSeek-V4将成为你工作流中最强大的效率武器。

互动话题

你打算用DeepSeek-V4的超长上下文做什么?

- A. 处理长篇文档/论文/报告

- B. 编程和代码分析

- C. 构建个人知识库

- D. 企业级知识管理和分析

- E. 其他用途(欢迎评论)

欢迎在评论区分享你的使用场景!