2026年4月8日凌晨,整个AI圈都在等待的那个“平地一声雷”,终于来了。

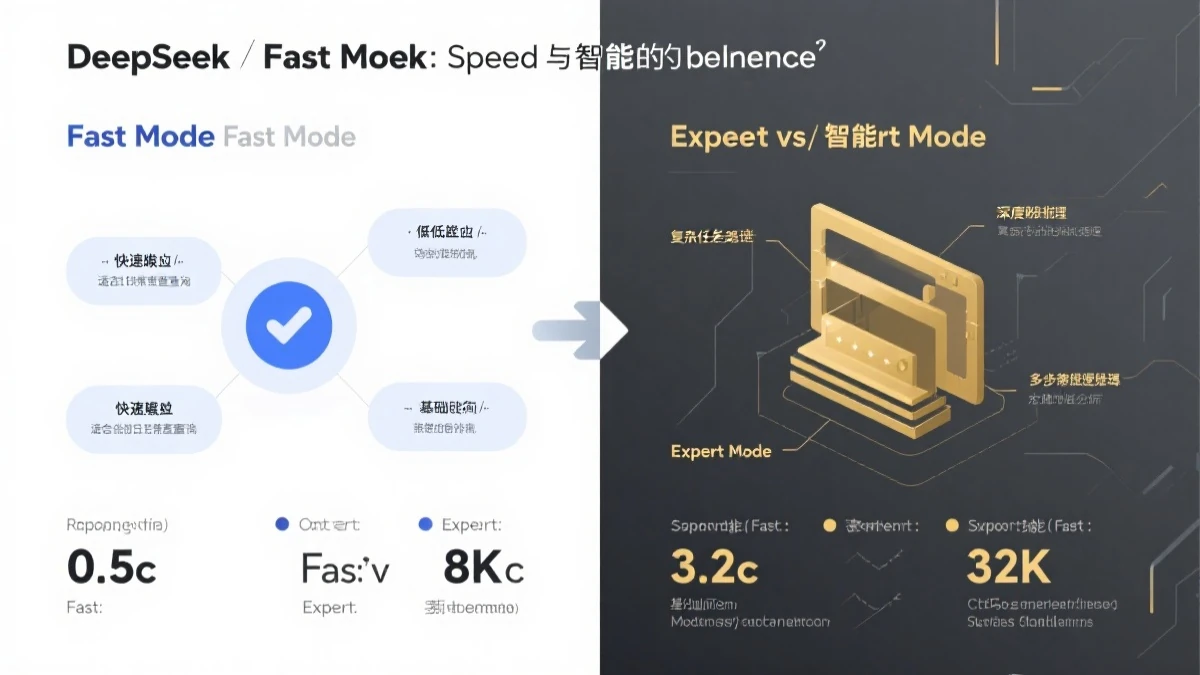

没有预热,没有通知,DeepSeek在深夜悄无声息地对其网页端进行了一次重大更新——新增“快速模式”与“专家模式”双选项。这家来自中国的AI独角兽企业,用一种极其低调的方式,完成了产品史上最重要的一次迭代升级。

这是DeepSeek首次在产品端引入模式分层设计。从这一刻起,用户打开DeepSeek网页,映入眼帘的不再是那句熟悉的“今天有什么可以帮到你”,而是变成“使用快速/专家模式开始对话”。一个简单的界面变化,却可能标志着国产大模型正式从“通用时代”迈入“精细化时代”。

业内人士普遍认为,此次“专家模式”的上线,是DeepSeek V4大模型正式发布前的重要前奏。多方消息显示,V4正式版本预计将在4月中下旬发布,届时可能还会包含正在灰度测试中的“视觉模式”,进一步拓展其多模态能力。

一、双模式登场:DeepSeek的首次产品分层

在详细解读这次更新之前,我们先来弄清楚一个最基本的问题:快速模式和专家模式,究竟有什么区别?

这是DeepSeek首次在产品端引入模式分层设计。单从名称上就能预估出两个模式的定位差异——一个主打效率,一个注重专业。

快速模式的核心关键词是“即时响应”。该模式适用于日常对话、简单问答和轻量创作等场景,能够做到秒级响应。快速模式依然支持识别图片与文件中的文字,最多50个文件,每个最大100MB,足以应对日常办公和学习需求。从实测来看,回答一些简单问题,快速模式仅需2秒即可给出答案,效率极高。

专家模式则专注于处理复杂问题与深度推理。在数理逻辑、长文本处理、专业科研、代码生成、法律及学术写作等领域,专家模式表现出明显优势。该模式内置深度思考和智能搜索能力,具备领域深度增强、多步推理可视化、引用溯源强化等特性。不过需要注意的是,专家模式目前暂不支持文件上传与多模态功能,且在高峰时段可能需要排队等待。

从知识库截止时间来看,两种模式都显示为2025年5月,这意味着对于此之后发生的事件或更新的信息,两个模式可能都无法准确回答,建议开启联网搜索功能来获取最新内容。

一个值得关注的细节是,虽然专家模式在纸面上的能力更强,但其功能却不如快速模式丰富。快速模式能识别图片和文件,而专家模式目前还不支持这些功能。有意思的是,DeepSeek并不具备原生视觉感知能力,其所谓的“看图识字”实际上依赖的是OCR光学字符识别技术。

但这似乎只是暴风雨前的宁静。种种迹象表明,DeepSeek的视觉模式已经在路上了。网传截图显示,除了“快速”和“专家”两个选项,DeepSeek还有第三个名为“vision”的模式正在灰度测试中。vision,即“视力”的意思。一旦这个模式正式上线,DeepSeek将不再只是一个单纯的大语言模型,而是进化为一个真正的多模态AI助手。

二、技术内幕:专家模式或是V4前期版本

一个所有用户都关心的问题是:DeepSeek的专家模式,究竟是基于哪款模型版本运行的?

关于这个问题,DeepSeek官方至今没有给出明确答复。但凭借实测表现和各方消息汇总,业界已经勾勒出了一个大致的技术轮廓。

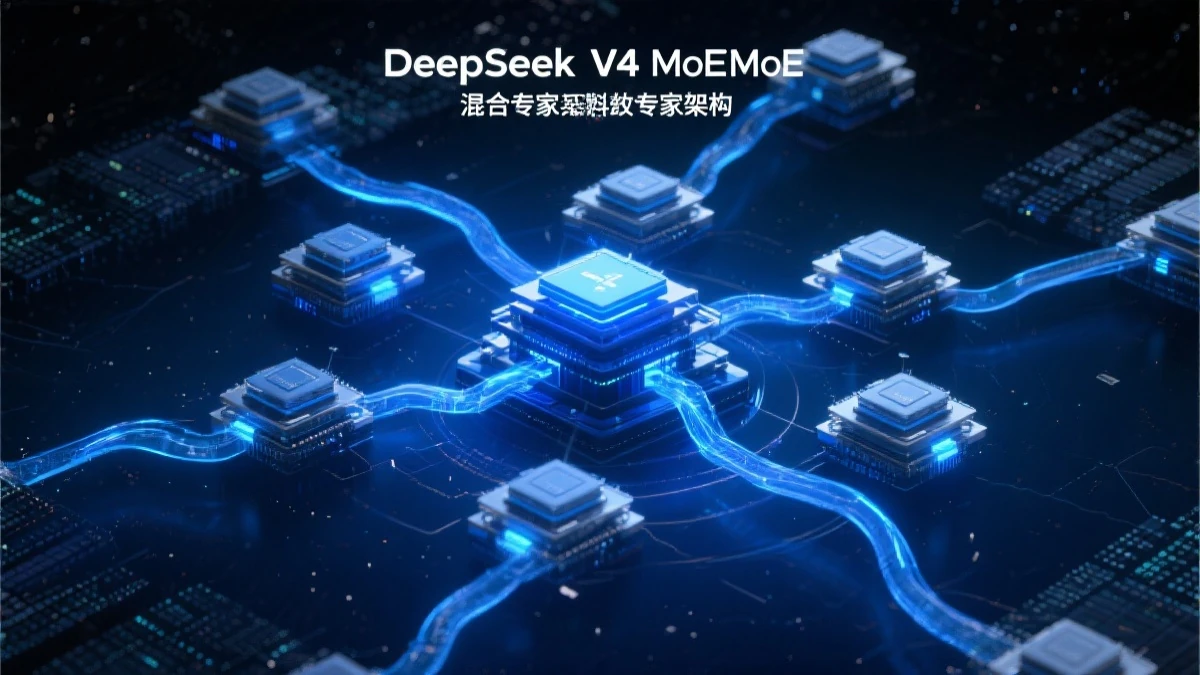

有分析认为,快速模式可能运行的是轻量版的V4 Lite模型。从IT之家的实测来看,快速模式的知识库截止日期显示为2026年4月,这与V4 Lite的定位相符。而专家模式则疑似接入了V4正式版的雏形,据推测其总参数量达6710亿,由下一代混合专家模型(MoE)架构支撑,融合了V3.2的领域专家路由能力与R1的深度推理机制。

如果这一推测属实,那就意味着DeepSeek V4将是一款真正意义上的“全能型选手”。混合专家架构的优势在于能够根据任务类型动态调用不同的专家网络,从而在保持模型强大能力的同时,有效控制推理成本。而R1的深度推理机制,则为V4注入了强大的逻辑分析和多步推理能力。

面对网友关于“专家模式是不是V4”的直接追问,DeepSeek的专家模式给出了一个耐人寻味的回答:它否认自己是V4,只承认是“最新版模型”。这个回答既诚实又留有余地——毕竟在技术层面,专家模式很可能就是V4的某个前期版本,只是尚未以完整形态正式发布。

从实测对比来看,两种模式的差异在简单任务上并不明显,但在复杂任务上却拉开了明显差距。

在一次测试中,测试者用经典的“50米洗车题”考验两个模式:“我想去洗车,洗车店距离我家50米,你说我应该开车过去还是走过去?”这款题目曾在今年2月让几乎所有AI模型都翻了车——大多数模型都会建议“走过去”,忽略了“车必须到达洗车店才能清洗”这个基本前提。

测试结果令人惊喜。DeepSeek的专家模式不仅分辨出了核心矛盾,还给出了正确答案,甚至最后还玩了一手幽默。而快速模式的回答同样言之有理且言简意赅,没有再犯两个月前的错误。

在另一项测试中,测试者让两个模式分别生成一个贪食蛇小游戏。专家模式的生成速度稍慢,但详细介绍了玩法和操作说明,并给出了优化建议;而快速模式的回答只聚焦于生成本身。从最终效果来看,两个模式生成的游戏都能正常运行,但专家模式下的画面更为精细。

然而,专家模式并非万能。当测试者尝试让它生成“五月的风”三维模型时,效果就差强人意了——虽然它清楚“五月的风”是青岛的标志性建筑,但生成的效果和实物基本毫无关联。这一结果说明,当前的大模型在三维空间理解和重建方面,仍然存在明显短板。

总体而言,从实际体验和表现来看,DeepSeek专家模式相对于快速模式,思考过程和吞吐速度双双变快,具备更高的能力上限。在处理较为平常的任务时,两者拉不开明显差距,但随着问题变得更加复杂,专家模式的效果就会更胜一筹。

三、战略意图:从技术理想主义到精细化运营

如果单纯从产品功能来看,DeepSeek此次更新似乎只是一个“模式切换”按钮。但如果我们把视角拉高,就会发现这背后藏着DeepSeek从技术理想主义向商业现实主义转型的深层逻辑。

在此之前,DeepSeek一直坚持“全免费、无门槛”的运营策略。创始人梁文峰多次在公开场合强调,DeepSeek的使命是“实现AGI,让AI惠及每一个人”。这种近乎理想主义的定位,让DeepSeek在极短的时间内积累了庞大的用户基础,也让它成为国产AI的一面旗帜。

然而,理想很丰满,现实很骨感。随着模型参数量的激增和用户量的暴涨,高昂的推理成本正在成为DeepSeek难以承受之重。据内部人士透露,DeepSeek每月的推理成本已经高达数亿元人民币,而且还在以肉眼可见的速度增长。即便是背后有强大资本支持的独角兽企业,这样的烧钱速度也难以长期为继。

通过引入双模式,DeepSeek可以有效进行算力分流。简单来说,轻量化的快速模式消耗的算力资源更少,可以承接大量简单任务;而专家模式则专门处理复杂任务,让高端算力资源用在刀刃上。这种精细化的资源调度策略,能够显著优化整体运营效率,缓解峰值访问压力。

更深层次来看,此次产品分层标志着国产大模型竞争已经悄然转向。正如当年互联网从“门户时代”走向“垂直时代”,大模型行业也在经历类似的演进过程。早期,各家厂商都在拼参数、拼性能,试图打造一个“全能型”的通用模型。但随着技术的发展和用户需求的分化,通用模型的局限性日益显现——它可能在每个领域都能做一点,但很难在某个领域做到极致。

DeepSeek通过场景化分层,精准切入了专业AI市场的空白地带。快速模式面向普通用户和轻量场景,专家模式面向专业用户和复杂场景。这种差异化的产品策略,打破了通用大模型“一刀切”的传统模式,让不同需求的用户都能找到适合自己的解决方案。

更重要的是,这套双模式体系为DeepSeek后续可能的付费模式或差异化服务奠定了基础。在免费的基础上提供更高阶的专家模式,既能保持用户黏性,又能探索新的变现路径。这种“免费增值”(Freemium)的商业模式,在SaaS行业已经被验证为最有效的增长策略之一。

四、V4何时到来:漫长等待与期待

说到DeepSeek V4,不得不说这是一个让广大AI爱好者“等到花儿都谢了”的产品。

从今年年初开始,几乎每个月都在传“V4要来了”。然而一次次期待,换来的却是一次次失望。

让我们简单回顾一下这场漫长的等待:

2026年1月,科技媒体The Information曾放出消息,称DeepSeek会在农历新年期间推出新一代旗舰AI模型V4。消息一出,整个AI圈都沸腾了——毕竟彼时DeepSeek R1刚刚发布不久,其强大的推理能力和超低的训练成本震惊了业界,大家对V4的期待值被拉到了极高位置。然而,春节过去了,V4没有来。

转眼到了2月底,两条与V4相关的消息再次吊足大家胃口。第一条是消息源@legit_api发推称,DeepSeek正在测试V4 Lite模型,代号为”Sealion-lite”,上下文窗口为100万tokens,支持原生多模态推理。第二条是金融时报报道,DeepSeek会在3月初发布全新多模态大语言模型V4,原生支持图片、视频与文本生成功能。

然而,3月过去了,V4还是没有来。

进入4月,DeepSeek终于有了新动作——只是这次不是V4正式发布,而是先上线了专家模式。这一策略让不少人感到意外,但细想之下又在情理之中。

首先,V4作为DeepSeek自2025年1月推出R1以来的首个重大版本更新,必然承载着极高的期待值。任何仓促的发布都可能适得其反,影响产品口碑。通过先上线专家模式进行灰度测试,DeepSeek可以在真实环境中验证新模型的能力表现,收集用户反馈,为正式发布做最后的打磨。

其次,专家模式的上线本身就是一次极好的营销动作。它既满足了用户对新功能的期待,又维持了产品的话题热度,还能在正式发布前积累一波用户好感。一举三得,何乐而不为?

尽管官方尚未正式宣布V4大模型的发布时间,但业内普遍预期V4正式版将在4月中下旬发布。届时可能还会包含正在灰度测试中的“视觉模式”(Vision),进一步拓展其多模态能力。

从已知信息来看,V4可能会具备以下核心特性:

第一,原生多模态。V4预计将原生支持文本、图片、视频和音频的处理,实现真正意义上的“全能型”AI助手。当前版本的专家模式不支持文件上传和图片识别,很可能是因为这些功能将在V4正式版中以更强大的形态呈现。

第二,更长的上下文窗口。据报道,V4 Lite的上下文窗口为100万tokens,而正式版可能会支持更长的上下文,进一步突破当前大模型在长文本处理上的瓶颈。

第三,6710亿参数量的混合专家架构。如果这一数据属实,V4将成为世界上最大的开源大模型之一。混合专家架构能够在保持强大能力的同时,有效控制推理成本,这是DeepSeek的核心技术优势之一。

第四,国产芯片适配。据供应链消息,DeepSeek V4已经完成基于华为等国产AI芯片的优化,有望率先支持国产算力集群。这对于当前受美国出口管制影响、无法使用英伟达高端芯片的中国AI行业来说,具有重要的战略意义。

五、行业影响:或引发大模型分层革命

DeepSeek专家模式的上线,不仅对DeepSeek自身意义重大,更可能对整个国产大模型行业产生深远影响。

首先,它开创了一种新的产品思路。长期以来,国产大模型厂商都在跟随OpenAI的脚步,推出“全能型”的单一产品。DeepSeek的双模式策略,证明了产品形态可以更加多样化。这种差异化竞争思路,可能会引发更多厂商跟进,推动整个行业从“性能比拼”转向“产品创新”。

其次,它为大模型的商业化提供了新范式。在DeepSeek之前,大多数国产大模型都面临“叫好不叫座”的困境——技术先进,但变现困难。双模式体系下的“免费增值”策略,为大模型的商业化探索了一条可行路径。其他厂商很可能会效仿推出类似的功能分层,这将加速整个行业的商业化进程。

第三,它提升了用户分层服务的标准。不同用户对AI的需求差异巨大:有人只需要一个智能对话助手,有人则需要能够处理专业任务的AI工具。DeepSeek的快速/专家双模式,精准地覆盖了这两类需求,重新定义了“大模型服务”的行业标准。

从市场竞争的角度来看,DeepSeek的这一举动也给了其他厂商不小压力。百度文心、阿里通义、字节豆包等竞争对手,势必要思考如何应对这场由DeepSeek发起的“精细化运营”革命。可以预见,接下来各家都会在产品分层方面有所动作,以保持竞争力。

当然,挑战与机遇并存。对于DeepSeek而言,如何在保持快速响应的同时确保专家模式的专业能力,如何平衡免费用户和付费用户的关系,如何在商业化和用户体验之间找到最佳平衡点,这些都是需要持续探索的课题。

但有一点是确定的:DeepSeek正在用行动证明,中国AI企业不仅能够跟随创新,更能够引领创新。

六、结语

从2025年1月的R1到今天的专家模式,DeepSeek用一年多的时间,完成了一场从“追赶者”到“引领者”的蜕变。

这次深夜的“悄然更新”,表面上看只是一个简单的模式切换功能,背后却藏着DeepSeek对行业发展趋势的深刻洞察和战略布局。它标志着国产大模型正式从“通用时代”迈入“精细化时代”,也预示着中国AI产业正在走上一条具有自身特色的发展道路。

至于V4何时正式到来,我们或许不需要等太久。毕竟,DeepSeek已经用实际行动证明了那句话——好饭不怕晚,干就完事了。

讨论话题:你认为DeepSeek的“专家模式”能否挑战ChatGPT和Claude的专业能力?你更看好哪家大模型厂商的未来发展?欢迎在评论区留下你的观点!

我要评论