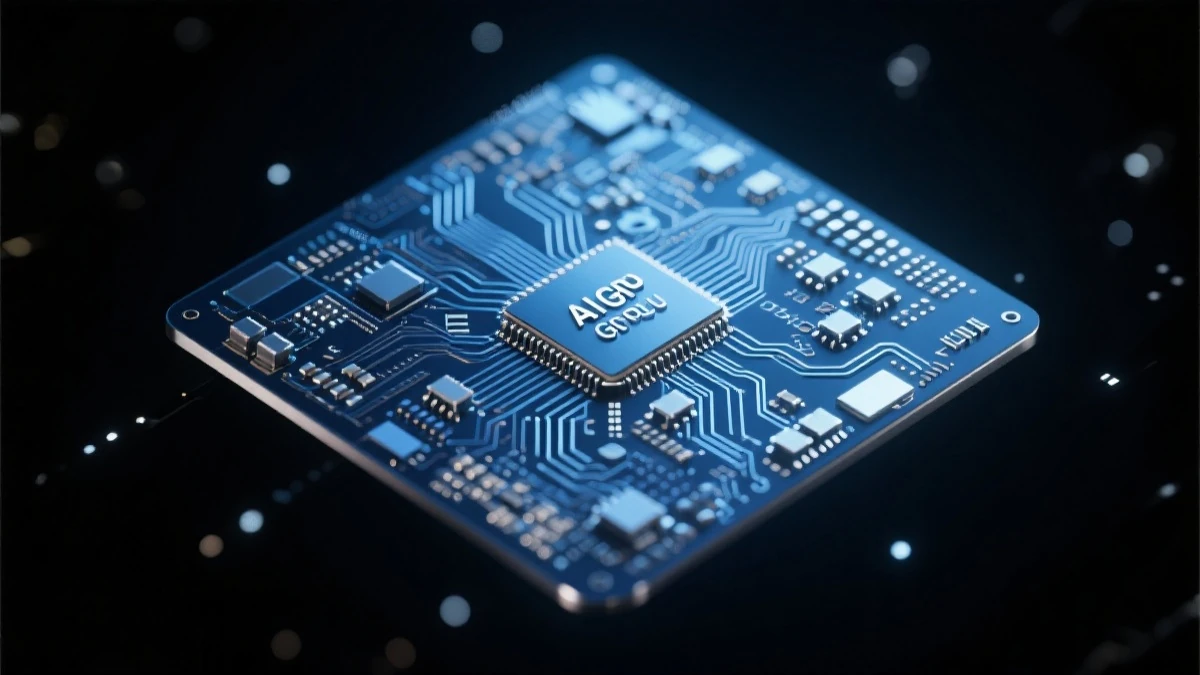

随着AI大模型迈入万亿参数时代,智算基础设施正迎来系统性变革的关键窗口。2026年4月9日至10日,2026 Open AI Infra Summit将在北京举行,这场由全球计算联盟(GCC)指导、Open AI Infra社区(OAII社区)主办的大会,将汇聚院士专家、产业领袖与行业用户,围绕高速互联、800V高压供电、全栈液冷、超节点生态等核心议题,全面呈现下一代AI算力底座的技术路径与产业实践。

这不仅仅是一场技术大会,更是AI时代算力基础设施话语权的争夺战。

为什么2026年的AI算力大会如此重要?

回顾2025年,大模型竞争的核心是参数规模——谁家模型参数多,谁就是行业龙头。但到了2026年,竞争的焦点正在悄然转移:不再是”模型有多聪明”,而是”算力有多强”。

这个转变的逻辑很清楚:大模型能力的天花板,很大程度上取决于底层算力的支撑。GPT-5、Gemini Ultra、Claude 4……这些顶级模型的训练,无一不需要海量算力支撑。而当模型能力逐步接近,数据和算法趋同,算力基础设施的成本、效率、稳定性,就成了决定谁能笑到最后的核心变量。

这就是为什么2026 Open AI Infra Summit会引起整个行业的关注——这里讨论的,不是”AI能做什么”,而是”AI靠什么支撑”。

大会核心议题:算力基础设施的六大技术方向

根据已公布的主论坛议程,本次大会设置了六大垂直专场分论坛,覆盖了AI算力基础设施最核心的技术领域:

| 技术方向 | 核心议题 | 为什么重要 |

|---|---|---|

| 高速互联 | GPU互联带宽、低延迟网络 | 万卡集群内部通信效率直接决定训练速度 |

| 800V供配电 | 高压直流供电、能效优化 | 数据中心电费占运营成本60%以上 |

| 全栈液冷 | 整机柜液冷、浸没式冷却 | AI芯片功耗密度远超传统服务器 |

| 超节点生态 | 万卡集群架构、生态协同 | 单卡无法支撑大模型,需要集群协同 |

| 吉瓦级AIDC | 超大规模数据中心建设 | 万卡集群需要吉瓦级电力支撑 |

| 超节点Benchmark | 性能评估标准、算力度量 | 没有标准就没有比较,生态难以协同 |

这六大方向,构成了AI算力基础设施的全栈技术图谱。从底层的电力供应,到芯片间的互联互通,再到整体的散热系统——每一个环节的突破,都可能成为改变竞争格局的关键变量。

大厂角力:谁在布局下一代算力底座?

大会技术分享环节的嘉宾名单,堪称中国AI算力产业的全明星阵容:

字节跳动:技术专家高晓军将分享兆瓦级算力系统的技术趋势与挑战。字节跳动近年来在大模型领域投入巨大,其算力基础设施的规划备受关注。

华为:龙盘将介绍社区在兆瓦级算力系统方面的技术探索与规划。华为在昇腾芯片和计算产品线的布局,被认为是国产AI算力的核心支柱。

京东云:高级总监陈国峰将带来一线实践案例。京东云在智算中心建设方面已有不少落地经验。

世纪互联:执行副总裁闫昆将展现不同场景下的落地路径。世纪互联是国内头部数据中心运营商之一。

这份嘉宾名单透露出的信号很清楚:AI算力不再是单一技术的竞争,而是”芯片-服务器-数据中心-软件平台”全栈能力的综合较量。

Open AI Infra社区:算力新生态的构建者

值得注意的是,本次大会的主办方OAII社区,是在2025年10月28日在北京正式成立的。这是一个值得关注的新变量。

根据公开信息,Open AI Infra社区(OAII社区)定位为”面向AI时代全栈智算基础设施的开放协作平台”,致力于通过开放共创模式,链接大用户与核心技术方,联合产业链上下游伙伴推进技术规范制定与方案落地。

“开放协作” 是这个社区的核心关键词。在AI算力竞争日益白热化的背景下,各家厂商的技术路线、硬件规格、软件接口都不尽相同——这给整个行业的协同带来了巨大障碍。一家厂商的训练集群,换到另一家厂商就可能水土不服;一款芯片的优化方案,换到另一款芯片可能完全失效。

OAII社区试图解决的就是这个问题:通过制定统一的技术标准和接口规范,让不同厂商的硬件和软件能够互联互通,降低整个生态的协同成本。

如果这个目标能够实现,AI算力产业可能迎来类似个人电脑时代的”即插即用”时刻——不再需要为每款芯片单独优化,一套软件可以在不同厂商的硬件上无缝运行。

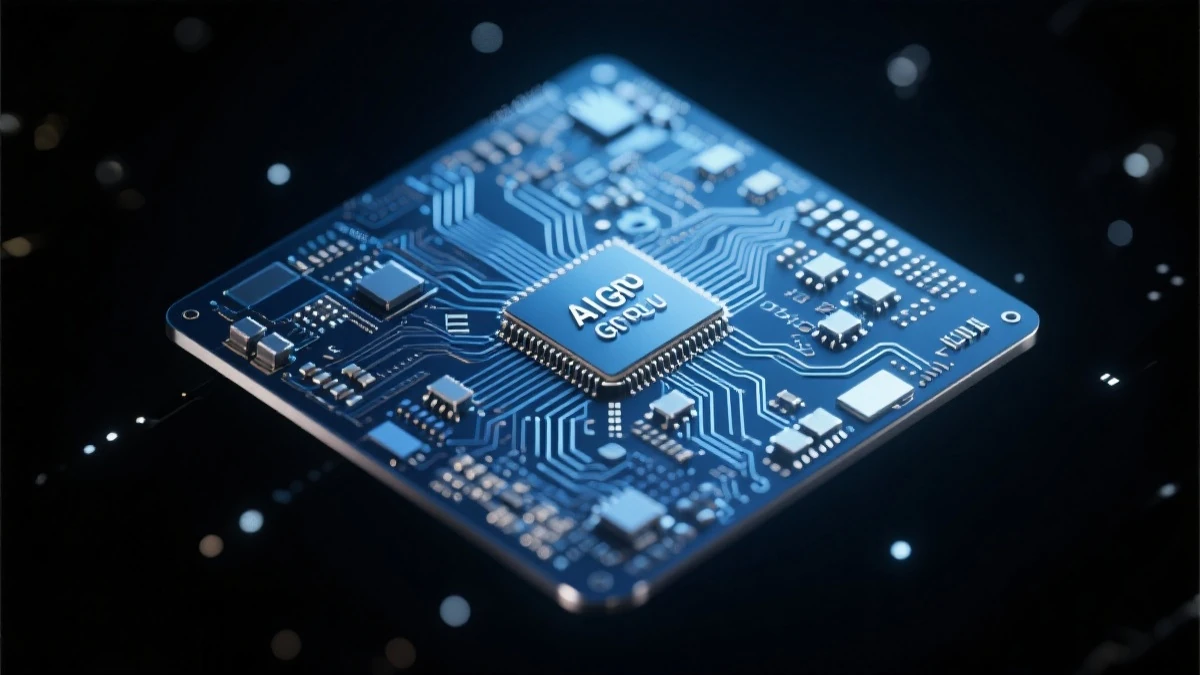

从”堆卡”到”系统战”:AI算力的范式转移

过去几年,AI算力的竞争逻辑相对简单:堆更多的卡,用更多的电。但随着模型规模持续扩大,这个玩法的边际收益正在递减。

原因很简单:当你把一万张GPU卡连在一起的时候,问题不再是”能不能造出来”,而是”能不能高效协同”。卡与卡之间的通信带宽、计算任务的分配调度、散热系统的设计……每一个环节都可能成为新的瓶颈。

这就是为什么”超节点”成为本次大会的核心议题之一。超节点不是简单的”更多卡”,而是需要从芯片、服务器、网络、存储、软件的全面协同优化。它考验的不是单一技术的极限,而是系统整合的能力。

液冷技术:被忽视的算力革命

在大会的六大技术方向中,”全栈液冷”可能是普通人最不熟悉、但实际上最为关键的方向之一。

传统数据中心使用风冷散热——通过空调和风扇带走热量。但AI芯片的功耗密度远超传统芯片,一张高性能AI芯片的功耗可能达到700W甚至更高,是传统CPU服务器的5-10倍。

风冷已经不够用了。 这就是为什么液冷技术正在成为数据中心的新标配。

液冷技术主要分为三种形态:

- 冷板式液冷:芯片上装一块金属冷板,冷却液从冷板内部流过带走热量。改造成本相对较低,是目前最常见的方案。

- 浸没式液冷:整个服务器浸入冷却液中,散热效率最高,但对服务器和冷却液的要求也最高。

- 整机柜液冷:整个机柜一体化设计,冷却液在柜内循环。适合新建数据中心。

大会上,来自英维克等企业的专家将分享液冷技术的最新进展。对于AI数据中心来说,液冷不只是散热问题,更是能效问题——散热效率直接影响PUE(数据中心能效指标),而PUE每降低0.1,就意味着电费节省10%以上。

中国算力竞赛:为什么这次大会值得关注?

2026年,中美科技竞争进入新阶段,AI算力成为双方博弈的关键领域之一。一方面,美国在芯片和基础软件方面仍有优势;另一方面,中国在应用创新和系统集成方面正在快速追赶。

在这样的大背景下,Open AI Infra Summit的举办就有了特殊意义:

第一,这是中国AI算力产业的一次集中亮相。 从芯片到服务器,从数据中心到软件平台,国内主要玩家都会参会,展示自己的技术实力和产品方案。

第二,这是产业生态协同的重要契机。 OAII社区的标准能否得到广泛采纳,产业链上下游能否形成合力,这次大会将是重要的观察窗口。

第三,这是预判AI算力竞争走向的关键信号。 大会上透露的技术方向和产业规划,很可能影响接下来1-2年的行业竞争格局。

深度分析:AI算力基础设施的三大趋势

结合大会议题和产业动态,以下三个趋势值得关注:

趋势一:开放生态将成为主流

过去几年,AI算力领域呈现”各自为战”的局面——每家厂商都有自己的芯片架构、服务器规格、软件生态。但随着模型训练对算力的需求超越单一厂商的供应能力,开放协同变得不可或缺。

OAII社区的成立,正是这种趋势的体现。开放不等于没有竞争,而是在竞争中寻求协同,最终让整个生态蛋糕做大。

趋势二:液冷将从”可选”变”必选”

随着AI芯片功耗密度持续上升,风冷正在接近物理极限。液冷不再是高端数据中心的”锦上添花”,而是新建智算中心的”必选项”。

这将带动液冷产业链的整体爆发:从冷却液到管路,从机柜设计到监控系统,每个环节都有技术升级的空间。

趋势三:算力度量标准化迫在眉睫

“我的算力比你强”——这句话在今天很难回答,因为大家没有统一的度量标准。同样是1000 PFLOPS的算力,实际性能可能相差数倍。

大会上将发布的超节点性能基准Benchmark工具,正是要解决这个痛点。没有标准就没有比较,没有比较就没有改进。一旦行业标准确立,算力供应商的竞争将更加透明,终端用户的选择也将更加理性。

大会看点抢先知

根据已公布的日程,以下几个环节值得关注:

看点一:院士致辞——中国工程院院士、清华大学教授郑纬民将出席大会。作为国内计算机系统的泰斗级人物,他的致辞可能透露AI算力发展的战略方向。

看点二:技术规范发布——《GCC液冷整机柜系统架构设计规范-A型》、《AIDC基础设施规范》等一系列技术标准将在大会期间发布。这可能是中国AI算力基础设施领域的首批行业标准。

看点三:超节点Benchmark亮相——性能评估工具的发布,意味着行业即将告别”各自声称”的混沌状态。

看点四:圆桌对话——产业链上下游如何协同创新,数据中心如何实现绿色低碳转型,这些问题将在大会论坛环节得到讨论。

结语:算力新基建,2026年的关键之战

如果说2023-2025年,AI竞争的主战场在模型能力;那么2026年开始,竞争的主战场正在转向支撑模型运转的算力基础设施。

这个转变的意义在于:它不再只是算法工程师的事,而是涉及芯片、服务器、网络、电力、散热等多个领域的大工程。它需要的不是单点突破,而是系统整合能力。

Open AI Infra Summit 2026,将是这个新战场的一次预演。谁能在这次大会上展示更强的技术实力和生态号召力,谁就更有可能在接下来的AI算力竞赛中占据有利位置。

4月9日,北京,见真章。

今日话题:你认为中国AI算力基础设施最需要突破的环节是什么?是芯片性能、散热技术,还是标准统一?

相关阅读:

- OAII社区官网及入会通道

- 全球计算联盟(GCC)技术标准体系

- 国际液冷数据中心案例集

我要评论