2026年3月,一场席卷全球云厂商的涨价潮震惊了整个AI行业。

不到一年前,阿里云、京东云、腾讯云、华为云还在大打价格战,”最高降幅达60%”的口号此起彼伏。但市场的风向在2026年3月骤然转向——从国外到国内,谷歌云、亚马逊云、腾讯云、阿里云、百度智能云等在短短10天内相继发布调价公告,核心AI算力与存储服务价格普遍上调约30%至50%,其中腾讯云的部分核心产品涨幅高达400%。

这个动作打破了中国云计算行业多年来”持续降价”的定价惯例,也揭开了大模型时代算力供需失衡的尖锐矛盾。

导语

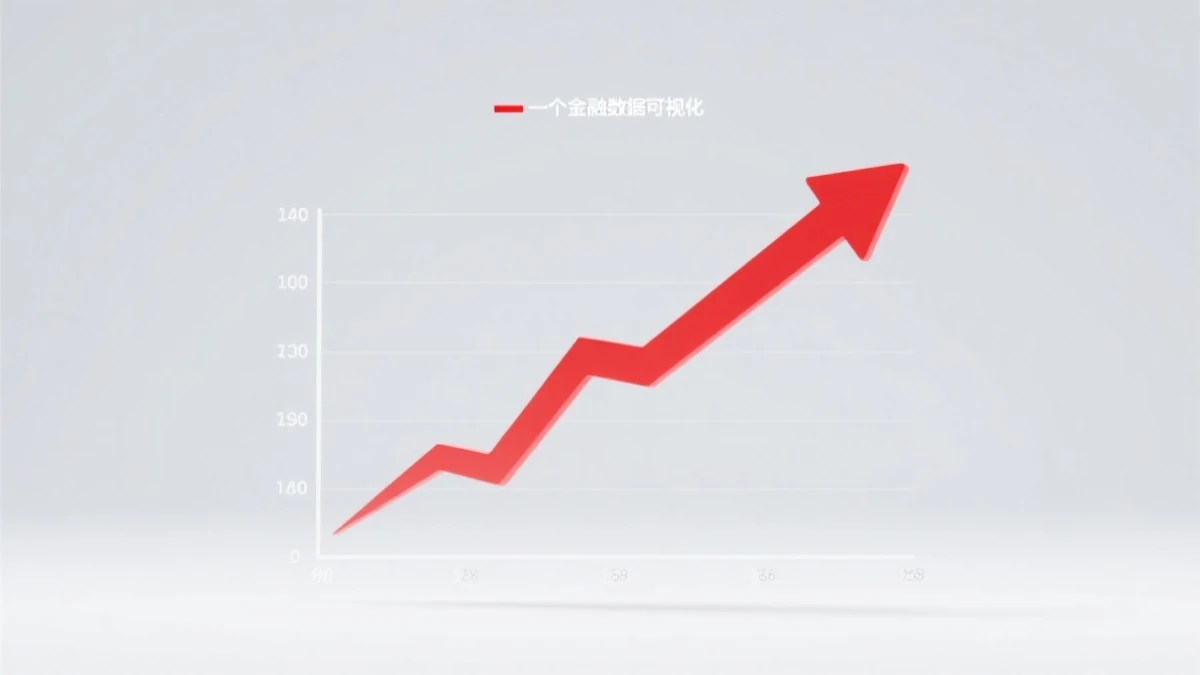

2024年初,中国日均AI Token调用量约为1000亿。2026年3月,这个数字已突破140万亿——两年时间,增长超1400倍。

Token,这个AI时代的”新石油”,正在以前所未有的速度被消耗。而它的价格走势,也从”暴跌”转向”暴涨”,演绎出一场现实版的”过山车”行情。

算力涨价潮的背后,是整个AI产业从”卷能力”向”卷用量”的深刻转型。 这场涨价不只是简单的商业策略调整,而是算力供需关系发生根本性变化的信号。

当供需天平开始倾斜,一场关乎云市场未来格局的排位赛重新打响。

01 从降价60%到涨价400%:算力市场的惊天逆转

1.1 曾经的”价格战”:云厂商的获客大战

把时间拨回2025年4月。彼时,大模型市场刚刚爆发,各家云厂商为了争夺客户,展开了一场惊天动地的价格战。

阿里云率先打响第一枪,宣布核心产品降价高达60%。京东云、腾讯云、华为云纷纷跟上,”最高降幅60%”的口号此起彼伏。这场价格战让整个行业瞠目结舌,也确实为各家带来了大量新客户。

但这场狂欢背后,隐藏着巨大的隐忧。“免费红利”本质上是在烧钱获客,而非可持续的商业模式。 一位从业者回忆说,那时候的价格”低到不可思议”,很多项目的毛利已经是负数。

1.2 涨价潮来袭:10天内集体转向

2026年3月,市场风向骤变。

从国外到国内厂商,包括谷歌云、亚马逊云、腾讯云、阿里云、百度智能云等,在10天内相继发布调价公告:

| 云厂商 | 涨价幅度 | 核心产品 |

|---|---|---|

| 阿里云 | 5%-34% | AI算力、CPFS文件存储 |

| 腾讯云 | 部分达400% | 智能体开发平台部分模型 |

| 百度智能云 | 5%-30% | AI算力相关服务 |

| 谷歌云 | 北美涨100% | 核心云服务 |

| 亚马逊AWS | 15% | 大模型训练用EC2 |

这一涨价潮打破了云计算行业多年来”持续降价”的定价惯例,让不少市场参与者猝不及防。

但这个动作实际上揭开的是大模型时代算力供需失衡的尖锐矛盾。 不少行业人士认为,集体涨价的直接导火索,核心是AI词元(Token)需求的爆炸式增长。

1.3 供需关系的根本性转变

供需天平开始发生倾斜,是这场涨价潮的核心原因。

根据国家数据局数据,2026年3月,中国日均Token调用量已突破140万亿,而这一数字在2024年初仅为1000亿,两年间增长超千倍。

尽管过去两年Token价格经历了”断崖式”下跌——从每百万Token 50-100元的初始定价,一路降至几块钱甚至几毛钱,降幅高达99%——但价格的”普惠”速度,终究难抵调用规模的指数级扩张。

一位从业者直言:”之前价格战是为了获客,现在的涨价是因为真的扛不住了。Token消耗量太大了,GPU根本不够用。”

02 Token调用量暴增1400倍:智能体引爆算力需求

2.1 智能体:算力消耗的”黑洞”

如果说传统聊天是AI的”小打小闹”,那么智能体(Agent)就是算力消耗的”黑洞”。

据大会和众汇富研究观察,不同于以往AI以”聊天交互”为主的应用场景,以OpenClaw为代表的智能体,能够自主执行编程、数据分析、自动化办公等复杂任务,其Token消耗密度远超传统问答——一个编程任务消耗的Token量可达同等长度对话的10至100倍。

一个简单的对比:

- 传统问答:用户问”今天天气如何”,AI回答。消耗Token:约100个。

- 智能体任务:用户说”帮我分析这个月的销售数据并生成报告”。智能体需要:读取数据文件、理解数据内容、调用分析工具、生成图表、撰写报告。消耗Token:约10万-100万个。

差距高达1000倍!

2.2 从”训练”到”推理”:双轮驱动的新格局

算力需求正在从”云端训练”转向”训练+推理”双轮驱动。

过去,AI算力的主要消耗在模型训练阶段。一旦模型训练完成,推理阶段的算力消耗相对较小。但随着AI应用的大规模落地,推理阶段的算力消耗正在呈指数级增长。

OpenClaw等智能体产品的爆发,让这一趋势更加明显。一个智能体任务可能需要调用成百上千次AI能力,每一次的Token消耗叠加起来,就形成了惊人的算力需求。

据无问芯穹平台数据显示:自2026年1月底起,日均Token调用量平均每两周翻一番,到3月底已增长10倍。这种增速被业内形容为“堪比3G时代手机流量爆发”。

2.3 字节豆包:日均100万亿Tokens

在Token消耗的战场上,字节跳动已经成为不可忽视的力量。

火山引擎的豆包大模型日均调用量超过100万亿Tokens,跻身全球前三。 这一数字甚至超过了很多厂商的想象空间。

100万亿Tokens是什么概念?如果用传统的API调用方式来计算,这相当于每天处理了数十亿次对话交互。而这,只是中国AI算力消耗的冰山一角。

03 涨价的多米诺骨牌:成本压力向下游传导

3.1 云厂商的成本困境

云厂商的涨价,核心原因是算力成本的急剧攀升。

高端GPU供应紧张、服务器采购成本同比大幅上涨,叠加Token调用量爆发导致的高负载运营压力,让”免费红利”难以为继。

一位云厂商内部人士透露:”GPU的采购价格过去一年涨了30%以上,而且有钱还不一定买得到。英伟达的H100、H200系列,现在交货周期已经排到2027年了。”

“提价成为维持服务质量与商业可持续性的刚性选择。” 和众汇富研究报告指出,云厂商涨价并非单纯的战略调整,而是迫于成本压力的无奈之举。

3.2 下游AI企业的成本地震

云厂商的调价,正在引发一场”成本地震”,直接冲击下游AI应用企业。

“涨价当然有影响”,一位AI行业从业者直言,算力价格上调直接导致企业运营成本上涨,原本的预算规划可能会被彻底打乱,“这就意味着预算需要重新评估”。

这种成本压力,对不同规模的企业影响不同:

大型企业:虽然也受到影响,但可以通过长期协议锁定优惠价格,规模效应带来一定的议价能力。

中小企业:资金少、话语权弱,既没法像大客户那样靠长期协议锁定优惠价,也承担不起高端算力的高额开销。一位创业者表示:”大企业还能通过采购规模议价,但小型AI项目的创业者,很难要到一个理想的折扣。”

3.3 行业门槛抬高:新人入局更难

算力成本大涨,直接抬高了AI行业的创业门槛。

新项目启动资金要翻倍,融资也更难了。 原本打算入局的创业者,只能搁置项目、转做其他赛道。而已经在做的中小玩家,要么缩减规模,要么就得面对亏损。

这种”马太效应”正在加速行业洗牌。资源向头部玩家集中,中小玩家的生存空间被进一步压缩。

04 反常现象:涨价83%后调用量仍增长400%

4.1 智谱AI的价格调整实验

在这轮涨价潮中,有一个反常的现象值得关注:

智谱AI在2026年一季度将API价格上调83%后,调用量反而增长了400%,市场呈现供不应求状态。

这个数据打破了传统经济学”价格上涨需求下降”的常识,揭示了AI算力市场的特殊逻辑。

背后的原因在于:对于真正需要AI能力的企业来说,算力成本只是其整体成本的一小部分。只要AI带来的价值足够大,企业愿意为此付出更多。

一位使用智谱AI的企业负责人算了一笔账:”我们用AI替代了原来3个人的工作量,每年节省的人力成本超过50万。而API调用费用增加的部分,也就几万块。这笔账怎么算都划算。“

4.2 供需失衡下的定价权转移

智谱AI的案例说明,在供需失衡的市场中,定价权正在从买方转向卖方。

当算力供不应求时,云厂商拥有更大的定价权。即使涨价,只要不超过客户愿意承受的上限,需求就不会明显下降。

这种情况,在历次技术革命中都曾出现。比如早期的电力、上网费用、石油等,都经历过类似的”稀缺溢价”阶段。

4.3 金山云:智算云收入同比增长95%

算力涨价对于云厂商来说,意味着盈利能力的改善。

金山云2025年第四季度智算云账单收入同比增长95%至9.3亿元,连续两个季度实现调整后经营利润转正。

这是云计算厂商多年来梦寐以求的”拐点”。过去,云计算一直被质疑是”赚辛苦钱”的生意,毛利率远低于软件服务。但智算云的崛起,正在改变这一刻板印象。

05 Token经济:算力时代的商业逻辑重构

5.1 Token:AI时代的”硬通货”

英伟达创始人黄仁勋在GTC大会上直言:“Token将是未来数字世界最核心、最值钱的大宗商品,Token的吞吐量将成为全球企业CEO追踪的核心经营数据。”

这一判断揭示了Token在AI时代的重要地位。

从技术角度看,Token是AI理解和处理信息的最小单元。从商业角度看,Token正在成为连接技术供给与商业需求的结算单位。

谁掌握了更多Token的消耗能力,谁就掌握了AI时代的主动权。

5.2 全产业链协同发展

Token经济的发展,正在带动全产业链协同发展。

上游:芯片厂商。英伟达、AMD等芯片厂商的GPU供不应求,价格持续走高。

中游:云厂商。阿里云、腾讯云、百度智能云等正在从传统的IaaS服务商转型为AI基础设施提供商。

下游:应用厂商。各种AI应用如雨后春笋般涌现,形成了蓬勃的应用生态。

5.3 运营商入局:三大佬的Token经营

更值得关注的是,三大运营商也在加速布局Token经营服务。

中国电信已为企业客户定制开发73个智能体,带动年消耗1.2万亿词元。这一数字虽然与互联网巨头相比还有差距,但运营商拥有的渠道优势和客户基础,让其在AI变现赛道上不容小觑。

中国移动、中国联通也在积极布局AI算力服务,传统的通信管道正在升级为智能时代的算力管道。

06 算力供给侧的创新突破

6.1 国产芯片的崛起

在高端GPU受限的背景下,国产芯片正在加速崛起。

中科曙光推出无线缆箱式超节点scaleX40,在典型推理场景下同卡数规模的推理吞吐性能提升4倍以上。

这一突破意味着,即使在高端芯片受限的情况下,通过系统优化和创新架构,国产设备也能满足大部分AI推理需求。

6.2 超节点技术:整合多厂家GPU

中兴通讯推出超节点技术,将数十至数百颗多厂家GPU逻辑整合为统一计算单元。

这种技术路线的创新,为打破单一芯片依赖提供了新的思路。通过软件定义的方式,将不同厂商的GPU整合成统一的算力资源池,可以更灵活地满足各种AI workload的需求。

6.3 液冷技术:破解散热难题

随着算力密度不断提升,散热成为制约算力增长的瓶颈之一。

英伟达Rubin架构芯片的功耗高达2000W,传统风冷已无法满足需求。 全液冷时代正在加速到来。

国内多家厂商也在积极布局液冷技术。从浸没式液冷到冷板式液冷,各种技术路线百花齐放。这不仅解决了散热问题,也为数据中心的高密度部署提供了可能。

07 中小企业如何应对算力涨价

7.1 优化调用策略:减少浪费

面对算力成本上涨,中小企业首要的应对之策是优化Token使用效率,减少浪费。

具体措施包括:

Prompt工程优化:通过更精准的提示词,减少无效调用。一条好的提示词可能帮你节省50%的Token消耗。

结果缓存:对于重复性请求,缓存结果而非每次都调用AI。一个简单的缓存策略,可能让你的API调用量下降30%以上。

批处理模式:将多个请求合并处理,而非逐条发送。批处理可以显著提升效率,降低单位Token成本。

7.2 混合部署:降低成本

将AI能力部署在本地和云端,形成混合架构,是另一个可行的选择。

对于延迟敏感、隐私要求高的场景,使用本地部署的小模型。

对于复杂推理、需要大模型能力的场景,使用云端API。

这种混合策略可以显著降低云端API的调用量,从而节省成本。

7.3 选对服务商:价比三家

不同的云厂商定价差异很大,选对服务商可以节省大量成本。

目前国内主流的AI算力服务商包括:

| 服务商 | 优势 | 适合场景 |

|---|---|---|

| 阿里云 | 生态完善,API丰富 | 电商、办公等场景 |

| 腾讯云 | 社交流量优势 | 社交、娱乐场景 |

| 百度智能云 | AI能力全面 | 企业智能化 |

| 火山引擎 | 价格竞争力强 | 创业公司 |

| 华为云 | 政企客户优势 | 政府、大型企业 |

根据实际需求选择合适的服务商,可以在保证能力的同时最大化成本效益。

7.4 长期协议:锁定优惠

对于算力消耗稳定的企业,与云厂商签订长期协议是锁定优惠价格的有效方式。

虽然长期协议会牺牲一定的灵活性,但可以换取显著的价格优惠。对于已经有稳定AI需求的成熟企业,这是一个值得考虑的选项。

08 展望:算力市场何去何从

8.1 短期:供需仍将维持紧平衡

短期内,算力供需关系仍将维持紧平衡状态。

GPU产能扩张需要时间,新型芯片的成熟度还有待提升,而AI应用的爆发式增长仍在持续。这意味着,算力涨价趋势短期内难以逆转。

但涨价空间也并非无限的。当价格上涨到一定程度,会抑制部分需求;与此同时,供给端也在持续改善。

8.2 中期:国产替代加速

中期来看,国产芯片的崛起将重塑算力供给格局。

随着国产AI芯片的性能不断提升、产能持续放量,对进口芯片的依赖度将逐步下降。这不仅有助于降低成本,也将增强算力供给的自主可控能力。

8.3 长期:效率提升将改变游戏规则

长期来看,技术进步将根本性改变算力供需关系。

算法效率的提升、模型蒸馏技术的成熟、新型计算架构的突破——这些技术创新有望大幅降低算力消耗,让AI应用更加普惠。

就像历史上每一次技术革命一样——从电气时代到信息时代——效率的提升最终会让”稀缺”变成”丰沛”。

09 结语:算力时代的机遇与挑战

算力涨价潮,是AI产业发展到新阶段的必然产物。

它揭示了一个深刻的产业逻辑:当技术创新足够快时,商业模式的调整往往滞后于技术的发展。

对于企业来说,这既是挑战也是机遇。那些能够有效管理算力成本、最大化AI价值的企业,将在这轮洗牌中脱颖而出。

对于整个产业来说,算力涨价潮是市场走向成熟的标志。从烧钱获客到追求盈利,从价格战到价值战,AI产业正在经历一场深刻的商业逻辑重构。

这场重构,将让真正有价值的AI应用浮出水面,让真正有竞争力的企业脱颖而出。

算力时代的大幕,才刚刚拉开。

互动话题

算力涨价对你的业务有影响吗?你有哪些应对策略?欢迎在评论区分享你的看法!

如果觉得这篇文章有帮助,欢迎转发给身边的朋友一起讨论。

我要评论