想象一下这样的场景:你想要一个完全离线的AI助手,代码不想上传到云端,数据不想离开自己的设备。以前这意味着你要么忍受云端API的延迟和费用,要么投入数万元购置专业设备。但现在,只需要一张24GB显存的普通显卡,你就能把一个能力比肩顶级闭源模型的AI系统跑在自己的电脑上。这个听起来近乎理想主义的场景,正是谷歌Gemma 4正在实现的事情。2026年4月2日,谷歌正式发布Gemma 4开源大模型系列,这是Gemma家族的第四代产品,也是谷歌迄今为止发布的最强开源模型家族。它基于与Gemini 3相同的研究和技术体系构建,专为高级推理与智能体工作流打造。更重要的是,Gemma 4不是一个需要联网调用API的云端服务,而是可以下载权重、本地部署、完全离线运行的东西。截至2026年4月,31B稠密模型在行业标准Arena AI文本榜单中位列全球开源模型第三名,性能超越参数量高达685B的DeepSeek v3.2,比肩体量是自己20倍的头部模型。这究竟是怎么做到的?普通用户又该如何使用?让我们一起来深入了解。

Gemma 4是什么

Gemma 4是谷歌于2026年4月2日推出的新一代开源大模型系列。该模型基于与Gemini 3相同的研究和技术体系构建,专为高级推理与智能体工作流打造。Gemma这个名字来源于拉丁语”gemma”,意为宝石,象征着模型的小巧精悍。与其对标的闭源产品Gemini不同,Gemma是完全开源的,任何人都可以下载权重、在本地运行、完全离线使用。

Gemma系列的发展历程见证了谷歌在开源AI领域的持续投入。2024年2月,谷歌发布初代Gemma,采用保守的2B和7B参数规模;2024年8月,Gemma 2发布,参数规模扩展到9B和27B,开始在能力上接近主流闭源模型;2025年,Gemma 3推出,进一步优化了多模态能力;而2026年4月发布的Gemma 4,则是一次质的飞跃,不仅在性能上大幅提升,更重要的是在参数效率上实现了革命性突破。

Gemma 4系列共推出了四个不同规格的版本,以覆盖从移动设备到专业工作站的全部场景。这种全谱系设计理念体现了谷歌对开源模型实用性的深刻理解——不是所有人都需要最大的模型,但每个人都需要一个能在自己设备上流畅运行的模型。从2B的超轻量版本到31B的高性能版本,Gemma 4为不同需求的用户提供了恰到好处的选择。

四大版本详解

2B与4B:轻量级版本

E2B(20亿参数)是Gemma 4系列中最轻量的版本。经过4-bit量化后,模型体积仅约4GB内存需求。这个规模意味着什么?它意味着你甚至可以在手机和树莓派这样的嵌入式设备上运行一个真正可用的AI助手。有用户测试在iPhone 15 Pro上运行E2B模型,输出速度达到每秒十几个token,虽然不及云端模型,但对于一个完全离线的本地模型来说已经完全可用。

E2B和E4B都支持图片和音频输入,具备多模态能力。128K的上下文窗口在轻量级模型中堪称奢侈,这意味着你可以一次性输入整本书的内容让模型分析,或者在长篇对话中保持连贯的记忆。这两个版本的定位是日常聊天、移动办公、嵌入式应用,以及对隐私有严格要求但不需要极致性能的场量。

E4B(40亿参数)是轻量级版本中的性能担当。4-bit量化后约5.5GB内存需求,依然可以在大多数现代笔记本电脑和部分高性能手机上运行。E4B的定位是”增强版日常助手”,在保持低资源占用的同时,提供更强的推理能力和更长的上下文记忆。适合程序员做轻量级代码辅助写作,或者作为学习外语的对话伙伴。

26B MoE:混合专家架构

26B是Gemma 4系列中首个采用混合专家(Mixture of Experts,MoE)架构的版本。虽然官方标称为26B,但实际总参数为25.2B,推理时仅激活3.8B参数——这就是MoE架构的精妙之处。传统稠密模型无论输入什么内容,都会激活全部参数;而MoE架构允许模型在推理时只调用”专家”网络的一部分,从而实现用更少的计算资源获得接近大参数模型的性能。

官方称26B MoE的运行速度接近4B模型,同时具备接近26B稠密模型的能力。在AIME 2026数学推理测试中,26B MoE版本得分高达84.3分,与参数量相近的竞品对比毫不逊色。在MMLU-Pro评测中,26B MoE拿下82.6分,AIME 88.3分,LiveCodeBench也有出色的表现。这个版本适合有中等规格GPU(8-16GB显存)的用户,在本地运行一个能力相当于GPT-4级别助理的AI系统。

26B MoE版本的另一个优势是内存效率。由于推理时只激活3.8B参数,加上量化技术的加持,理论上可以在16GB显存的显卡上流畅运行。这意味着许多游戏玩家手中的RTX 4060、RTX 3070级别的显卡都能成为AI工作站。

31B稠密模型:性能旗舰

31B稠密模型是Gemma 4系列的当家花旦,也是最能体现谷歌技术实力的版本。与MoE版本不同,31B采用传统稠密架构,31B参数在推理时全部激活。这种设计的好处是模型能力不会被”打折”,每个参数都参与到每次推理中来。

31B版本的核心竞争力在于其惊人的参数效率。在Arena AI开源模型排行榜文本赛道中,31B版本以1452分的Elo Score位列全球第三。这个成绩的震撼之处在于达成它的只是一个31B参数的模型,而排名在其之上的要么是参数量动辄数百B的巨型模型,要么是调用云端API的闭源服务。更值得关注的是,31B版本的性能超越了685B参数的DeepSeek v3.2——后者的参数量是前者的22倍,但在实际评测中反而略逊一筹。

这种参数效率的突破源于Gemma 4的核心设计理念:”Intelligence-per-parameter”,即不单纯依赖总参数量,而是看重单位算力下的实际产出。谷歌的研发团队通过改进训练数据、优化模型架构、引入更先进的对齐技术,在有限参数规模下实现了最大化智能产出。

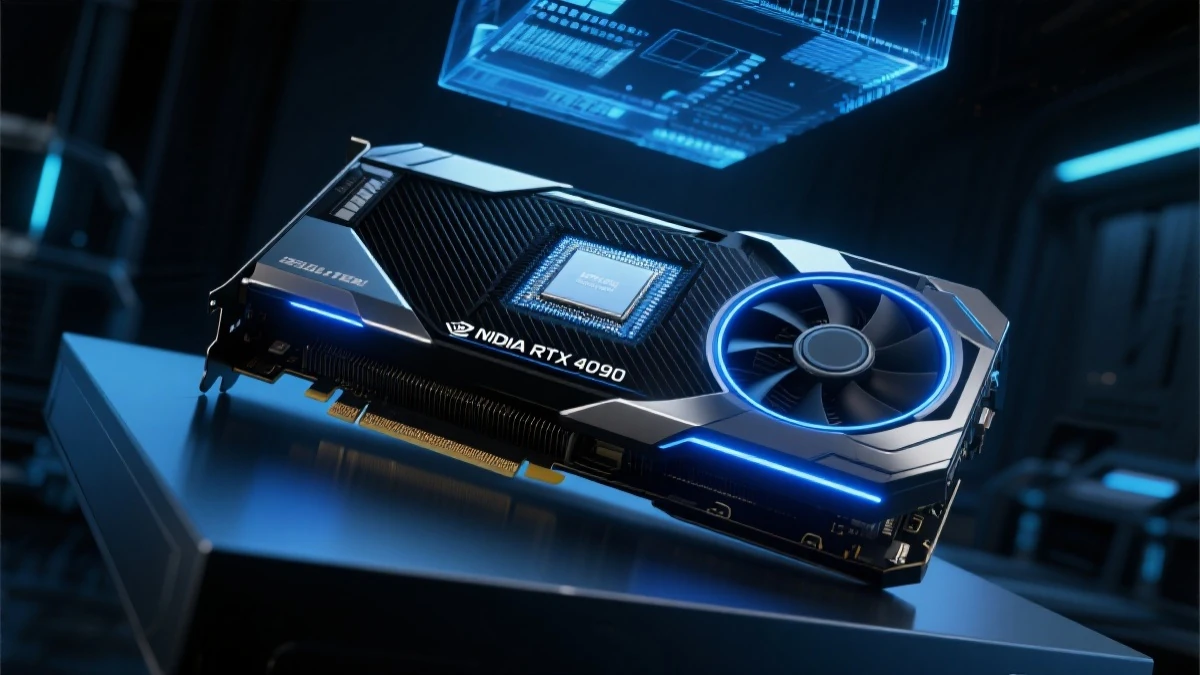

31B版本的硬件需求也相当亲民。不做量化的情况下,模型需要约62GB内存——这显然超出了普通消费者的能力。但通过4-bit量化,内存需求可以压缩到24GB左右,配合Ollama等推理框架,理论上可以在 RTX 4090(24GB显存)这样的消费级旗舰显卡上运行。

核心性能与技术创新

参数效率革命

Gemma 4最重要的技术创新在于参数效率的突破。以往的开源模型发展路径很大程度上遵循”越大越好”的逻辑,各家厂商争相推出更大参数规模的版本,仿佛参数量就是衡量模型能力的唯一标准。但这种发展路径遇到了明显的瓶颈:巨型模型的推理成本居高不下,部署门槛让普通用户难以企及,生态繁荣也无从谈起。

Gemma 4选择了一条不同的道路。谷歌研发团队意识到,对于绝大多数实际应用场景而言,用户需要的不是模型”能做什么”,而是”在有限的硬件条件下能多好地完成特定任务”。基于这个洞察,Gemma 4的设计重点从”如何让模型更强大”转向”如何让模型在给定资源下更智能”。

为了实现这个目标,Gemma 4引入了多项技术创新。首先是改进的训练数据筛选流程,团队开发了一套基于质量的分层采样策略,确保模型在训练过程中充分学习高质量内容,同时保持对多样化场景的覆盖。其次是更精细的课程学习方法,让模型从简单概念逐步过渡到复杂推理,模拟人类学习的过程。第三是强化的对齐技术,确保模型输出既helpful又harmless,在能力提升的同时避免有害内容。

多模态与长上下文

Gemma 4系列在多模态能力上也有显著提升。全系列支持图片和音频输入,这意味着用户可以上传一张截图让模型帮忙分析代码,或者发送一段录音让模型做语音转文字。与前代产品相比,Gemma 4的多模态理解更加精准,对复杂场景的描述更加连贯。

128K的上下文窗口是另一个亮点。这个长度相当于约10万汉字或300页图书的容量,足以支撑长篇小说分析、完整代码仓库理解、超长会议记录处理等高阶应用场景。更长的上下文意味着模型可以”记住”更多对话历史,在长程推理中保持一致性,减少”遗忘”现象的发生。

安全与对齐

作为谷歌出品的大模型,Gemma 4在安全方面也下足了功夫。与同期发布的Gemini 3采用相同的安全过滤和内容政策,确保模型输出符合负责任AI的标准。在发布前,谷歌对Gemma 4进行了多轮红队测试和安全审计,修复了发现的潜在漏洞。

但开源模型的安全有其特殊性:一旦权重被下载,谷歌就无法控制模型的具体用途。因此,Gemma 4在权重中嵌入了水印追踪技术,用于识别滥用行为。同时,谷歌也呼吁开源社区共同参与模型安全的维护,建立负责任使用的基本规范。

本地部署教程

选择部署方式

部署Gemma 4有多种方式,适合不同技术背景的用户。最简单的是使用Ollama,这是一个命令行工具,支持一键下载和运行Gemma全系列模型,适合不折腾配置的用户。LM Studio是另一个流行的选择,它提供图形界面,支持模型对话、参数调整、API服务等功能,适合习惯可视化操作的用户。对于追求极致性能的用户,llama.cpp提供了更底层的量化工具,支持更精细的量化参数调整。

无论选择哪种方式,部署Gemma 4的基本流程都包括:下载模型权重、配置运行环境、执行推理验证。以下我们以Ollama为例详细介绍部署过程,这是目前最简单、兼容性最好的部署方案。

Ollama部署步骤

第一步是安装Ollama。访问ollama.com官网,根据你的操作系统下载对应版本。Windows用户下载exe安装包,macOS用户下载dmg文件,Linux用户可以运行官方提供的安装脚本。安装完成后,Ollama会在后台运行,通过命令行接口与用户交互。

第二步是下载Gemma 4模型。打开终端,输入相应的下载命令:对于E2B版本使用”ollama pull gemma:2b”,E4B版本使用”ollama pull gemma:4b”,26B MoE版本使用”ollama pull gemma:26b”,31B版本使用”ollama pull gemma:31b”。下载过程取决于网络状况,26B和31B版本体积较大,可能需要较长时间。

第三步是运行模型。下载完成后,输入”ollama run gemma:4b”(以4B为例)即可启动对话。首次运行会加载模型到内存,需要等待几秒钟。加载完成后,就可以像使用ChatGPT一样与模型对话了。输入”quit”或”exit”可以退出对话。

量化版本选择

对于显存或内存有限的用户,选择合适的量化版本至关重要。Gemma 4官方提供FP16原始版本和多种量化版本。FP16版本需要约2倍于模型参数的显存(以GB计),例如31B的FP16版本需要约62GB显存。Q4量化将需求降低约75%,Q8量化降低约50%。对于16GB显存的显卡,推荐使用Q4量化的26B或31B版本。

Ollama默认下载的是优化过的版本,通常不需要用户手动选择量化等级。但如果需要更精细的控制,可以使用LM Studio或llama.cpp自行量化。需要注意的是,量化等级越高,模型能力损失越大;Q2级别的量化可能导致输出质量明显下降,非必要不推荐。

API服务配置

对于开发者而言,将Gemma 4作为本地API服务使用是更实用的场景。Ollama内置了兼容OpenAI的API接口,启动模型后自动在11434端口提供服务。在代码中只需将API地址改为”http://localhost:11434/v1″,原生的OpenAI SDK即可无缝对接。

以Python为例,使用LangChain框架调用本地Gemma 4的代码如下:配置API地址为本地端口,设置模型名为对应的Gemma版本,然后就可以使用标准的ChatOpenAI接口进行对话。这种方式让开发者可以无缝切换本地模型和云端模型,便于在不同场景下选择最优方案。

硬件需求分析

各版本显存要求

选择哪个版本的Gemma 4,很大程度上取决于你的硬件配置。E2B版本是门槛最低的选择,4-bit量化后仅需4GB内存,现代智能手机和树莓派都能运行。如果只是想在移动端体验AI对话,E2B是最佳选择。

E4B版本的内存需求约为5.5GB,适合在笔记本电脑上运行。这个版本可以在不特别高的硬件配置下提供不错的对话体验,是移动办公场景的理想选择。E4B的推理速度通常可以达到每秒20-30个token,在可接受的范围内。

26B MoE版本是性能与效率的平衡点。4-bit量化后约需12-16GB显存,对应的显卡包括RTX 4060 Ti(16GB)、RTX 3080(10GB,需要量化)、RTX 4070(12GB,需要量化)等。26B MoE的实际表现接近34B的稠密模型,但资源消耗仅需一半。

31B版本是性能旗舰,4-bit量化后需要约24GB显存,对应RTX 4090(24GB)、A100(40GB/80GB)等高端显卡。如果你的显卡恰好是RTX 4090,31B版本可以原汁原味地发挥Gemma 4的最强能力。当然,更高的配置可以运行更大参数的量化版本或原始版本。

内存与存储

除了显存,内存和存储也不容忽视。模型文件需要占用相当大的磁盘空间:E2B约1.4GB,E4B约2.5GB,26B约14GB,31B约18GB。建议准备充足的SSD空间,不仅存储模型文件,还需要足够的空间存放运行时缓存。

系统内存方面,建议16GB起步。如果同时运行其他应用程序,32GB内存可以提供更流畅的体验。需要注意的是,GPU显存和系统内存不能完全替代对方——GPU负责模型推理的计算密集型部分,系统内存负责数据搬运和预处理。

性能优化技巧

有几个技巧可以提升Gemma 4的运行效率。首先是使用最新版本的推理框架,Ollama、LM Studio等工具都在持续优化中,更新到最新版本往往能获得免费的性能提升。其次是合理设置上下文长度,较短的上下文消耗更少资源,但在需要长程记忆的场景下要记得调长。

对于多显卡用户,可以尝试使用模型并行技术。26B和31B版本支持将模型分片加载到多张显卡,降低单卡显存压力。Ollama近期已支持多卡并行配置,在ollama.conf中设置num_gpu参数即可启用。

竞品对比分析

Gemma 4 vs DeepSeek系列

DeepSeek是国内AI公司深度求索推出的开源大模型系列,在开发者社区中有较高声誉。最新一代的DeepSeek v3.2以685B的参数量成为开源模型的巨无霸,但Gemma 4 31B在Arena AI评测中反而以1452分超越DeepSeek v3.2的1425分。这个结果充分说明了参数效率的重要性。

对比具体能力,在代码生成方面,Gemma 4经过谷歌专业团队的优化,表现更加稳定;DeepSeek在中文语境下有优势,适合国内用户。在推理速度方面,Gemma 4由于参数量较小,在消费级硬件上更容易达到实时交互的流畅度;DeepSeek v3.2需要更高端的硬件配置才能发挥全部实力。在部署便捷性方面,Gemma 4通过Ollama等工具实现了真正的即点即用,DeepSeek的部署相对复杂。

Gemma 4 vs Llama系列

Meta的Llama系列是开源大模型的标杆,至今仍是很多新模型的基准。Gemma 4与Llama 4处于同一生态位,直接竞争关系明显。在MMLU和代码评测中,Gemma 4略胜Llama 4同规格版本,尤其是在推理任务的准确率上优势明显。

Llama系列的优势在于生态成熟度。Llama出道更早,社区积累更丰富,第三方工具和支持文档更多。对于不排斥折腾的用户,Llama的可定制性更强。Gemma 4作为后起之秀,正在快速补足生态短板。

Gemma 4 vs GPT系列

与OpenAI的GPT系列对比,本质上是开源与闭源的对决。GPT-4级别模型的云端体验仍然领先Gemma 4,但差距正在缩小。Gemma 4的核心优势是本地运行、数据不离身的隐私保护,以及零API成本的自由使用。

对于隐私敏感场景或需要高频调用的用户,Gemma 4的本地部署优势是GPT系列无法替代的。企业用户可以放心地将敏感数据交给本地模型处理,无需担忧数据泄露风险。个人开发者可以无限次调用模型优化自己的应用,无需为API调用付费。

优缺点总结

优点

经过深入了解和使用体验,Gemma 4展现出诸多令人印象深刻的优势。

参数效率出色是最核心的优点。31B模型超越685B竞品的表现,证明了”大不等于好”的道理。谷歌通过改进训练方法和模型架构,在有限的参数规模下实现了最大化的智能产出。这对于资源有限的个人用户和中小企业意义重大——不需要购置昂贵的专业设备,就能用上顶级AI能力。

开源免费是另一个显著优势。Gemma 4完全免费,可以自由下载、自由使用、自由修改。没有任何API调用限制,没有使用配额,没有订阅费用。这种零成本使用对于学习AI技术、探索应用场景、构建原型产品的用户来说非常友好。

隐私保护能力也值得肯定。本地运行的特性确保数据永远不会离开用户的设备。对于处理敏感信息的场景,如医疗记录、财务数据、企业内部文件,本地大模型是唯一的选择。云端API无论多么方便,都存在数据被收集和分析的风险。

多版本覆盖满足不同需求。从手机级别的2B到工作站级别的31B,用户可以根据自己的硬件条件选择最优版本。不需要为不需要的能力付费,也不需要在能力与效率之间做痛苦取舍。

缺点

当然,Gemma 4也存在一些局限性和改进空间。

中文能力相对薄弱是首要问题。Gemma系列的主要训练数据是英文,对中文的支持不如对英文的支持。在中文对话、翻译、写作等任务中,表现可能不如专门优化过中文的模型。对于主要使用中文的用户,这可能是选择Gemma 4的主要顾虑。

硬件门槛依然存在。虽然Gemma 4已经大幅降低了运行门槛,但31B版本仍需要24GB显存才能流畅运行。这意味着RTX 4090几乎是运行31B版本的最低配置,而大多数用户的显卡显存可能只有8-12GB。E2B和E4B版本对硬件友好,但能力又相对有限。

部署和维护需要一定技术背景。虽然Ollama等工具已经大大简化了部署流程,但对于完全没有技术背景的普通用户来说,仍然存在一定的门槛。遇到问题时的排查和解决,往往需要一定的折腾精神。

与顶级闭源模型仍有差距。在复杂推理、长篇写作、多轮对话等高阶任务上,Gemma 4与GPT-4、Claude等顶级闭源模型仍有差距。对于有极致追求的专业用户,闭源模型可能仍是首选。

适用场景分析

隐私敏感型应用

Gemma 4最适合的场景是隐私敏感型应用。医疗从业者可以用它分析患者记录,所有数据留在本地,不需要上传到任何服务器。律师可以用它协助文档撰写,合同内容不会泄露给第三方。金融分析师可以用它处理财报数据,投资策略不会被人知晓。

对于企业用户而言,本地大模型可以满足合规要求。许多行业法规对数据跨境传输有严格限制,本地部署是唯一的合规路径。Gemma 4的开源特性也便于企业进行安全审计,确认模型不存在后门或漏洞。

学习与研究用途

AI研究者和机器学习爱好者是Gemma 4的另一个重要用户群体。开源模型的可解释性强,可以深入研究模型架构、训练方法、推理优化等各个环节。对于学习大模型原理的研究者,直接在本地运行和调试Gemma 4远比调用黑盒API更有价值。

计算机专业的学生可以用Gemma 4作为学习AI编程的入门工具。相比付费API,本地模型没有使用成本限制,可以肆无忌惮地尝试各种用法、调试各种问题。在这种”自由探索”的过程中学到的东西,远比小心翼翼调用API要多得多。

边缘设备与嵌入式系统

E2B和E4B版本的超低资源占用,让Gemma 4得以进入嵌入式系统领域。智能家居中枢可以用E2B版本实现本地语音助手,不依赖云端服务;树莓派项目可以用E4B版本实现图像分类、异常检测等AI功能;工业控制器可以用量化后的模型实现边缘推理。

这些场景的共同特点是不需要顶级AI能力,但需要低延迟、低功耗、低成本的解决方案。Gemma 4的轻量版本恰好填补了这个市场空白,让AI能力真正赋能边缘计算。

个人开发者与创作者

独立开发者、游戏开发者、自媒体创作者等群体,可以用Gemma 4构建自己的AI应用和产品原型。本地模型没有API成本,适合需要大量调用的场景。代码补全插件、写作助手、字幕生成器、客服机器人——这些应用都可以基于Gemma 4快速构建。

对于创作者而言,Gemma 4可以作为创意助手使用。头脑风暴时让它提供灵感,写作卡壳时让它帮忙续写,翻译时让它做初稿。能力虽然不及顶级闭源模型,但胜在随时可用、成本为零。

行动建议

如果你对Gemma 4产生了兴趣,以下是一些具体的行动建议。

普通用户建议从Ollama+4B版本开始体验。这是最简单、门槛最低的入门方式。安装Ollama(10分钟),拉取4B模型(5分钟),开始对话(立即可用)。整个过程不到半小时,不需要任何技术背景。如果体验满意,可以逐步升级到26B或31B版本。

开发者用户建议同时部署多个版本,对比它们的实际表现。不同任务对模型能力的需求不同:简单对话用4B即可,代码辅助用26B更稳,长文写作可以尝试31B。通过实际测试找到最适合自己场景的版本,而不是盲目追求最大版本。

企业用户建议评估合规要求和数据敏感度。如果数据不能出境、本地部署是刚需,Gemma 4是值得考虑的选择。可以先做POC验证,确认模型能力满足业务需求后再做生产部署决策。

无论选择哪种方案,建议先明确自己的核心需求和使用场景。Gemma 4是强大的工具,但并非万能。将其应用于最适合自己的场景,才能发挥最大价值。

结语

Gemma 4的发布,标志着开源大模型进入了一个新阶段。不再盲目追求参数规模的军备竞赛,而是聚焦于参数效率、部署便捷性、场景适配性等更务实的维度。31B版本超越685B竞品的性能表现,让人们看到了”小而美”路线的巨大潜力。

对于每一个普通用户而言,Gemma 4的意义在于降低了顶级AI能力的门槛。不需要昂贵的订阅费用,不需要顶尖的硬件配置,只需要一张中端显卡,你就能把一个比肩GPT-4的AI助手请进自己的书房。数据不离开你的设备,调用没有任何限制——这种使用自由度是以往任何AI服务都无法提供的。

2026年是开源大模型爆发的关键年份。随着技术的持续进步和产品的不断完善,我们有理由期待,每个人都能拥有自己专属的AI助手。在那一天到来之前,Gemma 4已经迈出了坚实的一步。

—

你体验过Gemma 4了吗?感觉如何?欢迎在评论区分享你的使用心得!

🔗 官网与下载链接

官方网站:https://www.kaggle.com/models/google/gemma4

本地部署工具:

| Ollama | 命令行部署工具 | https://ollama.com |

| LM Studio | 图形界面部署工具 | https://lmstudio.ai |

| Hugging Face | 模型权重下载 | https://huggingface.co/google/gemma-4-31b |

各版本硬件需求:

| E2B(2B参数) | 4GB内存 | 手机/树莓派可运行 |

| E4B(4B参数) | 5.5GB内存 | 笔记本可运行 |

| 26B MoE | 12-16GB显存 | RTX 4060 Ti及以上 |

| 31B Dense | 24GB显存 | RTX 4090及以上 |

价格:完全免费,开源可商用

我要评论