🎯 学习目标

> 学完今天的内容,你将了解主流AI模型的特点和差异,学会根据任务类型选择最合适的模型,让Prompt的效果最大化。

🔄 昨天我们学了什么?

昨天我们学习了模板库,掌握了一套可以直接套用的Prompt模板集合。六大场景19个模板,覆盖写作、代码、分析、创意、学习、日常等各种常见任务。

但你有没有想过:同样的Prompt,用不同的AI模型来跑,效果可能完全不一样?

今天我们就来聊聊这个话题——模型对比。

🍽️ 先从一个生活场景开始

你有没有遇到过这种情况?

同样一道数学题,你去问三个学霸同学:

学霸A:看了一眼题目,直接给你一个答案,但对不对不知道

学霸B:把解题步骤一步步写出来,但最后算错了

学霸C:不仅写了解题步骤,还主动检查了一遍,答案准确

三个人智力水平差不多,但解题风格完全不同。你会更信任谁?

AI模型也是这样。不同的模型,即使面对同一个Prompt,它们的”解题思路”和”答案质量”也可能完全不同。

学会选择合适的模型,就像学会找对的人问对的问题。

📚 主流AI模型一览

国外主流模型

GPT系列(OpenAI)

GPT-4:当前最强大的通用模型之一

- 优点:理解能力强、推理能力出色、知识覆盖面广

- 缺点:响应较慢、成本较高、有时过于冗长

- 适合场景:复杂推理、创意写作、代码编写、专业问题解答

- 代表产品:ChatGPT Plus、Microsoft Copilot

GPT-4o:GPT-4的优化版本

- 优点:多模态能力强(能看图、听声音)、响应更快

- 缺点:专业领域深度略逊于GPT-4

- 适合场景:日常对话、多媒体内容分析、快速问答

GPT-3.5 Turbo:轻量级模型

- 优点:响应极快、成本极低

- 缺点:复杂任务能力有限、偶尔会”胡说八道”

- 适合场景:简单问答、格式化内容生成、日常聊天

Claude系列(Anthropic)

Claude 3.5 Sonnet:目前最受欢迎的Claude版本

- 优点:长文本处理能力强(20万Token上下文)、回答更有条理、更善于遵循指令

- 缺点:创意能力略逊于GPT-4、某些中文表达不如GPT自然

- 适合场景:长文档分析、代码审查、学术研究、复杂任务分解

- 代表产品:Claude.ai、Slack集成

Claude 3 Opus:旗舰版本

- 优点:能力全面,对复杂任务处理更稳定

- 缺点:成本较高、响应比Sonnet慢

- 适合场景:专业级写作、深度分析、复杂推理

Claude 3 Haiku:轻量级版本

- 优点:响应极快、成本极低

- 缺点:复杂任务能力有限

- 适合场景:简单问答、快速摘要、日常聊天

Gemini系列(Google)

Gemini 1.5 Pro:长上下文处理能力惊人

- 优点:100万Token上下文、能处理整本书或长视频、多模态能力强

- 缺点:某些中文场景表现不如GPT-4

- 适合场景:长文档处理、多媒体内容分析、大规模数据分析

Gemini 1.5 Flash:轻量级优化版本

- 优点:响应快、成本低、多模态能力强

- 缺点:复杂推理略逊

- 适合场景:日常任务、快速问答、多媒体内容处理

国内主流模型

通义千问(阿里云)

Qwen 2.5:国产开源模型中的佼佼者

- 优点:中文理解出色、开源可商用、版本多样(72B、7B等不同规模)

- 缺点:复杂推理能力与国际顶级模型有差距

- 适合场景:中文内容创作、客服对话、知识问答

Qwen Max:付费增强版本

- 优点:能力全面提升、中文表达更自然

- 缺点:需要付费

- 适合场景:专业级中文任务、商业应用

智谱清言(清华&智谱AI)

GLM-4:国产旗舰模型

- 优点:中文能力强、对话流畅、支持多模态

- 缺点:复杂逻辑推理有待提升

- 适合场景:中文对话、内容创作、知识整理

GLM-4V:多模态版本

- 优点:能看懂图片、理解图表

- 缺点:图片理解能力不如GPT-4V

- 适合场景:图文分析、数据解读

Kimi(月之暗面)

Kimi:长上下文处理能力强

- 优点:20万汉字上下文、擅长长文本分析、中文表达自然

- 缺点:复杂推理能力有限

- 适合场景:长文总结、文档分析、深度阅读辅助

DeepSeek(深度求索)

DeepSeek V3:高性价比国产模型

- 优点:开源、成本低、能力全面、中文表现优秀

- 缺点:品牌知名度不如大厂

- 适合场景:代码开发、学术研究、日常任务

DeepSeek Coder:代码专用版本

- 优点:代码能力出色、能处理超长代码

- 缺点:非代码任务不如通用模型

- 适合场景:代码开发、Bug修复、代码优化

🔍 如何选择合适的模型?

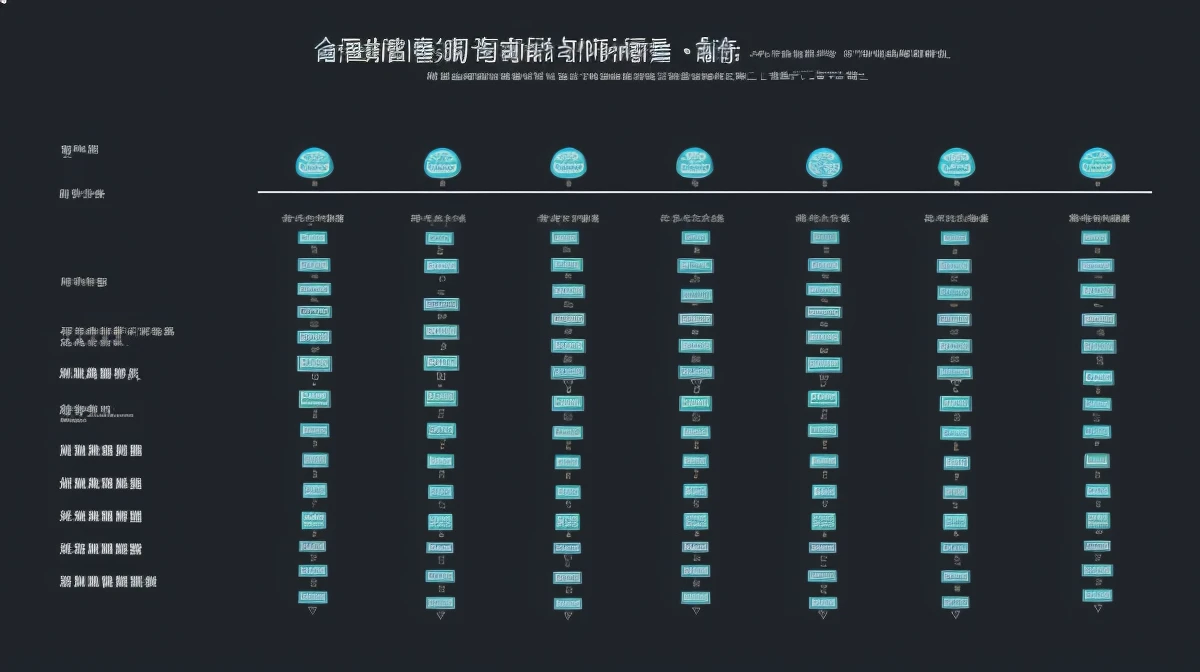

按任务类型选择

1. 复杂推理与专业分析

首选:GPT-4 > Claude 3.5 Sonnet > Gemini 1.5 Pro

原因:这些任务需要模型有强大的逻辑推理能力,GPT-4和Claude系列在这方面表现最好。

Prompt示例:

我需要在三个月内提升英语水平,从零基础到可以日常对话。请帮我制定一个详细的学习计划,考虑:

- 每天可投入2小时

- 目标是日常口语交流

- 预算有限(每月不超过200元)

请给出分阶段目标和具体学习方法。

2. 代码开发与调试

首选:GPT-4 > DeepSeek Coder > Claude 3.5 Sonnet

原因:GPT-4的代码能力经过大量训练,DeepSeek Coder是专为此场景优化的国产模型。

Prompt示例:

用Python写一个网络爬虫,要求:

- 爬取豆瓣电影Top250的基本信息(名称、评分、评价人数)

- 支持翻页

- 数据保存为CSV格式

- 添加错误处理

- 添加随机User-Agent避免被封

3. 中文内容创作

首选:GPT-4 > 通义千问Qwen Max > Kimi > 智谱GLM-4

原因:虽然GPT-4中文能力很强,但国产模型在中文表达上更自然、更懂中国用户的喜好。

Prompt示例:

帮我写一篇公众号文章,主题是"为什么年轻人不愿意生娃"。要求:

- 标题要有吸引力,能引发共鸣

- 结构清晰,有数据支撑

- 结尾要有行动号召

- 适合25-35岁的职场人群阅读

- 长度1500字左右

4. 长文档分析与总结

首选:Claude 3.5 Sonnet > Kimi > Gemini 1.5 Pro > GPT-4o

原因:Claude系列和Kimi在长上下文处理上有优势,能更好地理解和总结长文档。

Prompt示例:

请阅读我上传的这份10万字行业报告,然后:

- 提炼出5个核心观点

- 总结报告的主要结论

- 分析报告的不足之处

- 用一段话概括整篇报告(100字以内)

5. 日常对话与简单任务

首选:GPT-3.5 > Claude 3 Haiku > 通义千问 > Kimi

原因:简单任务不需要强大的模型,响应快、成本低的轻量模型更合适。

Prompt示例:

帮我把这段话翻译成英文:"今天天气真好,适合出门散步。"

6. 多模态任务(看图、听声音)

首选:GPT-4o > Gemini 1.5 Pro > Claude 3.5 Sonnet

原因:GPT-4o的多模态能力最强,能准确理解图片内容并进行复杂分析。

Prompt示例:

请分析这张图片中的人物穿着打扮,推测:

- 这可能是哪个年代的风格

- 人物的职业或身份

- 适合什么样的社交场合

按预算选择

免费预算

首选方案:

- GPT-3.5(免费版ChatGPT)

- Claude 3 Haiku(免费版Claude.ai)

- 通义千问Qwen(免费)

- Kimi(免费)

- DeepSeek V3(开源免费)

使用技巧:免费模型能力有限,尽量把任务描述清楚,减少复杂度和歧义。

低预算(月费50元以内)

首选方案:

- ChatGPT Plus(20美元/月 ≈ 145元)

- Claude Pro(20美元/月 ≈ 145元)

性价比之选:

- 国产Plus版本(月费约30-50元)

高预算(专业使用)

首选方案:

- GPT-4 API(按量计费,适合开发者)

- Claude API(按量计费)

- Gemini API(性价比高)

按场景选择总结表

| 任务类型 | 首选 | 备选 | 避坑 |

|---|---|---|---|

| 复杂推理 | GPT-4 | Claude 3.5 Sonnet | 不要用轻量模型 |

| 代码开发 | GPT-4 | DeepSeek Coder | 不要用GPT-3.5 |

| 中文创作 | 国产Max版 | GPT-4 | GPT-3.5中文容易生硬 |

| 长文总结 | Claude 3.5 Sonnet | Kimi | 注意上下文限制 |

| 日常对话 | 免费版即可 | – | 不要浪费高级模型 |

| 多模态 | GPT-4o | Gemini Pro | 国产多模态还有差距 |

💡 模型对比实战

案例1:同一Prompt,不同模型的表现

Prompt:

解释什么是"区块链",要求:

- 用通俗易懂的语言

- 举例说明

- 控制在200字以内

GPT-4的回答:

> 区块链就像一本公共的”账本”。想象全村人共用一个账本,每个人都有一份完整的副本。任何一笔交易,全村人都会记录在案。想要篡改?除非你同时改掉51%的人手里的账本——这几乎不可能。这就是区块链的核心:去中心化、不可篡改、可追溯。

> 举例:小明转给小红1个比特币,全世界的电脑都会记录这笔交易,没有人能赖账。

Claude 3.5 Sonnet的回答:

> 区块链是一种”分布式账本技术”。

> 通俗理解:

> – 传统:银行是中心账本,只有银行能记录交易

> – 区块链:每个人都有账本副本,大家一起记录,没人能作弊

> 核心特点:

> 1. 去中心化——没有中间商

> 2. 不可篡改——记录了就改不了

> 3. 可追溯——每笔交易都能查到

> 举例:就像全班同学都在同一张Excel表格里写班级日志,改一个人的没用,必须改所有人的才能成功。

分析:

- GPT-4的回答更简洁、更生动,举例也更贴近日常生活

- Claude的回答更结构化,适合喜欢条理清晰的人

- 两者质量都不错,只是风格不同

案例2:代码能力的对比

Prompt:

用Python写一个快速排序算法,要求有详细注释

GPT-4的输出:

def quick_sort(arr):

"""

快速排序算法

时间复杂度:平均O(n log n),最坏O(n²)

空间复杂度:O(log n)

"""

if len(arr) <= 1:

return arr

# 选择基准元素(这里选择中间元素)

pivot = arr[len(arr) // 2]

# 分区操作

left = [x for x in arr if x < pivot]

middle = [x for x in arr if x == pivot]

right = [x for x in arr if x > pivot]

# 递归排序并合并结果

return quick_sort(left) + middle + quick_sort(right)

# 测试

if __name__ == "__main__":

test_array = [64, 34, 25, 12, 22, 11, 90]

print("原始数组:", test_array)

print("排序后:", quick_sort(test_array))

Claude 3.5 Sonnet的输出:

def quicksort(arr):

"""

快速排序实现

算法思想:

- 选择一个基准元素(pivot)

- 将数组分为两部分:小于pivot的元素和大于pivot的元素

- 递归处理两部分

时间复杂度:O(n log n)(平均情况)

"""

# 基本情况:数组为空或只有一个元素时直接返回

if len(arr) <= 1:

return arr

# 选择基准值(这里使用中间元素)

pivot = arr[len(arr) // 2]

# 分区:创建三个列表

left = [] # 存储小于基准的元素

equal = [] # 存储等于基准的元素

right = [] # 存储大于基准的元素

# 遍历数组进行分区

for num in arr:

if num < pivot:

left.append(num)

elif num > pivot:

right.append(num)

else:

equal.append(num)

# 递归排序并拼接结果

return quicksort(left) + equal + quicksort(right)

# 测试代码

if __name__ == "__main__":

# 测试用例

assert quicksort([3, 1, 4, 1, 5]) == [1, 1, 3, 4, 5]

assert quicksort([10, 7, 8, 9, 1, 5]) == [1, 5, 7, 8, 9, 10]

print("所有测试通过!")

分析:

- 两者代码都正确且有详细注释

- Claude的版本有单元测试,更严谨

- GPT-4的版本更简洁,注释更易懂

- 实际使用中两者都可以

案例3:创意写作的对比

Prompt:

为一个名为"AI助手"的新产品写一个slogan,要求:

- 简短有力

- 体现AI的特点

- 容易记忆

- 可以考虑押韵或对仗

GPT-4的输出:

选项1:AI助手——你的第二大脑

选项2:思考更快,答案更准——AI助手

选项3:有问题?问AI助手就够了

选项4:AI助手,让不可能变成可能

Claude 3.5 Sonnet的输出:

主推:AI助手——比你更懂你

备选:

- AI助手:智能相伴,灵感随行

- AI助手:你的问题,我的答案

- 有了AI助手,工作生活更轻松

分析:

- GPT-4的slogan更简洁、更”酷”

- Claude的slogan更温暖、更有”陪伴感”

- 创意类任务,两者的差异主要在风格偏好

⚠️ 新手避坑指南

坑1:以为贵的模型一定更好

事实:不一定。简单任务用高级模型反而可能效果更差——高级模型有时会”过度思考”,把简单问题复杂化。

避坑:

- 简单问答用免费模型就够了

- 日常聊天不需要GPT-4

- 把高级模型留给真正复杂的任务

坑2:忽视模型的上下文限制

事实:不同模型的上下文窗口(能处理的文本长度)差异很大。超过限制的内容会被截断。

避坑:

- 处理长文档先确认模型的上下文限制

- Claude 3.5 Sonnet支持20万Token,适合长文档

- Kimi支持20万汉字,适合中文长文

坑3:不做模型对比就选定

事实:不同模型对同一Prompt的响应质量可能差异很大,不对比就选定可能会错过更好的选择。

避坑:

- 重要任务至少用2-3个模型测试

- 记录不同模型的表现,便于以后选择

- 同一模型的不同版本也要对比(如GPT-4 vs GPT-4o)

坑4:忽视模型的安全限制

事实:不同模型的安全限制不同,有的更严格,有的更宽松。

避坑:

- 需要创作成人内容?部分模型会拒绝

- 需要分析争议性话题?限制不同

- 选择前了解模型的内容政策

坑5:只关注模型能力,忽视响应速度

事实:模型能力强的往往响应慢、成本高。

避坑:

- 日常任务不需要顶级模型

- 速度要求高的场景选择轻量模型

- 批量处理任务要考虑成本

💡 今日小结

- 不同模型有不同特点:GPT强在创意和推理,Claude强在长文本和分析,国产模型强在中文和性价比

- 选择模型看任务:复杂任务用强模型,简单任务用轻量模型

- 没有最好的模型,只有最合适的模型

- 同Prompt不同模型效果可能差异很大,重要任务要多模型对比

📋 今日产出

学完今天的内容,你应该:

- ✅ 了解主流AI模型(GPT、Claude、Gemini、国产模型)的特点和差异

- ✅ 能根据任务类型选择合适的模型

- ✅ 知道不同模型的优缺点和适用场景

- ✅ 学会用多模型对比找到最优选择

- ✅ 了解模型选择的成本考量

🔮 明日预告

> 明天(Day10)是【Prompt炼金术】系列的综合实战篇——最后一课!我们将综合运用10天学到的所有技巧,从零开始完整演示一个复杂任务的Prompt设计全过程。学会后,你将成为真正的Prompt高手!

我要评论